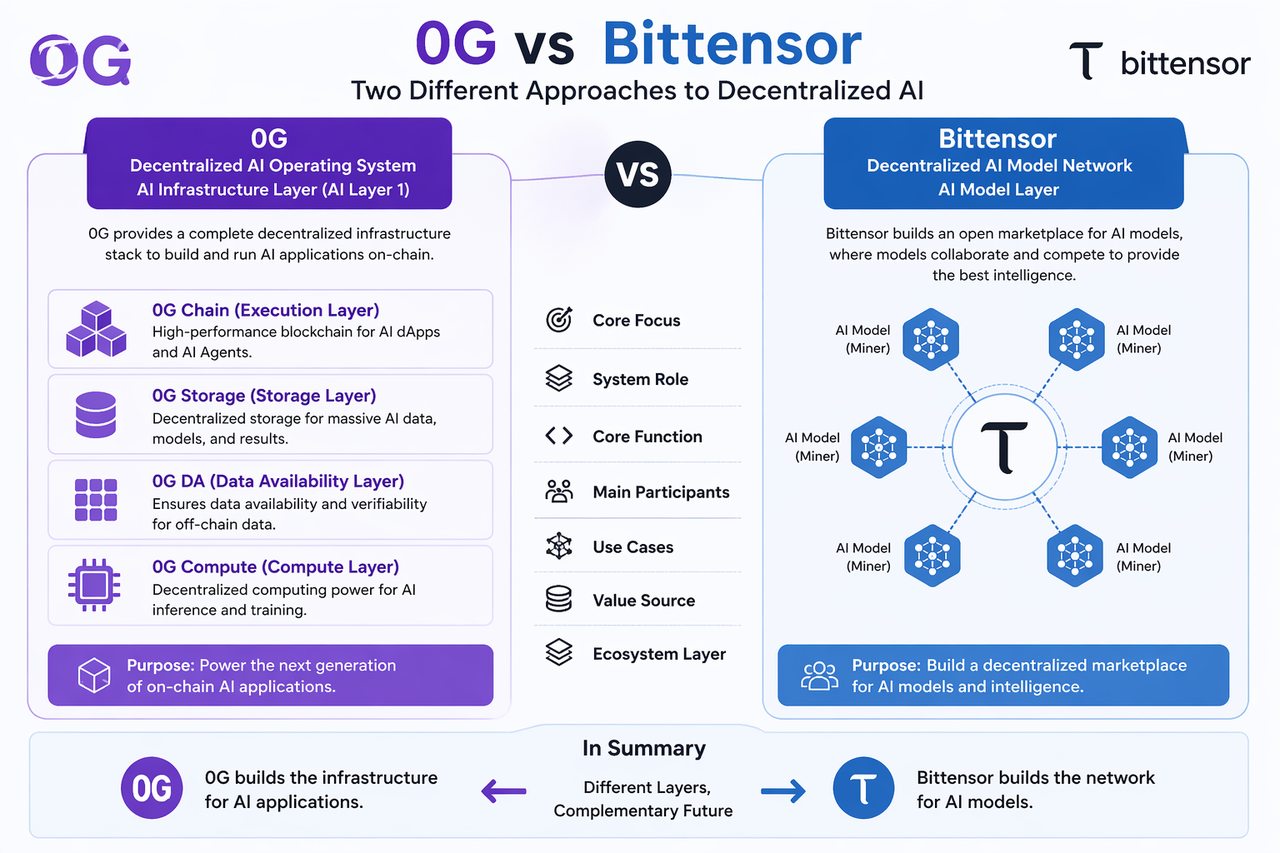

0G vs Bittensor: diferencias clave entre la infraestructura de IA descentralizada y las redes de modelos de IA

A medida que la integración de la IA y la blockchain se acelera, la IA descentralizada está evolucionando a lo largo de dos direcciones claras. Una se centra en crear redes colaborativas alrededor de los modelos de IA, y la otra en desarrollar la infraestructura base que impulsa aplicaciones de IA.

Bittensor y 0G son ejemplos destacados de estos enfoques. Bittensor facilita la colaboración global entre modelos de IA mediante incentivos, mientras que 0G ofrece entornos escalables y de alto rendimiento para aplicaciones de IA. Esta diferencia estratégica define su papel dentro del ecosistema.

0G y Bittensor: posicionamiento en el ecosistema de IA

0G y Bittensor ocupan capas diferenciadas en el ecosistema de IA.

0G es la infraestructura base (capa de infraestructura de IA), proporcionando entornos operativos para aplicaciones de IA, incluyendo computación, almacenamiento y disponibilidad de datos. Su misión es ser el AI Layer1, permitiendo que los agentes de IA funcionen de manera eficiente on-chain.

Bittensor, por su parte, actúa en la capa de protocolo, conectando proveedores de modelos de IA y validadores mediante incentivos para crear un mercado descentralizado de modelos de IA.

En resumen, 0G se dedica a “ejecutar IA”, y Bittensor a “conectar IA”.

Comparación central: 0G vs Bittensor

Desde la arquitectura de sistemas, sus diferencias clave se entienden al analizar la capa de infraestructura.

| Dimensión de comparación | 0G | Bittensor |

|---|---|---|

| Posicionamiento central | Infraestructura de IA descentralizada (AI Layer1) | Red descentralizada de modelos de IA |

| Objetivo principal | Proporcionar entornos operativos para dApps y agentes de IA | Construir una red abierta de colaboración e incentivos para modelos de IA |

| Rol del sistema | Capa de infraestructura de aplicaciones de IA | Capa de red de modelos e inferencia de IA |

| Arquitectura técnica | Modular: cadena, almacenamiento, DA, computación | Red de machine learning basada en subredes |

| Capacidades principales | Ejecución, almacenamiento, disponibilidad de datos, computación descentralizada | Entrenamiento de modelos de IA, inferencia e incentivos por contribución |

| Público objetivo | Desarrolladores de IA y creadores de aplicaciones | Proveedores de modelos de IA e investigadores |

| Escenarios de aplicación | Agentes de IA, aplicaciones on-chain, dApps de IA | Servicios de inferencia descentralizada, mercados de modelos |

| Fuente de valor | Uso de infraestructura y demanda de aplicaciones de IA | Contribuciones de modelos y recompensas por calidad de inferencia |

| Nivel del ecosistema | Capa de infraestructura de IA (Infra Layer) | Capa de red de modelos de IA (Model Layer) |

| Posicionamiento relacional | Soporte base para aplicaciones de IA | Red para el suministro de inteligencia de IA |

0G es una red modular AI Layer1, compuesta por ejecución de cadena, almacenamiento, DA (disponibilidad de datos) y computación, diseñada para soportar cargas de trabajo de IA.

Bittensor, en cambio, se basa en incentivos, con la estructura de subredes como núcleo, gestionando contribuciones y recompensas entre modelos de IA—formando un “sistema económico de modelos de IA”.

0G: red de infraestructura AI Layer1

0G está diseñada para ofrecer una infraestructura integral de IA, permitiendo que aplicaciones de IA se ejecuten nativamente on-chain.

Su arquitectura de cuatro capas soporta agentes de IA y aplicaciones on-chain, y consiste en:

- Capa de ejecución para procesamiento lógico

- Capa de almacenamiento para persistencia de datos

- Capa DA para validación de datos

- Capa de computación para potencia de hash descentralizada

Así, 0G funciona como un “sistema operativo de IA”, priorizando la potencia computacional y la integridad de la infraestructura.

Bittensor: red descentralizada de modelos de IA

Bittensor tiene como objetivo crear una red abierta de modelos de IA, promoviendo la competencia y colaboración mediante incentivos.

En este sistema, los modelos actúan como nodos, participando y obteniendo recompensas según la calidad de sus aportes. Esta estructura se asemeja a un mercado de modelos de IA más que a una capa de infraestructura.

Por tanto, Bittensor se centra en “la producción y distribución de inteligencia de IA”, no en “el entorno operativo para la IA”.

Diferencias de escenarios de aplicación: 0G vs Bittensor

0G es ideal para aplicaciones on-chain que requieren alta computación y almacenamiento, como agentes de IA, sistemas autónomos y tareas complejas de inferencia.

Bittensor es óptimo para entrenamiento de modelos, intercambio y colaboración de inteligencia distribuida—casos como mercados de modelos y redes de servicios de inferencia.

Ambos ocupan posiciones distintas en el stack de IA, sin competir directamente en la capa de aplicación.

Comparación de roles en el ecosistema: 0G vs Bittensor

En el ecosistema de IA descentralizada, Bittensor opera en la capa de modelos, suministrando inteligencia de IA, mientras que 0G provee la infraestructura, aportando computación, almacenamiento y entornos de ejecución.

A medida que el ecosistema de IA evoluciona, estos sistemas tienden a complementarse: las redes de modelos aportan inteligencia, la infraestructura proporciona la base operativa, y juntos permiten aplicaciones de IA más sofisticadas.

Resumen

0G y Bittensor representan dos caminos divergentes en la IA descentralizada. Bittensor se centra en redes de modelos de IA, construyendo un mercado abierto de machine learning mediante incentivos; 0G se dedica a la infraestructura de IA, proporcionando un entorno completo on-chain para aplicaciones de IA.

No compiten directamente, pues cada uno ocupa una capa diferente del ecosistema de IA. A medida que las aplicaciones de IA escalan, se espera que las redes de modelos y la infraestructura colaboren más, impulsando el ecosistema de IA descentralizada.

Preguntas frecuentes

¿Cuál es la diferencia clave entre 0G y Bittensor?

0G es una AI Infrastructure Layer1 que aporta computación y almacenamiento; Bittensor es una red de modelos de IA enfocada en la colaboración y distribución de incentivos.

¿A qué capa pertenece 0G en la arquitectura de IA?

0G forma parte de la capa de infraestructura de IA, especializada en entornos operativos on-chain y computación de IA.

¿Cuál es el mecanismo central de Bittensor?

Bittensor conecta nodos de modelos de IA mediante incentivos, permitiendo que los modelos compitan y reciban recompensas en la red.

¿Pueden trabajar juntos 0G y Bittensor?

Sí, operan en capas distintas del stack de IA—uno aporta infraestructura, el otro red de modelos.

¿Cuál está más orientado a la infraestructura?

0G está más orientado a la infraestructura (AI Layer1); Bittensor, a la red de aplicaciones (AI Model Layer).

Artículos relacionados

Tokenómica de RENDER: suministro, incentivos y captura de valor

La aplicación de Render en IA: cómo el hashrate descentralizado impulsa la inteligencia artificial

0x Protocol vs Uniswap: ¿Cómo se diferencian los protocolos de Libro de órdenes del modelo AMM?

¿Cuáles son los componentes principales del protocolo 0x? Análisis de la arquitectura de Relayer, Mesh y API

Tokenómica de USD.AI: análisis detallado de los casos de uso del token CHIP y los mecanismos de incentivos