Google replonge dans la course à l’IA open source avec Gemma 4

En bref

- Google a abandonné Gemma 4, une famille de modèles ouverts sous licence Apache 2.0.

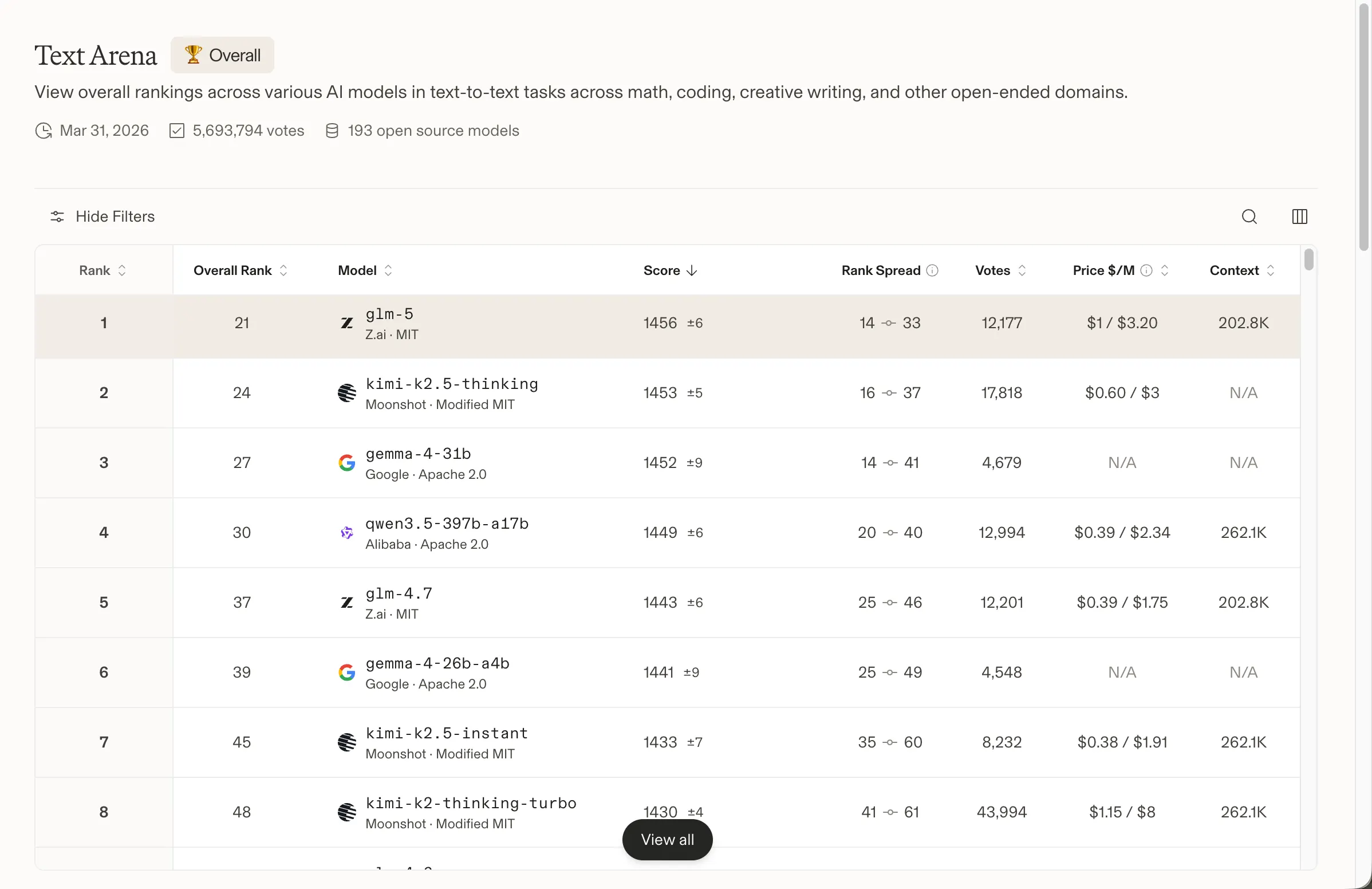

- La gamme de quatre modèles va des téléphones aux centres de données, le modèle 31B se classant déjà #3 mondialement.

- L’IA open-source américaine reçoit un coup de pouce bien nécessaire, car Gemma 4—soutenue par DeepMind—se présente comme le concurrent américain le plus solide face à DeepSeek, Qwen et à d’autres leaders chinois.

Les ambitions de Google en matière d’IA open source sont devenues bien plus sérieuses aujourd’hui. L’entreprise a publié Gemma 4, une famille de quatre modèles à poids ouverts construits sur les mêmes recherches que Gemini 3, et sous licence Apache 2.0—un écart important par rapport aux conditions plus restrictives des versions précédentes de Gemma. Les développeurs ont téléchargé les générations précédentes de Gemma plus de 400 millions de fois, donnant naissance à plus de 100 000 variantes communautaires. Cette publication est la plus ambitieuse à ce jour.

Nous venons de lancer Gemma 4 — nos modèles ouverts les plus intelligents à ce jour.

Construite à partir des mêmes recherches de niveau mondial que Gemini 3, Gemma 4 apporte une intelligence révolutionnaire directement à votre propre matériel pour des raisonnements avancés et des flux de travail agentiques.

Publiée sous licence commerciale… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) 2 avril 2026

Pendant la dernière année, le tableau de classement de l’IA open source a été largement une affaire chinoise. DeepSeek, Minimax, GLM et Qwen ont dominé les premières places, laissant les alternatives américaines courir après la pertinence. Comme l’a rapporté Decrypt l’an dernier, les modèles ouverts chinois sont passés de à peine 1,2% de l’utilisation mondiale des modèles ouverts fin 2024 à environ 30% d’ici la fin 2025, et la, de Qwen d’Alibaba a même dépassé Llama de Meta pour devenir le modèle autohébergé le plus utilisé dans le monde. Llama de Meta était autrefois le choix par défaut des développeurs qui voulaient un modèle capable, exécutable localement. Cette réputation s’est érodée—la licence contrôlée par Meta de Llama a soulevé des questions sur son véritable statut open source, et ses performances ont glissé derrière la concurrence chinoise. La famille OLMo de l’Allen Institute a tenté de combler le vide, mais sans parvenir à gagner une traction significative. OpenAI a publié ses modèles gpt-oss en août 2025, ce qui a donné un nouveau souffle à l’écosystème, mais ils n’ont jamais été conçus pour être des concurrents de pointe. Et hier, une startup américaine de 30 personnes appelée Arcee AI a publié Trinity, un modèle ouvert à 400 milliards de paramètres qui a avancé un argument convaincant selon lequel la scène américaine n’était pas totalement morte. Gemma 4 poursuit cette dynamique, cette fois avec tout le poids de Google DeepMind derrière elle, la transformant—de façon discutable—en le meilleur modèle américain dans la scène de l’IA open source. Le modèle est « construit à partir des mêmes recherches et technologies de niveau mondial que Gemini 3 », a déclaré Google dans son annonce. Gemma 4 est disponible en quatre tailles : Effective 2B et 4B pour les téléphones et les appareils edge, un modèle 26B Mixture of Experts axé sur la vitesse, et un modèle Dense 31B optimisé pour la qualité brute.

Le Dense 31B se classe actuellement troisième parmi tous les modèles ouverts du classement texte d’Arena AI. Le MoE 26B occupe la sixième place. Google affirme que les deux surpassent des modèles dont la taille est 20 fois la leur—une affirmation qui se vérifie, au moins face aux chiffres d’Arena AI, où les modèles chinois occupent encore les deux premières places.

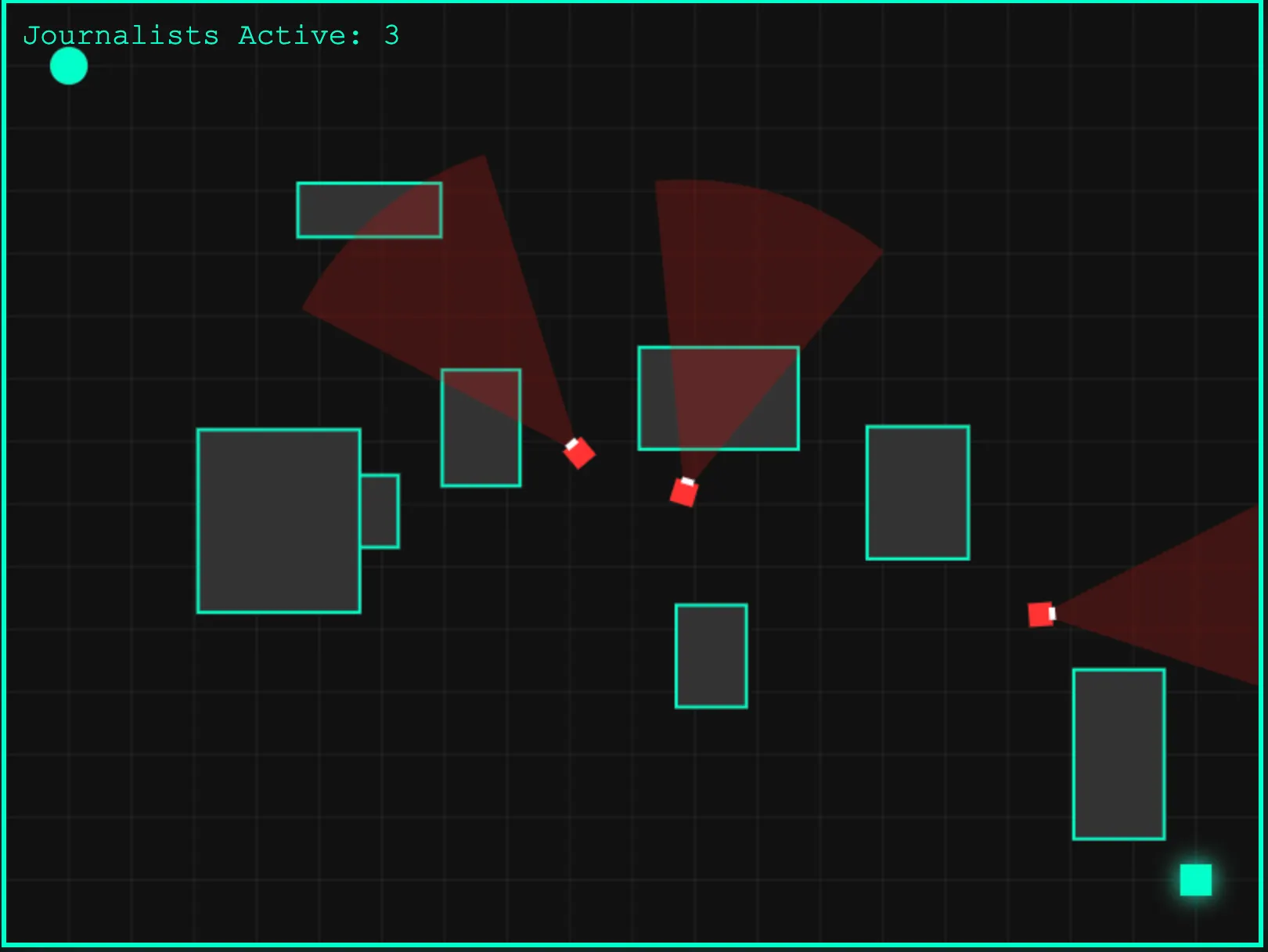

Nous avons testé Gemma 4. Elle est capable, avec quelques réserves. Le modèle applique le raisonnement même à des tâches qui n’en ont pas besoin, ce qui peut rendre les réponses plus « sur-ingéniérées » que nécessaire pour des requêtes simples. L’écriture créative est correcte—fonctionnelle, pas inspirée—et elle s’améliore probablement avec des instructions plus précises et de l’ingénierie de prompts. Là où elle a le plus clairement brillé, c’est le code. Lorsqu’on lui a demandé de générer un jeu, la sortie n’était pas particulièrement spectaculaire ni élaborée, mais elle s’est exécutée sans erreurs dès la première tentative. Pas mal pour un modèle de 41 milliards de paramètres. Cette fiabilité en zero-shot est, selon toute vraisemblance, plus précieuse qu’un résultat plus joli qui nécessite ensuite du débogage. Vous pouvez essayer le jeu ici (basique, mais fonctionnel).

Les quatre variantes couvrent tout le spectre matériel. Les modèles E2B et E4B sont conçus pour les téléphones Android, Raspberry Pi et les appareils edge, et fonctionnent entièrement hors ligne avec une latence quasi nulle, une entrée audio native et une fenêtre de contexte de 128K. Les modèles 26B et 31B visent les postes de travail et les déploiements cloud, étendant le contexte à 256K et ajoutant l’appel de fonctions natif ainsi qu’une sortie JSON structurée pour construire des agents autonomes. Les quatre modèles traitent les images et la vidéo nativement. Les poids en pleine précision des modèles les plus grands tiennent sur un seul GPU NVIDIA H100 de 80GB ; des versions quantifiées tournent sur du matériel grand public. La licence Apache 2.0 est l’autre gros titre. Les précédentes publications de Gemma de Google utilisaient une licence personnalisée qui créait une ambiguïté juridique pour les produits commerciaux. Apache 2.0 supprime entièrement cette friction—les développeurs peuvent modifier, redistribuer et commercialiser sans avoir à se soucier du fait que Google change les termes plus tard. Le cofondateur de Hugging Face, Clement Delangue, l’a saluée, en disant que « Local AI a son moment », et que c’est l’avenir de l’industrie de l’IA. Le PDG de Google DeepMind, Demis Hassabis, est allé encore plus loin en qualifiant Gemma 4 de « meilleurs modèles ouverts au monde pour leurs tailles respectives ».

Ravi de lancer Gemma 4 : les meilleurs modèles ouverts au monde pour leurs tailles respectives. Disponible en 4 tailles pouvant être ajustées pour votre tâche spécifique : 31B dense pour des performances brutes excellentes, 26B MoE pour une faible latence, et effective 2B & 4B pour l’usage sur appareils edge — bon build ! pic.twitter.com/Sjbe3ph8xr

— Demis Hassabis (@demishassabis) 2 avril 2026

C’est une affirmation forte. Les systèmes propriétaires d’Anthropic, d’OpenAI et du propre Gemini de Google continuent de dominer les benchmarks les plus difficiles. Mais pour des modèles à poids ouverts que vous pouvez exécuter localement, modifier librement et déployer sur votre propre infrastructure ? La concurrence s’est nettement amincie. Vous pouvez essayer Gemma 4 dès maintenant dans Google AI Studio (31B et 26B) ou dans Google AI Edge Gallery (E2B et E4B). Les poids du modèle sont aussi disponibles sur Hugging Face, Kaggle et Ollama.