OpenAI、GPT-5.4 MiniとNanoをリリース、より大きなモデルよりも役立つ可能性

要点

- OpenAIは、ハイボリュームのAIワークロード向けに設計された、より高速で安価なモデルのGPT-5.4 MiniとNanoをリリースしました。

- これらのモデルは、精度をやや犠牲にして速度とコストを重視し、顧客サポートや自動化されたワークフローなどの反復的で簡単なタスクをターゲットにしています。

- 開発者は、フラッグシップモデルがタスクを計画し、小型モデルが大部分の作業を担当するハイブリッドAIシステムを運用できるようになりました。

OpenAIは勢いを止めません。GPT-5.4のリリースからわずか2週間足らず、GPT-5.3のリリースからわずか2日後の火曜日に、さらに2つのモデルを発表しました:GPT-5.4 MiniとGPT-5.4 Nanoです。 これらはフラッグシップモデルの簡略版ではなく、待ち時間が許されないような作業に特化した目的別のマシンです。 OpenAIはこれらを「これまでで最も能力の高い小型モデル」と呼び、GPT-5.4 MiniはGPT-5 Miniの2倍以上の速度を誇ると述べています。もしあなたが、45秒間考え込むコーディングアシスタントを見たことがあるなら、速いモデルの魅力がわかるでしょう。

私たちはGPT-5.4 miniとnanoを導入します。これまでで最も能力の高い小型モデルです。

GPT-5.4 miniはGPT-5 miniの2倍以上の速度で、コーディング、コンピュータ利用、多モーダル理解、サブエージェントに最適化されています。

より軽量なタスクには、GPT-5.4 nanoが最も小さく最も安価です… pic.twitter.com/cdp5HWtM2M

— OpenAI開発者 (@OpenAIDevs) 2026年3月17日

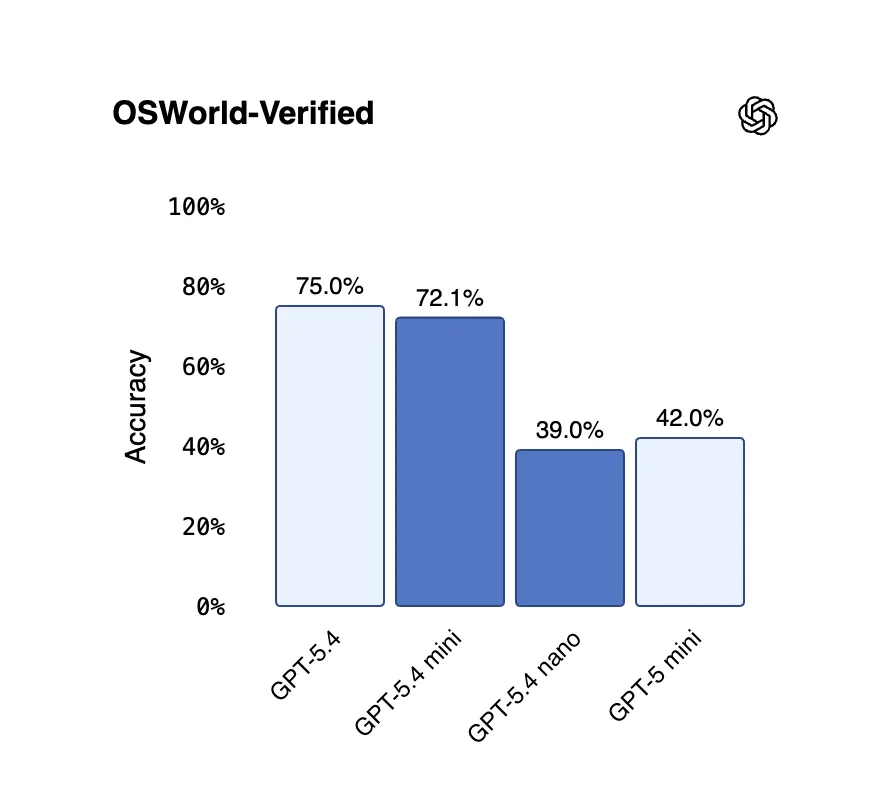

では、なぜ意図的に精度の低いモデルをリリースするのでしょうか?短い答えは、精度が常にボトルネックではないからです。もしあなたが、1日中同じ200の質問に答えるカスタマーサポートチャットボットを運用しているなら、PhDレベルの化学試験で最高得点を取ったモデルは必要ありません。1秒以内に応答し、返信あたりのコストが数分の一のモデルが必要です。これらのモデルは、そのために作られています。 しかし、これらのモデルが馬鹿だったり信頼できないわけではありません。コーディングのベンチマークでは、GPT-5.4 MiniはSWE-Bench Proで54.4%のスコアを獲得しています。これは、実際のGitHubの問題を修正する能力を測るテストで、旧GPT-5 Miniの45.7%、フルGPT-5.4の57.7%に比べて高い値です。 OSWorld-Verifiedでは、スクリーンショットを読んで実際にデスクトップコンピュータを操作できる能力を測定し、Miniは72.1%を記録し、フラッグシップの75.0%に迫っています。両者とも人間の基準値72.4%を超えています。一方、GPT-5.4 NanoはSWE-Bench Proで52.4%、OSWorldで39.0%と、Miniより低いですが、従来のNanoクラスモデルよりは大きく進歩しています。

「GPT-5.4は、私たちの内部評価においてMiniとNanoの両モデルの進歩を示しています」と、Perplexityの副CTOジェリー・マは両モデルのテスト後に述べました。「Miniは強力な推論能力を持ち、Nanoはライブの会話ワークフローにおいて応答性と効率性に優れています。」 高価なフラッグシップモデルをすべてのタスクにルーティングする代わりに、大きなモデルが計画と調整を行い、小型モデルが実際の作業を並行して処理するシステムを構築できるようになりました。たとえば、コードベースの検索やドキュメントの読取、フォームの処理などです。GPT-5.4とGrok 4.20の比較でも見られたように、モデルの配置場所は選択と同じくらい重要です。 GPT-5.4 MiniはAPI経由で、入力トークン1百万あたり0.75ドル、出力トークン1百万あたり4.50ドルの料金で動作します。GPT-5.4 Nanoはさらに安価で、入力トークン1百万あたり0.20ドル、出力トークン1百万あたり1.25ドルです。これは、多くのクエリを日常的に処理するスタートアップにとって経済的に現実的な価格設定です。参考までに、Nanoは入力に関してMiniの約4分の1のコストです。 一般的なChatGPTユーザーは、今日から「Thinking」オプションをPlusメニューから選択することで、GPT-5.4 Miniを無料およびGoユーザー向けに利用できます。GPT-5.4のレート制限に達した有料サブスクライバーは自動的にMiniに切り替わります。一方、GPT-5.4 Nanoは現時点ではAPI専用であり、OpenAIはこれを開発者向けツールとして位置付けていることが明らかです。