A Google volta a entrar na corrida de IA de código aberto com o Gemma 4

Em resumo

- A Google descontinuou a Gemma 4, uma família de modelos abertos sob a licença Apache 2.0.

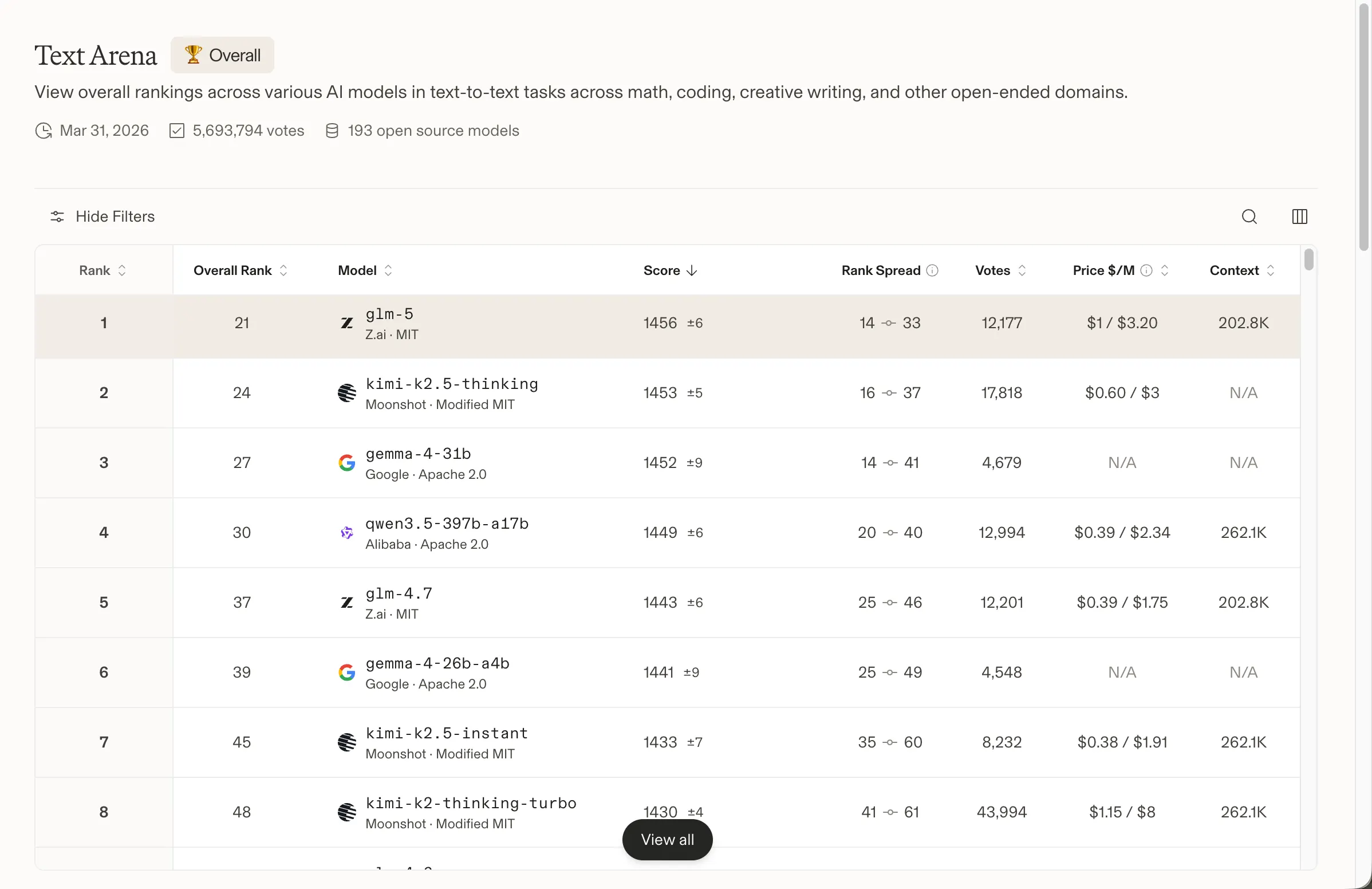

- A linha de quatro modelos vai de telemóveis a centros de dados, com o modelo de 31B já a ocupar o #3 a nível global.

- A IA open-source dos EUA recebe um impulso necessário, já que a Gemma 4—apoiada pela DeepMind—se posiciona como a opção americana mais forte face ao DeepSeek, Qwen e outros líderes chineses.

As ambições de IA aberta da Google tornaram-se muito mais sérias hoje. A empresa lançou a Gemma 4, uma família de quatro modelos abertos com pesos, construída com base na mesma investigação que a Gemini 3, e licenciada sob a Apache 2.0—uma mudança significativa face aos termos mais restritivos nas versões anteriores da Gemma. Os programadores descarregaram gerações anteriores da Gemma mais de 400 milhões de vezes, dando origem a mais de 100.000 variantes da comunidade. Este lançamento é o mais ambicioso de sempre.

Acabámos de lançar a Gemma 4 — os nossos modelos abertos mais inteligentes até hoje.

Construída com base na mesma investigação de classe mundial que a Gemini 3, a Gemma 4 leva inteligência revolucionária diretamente para o seu próprio hardware, para raciocínio avançado e fluxos de trabalho orientados por agentes.

Lançada sob uma licença comercial… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) 2 de abril de 2026

Durante o último ano, o ranking da liderança da IA open-source foi, em grande medida, um assunto de origem chinesa. A DeepSeek, a Minimax, a GLM e a Qwen dominaram os primeiros lugares, deixando as alternativas americanas a lutar pela relevância. Como a Decrypt noticiou no ano passado, os modelos abertos chineses passaram de apenas cerca de 1,2% do uso global de modelos abertos no final de 2024 para aproximadamente 30% até ao fim de 2025, com o Qwen da Alibaba até a ultrapassar o Llama da Meta como o modelo self-hosted mais utilizado a nível mundial. O Llama da Meta costumava ser a escolha por defeito para programadores que queriam um modelo capaz, executável localmente. Essa reputação foi-se desgastando— a licença controlada pela Meta levantou dúvidas sobre o seu verdadeiro estatuto de open-source, e o desempenho ficou aquém da concorrência chinesa. A família OLMo da Allen Institute tentou preencher a lacuna, mas não conseguiu ganhar tração significativa. A OpenAI lançou os seus modelos gpt-oss em agosto de 2025, o que trouxe um novo fôlego ao ecossistema, mas nunca foram concebidos para ser concorrentes de fronteira. E ontem, uma startup dos EUA com 30 pessoas chamada Arcee AI lançou a Trinity, um modelo aberto com 400 mil milhões de parâmetros que fez um argumento convincente de que o cenário americano não estava completamente morto. A Gemma 4 segue esse impulso, desta vez com todo o peso da Google DeepMind a apoiá-la, transformando-a, de forma discutível, no melhor modelo americano no panorama de IA open-source. O modelo é “construído com base na mesma investigação e tecnologia de classe mundial que a Gemini 3”, disse a Google no seu anúncio. A Gemma 4 chega em quatro tamanhos: Effective 2B e 4B para telemóveis e dispositivos de ponta, um modelo de 26B Mixture of Experts focado na velocidade, e um modelo Dense de 31B otimizado para qualidade “crua”.

O Dense de 31B ocupa atualmente o terceiro lugar entre todos os modelos abertos no leaderboard de texto da Arena AI. O MoE de 26B está em sexto. A Google afirma que ambos superam modelos até 20 vezes o seu tamanho—uma afirmação que se sustenta, pelo menos face aos números da Arena AI, em que os modelos chineses ainda ocupam os dois primeiros lugares.

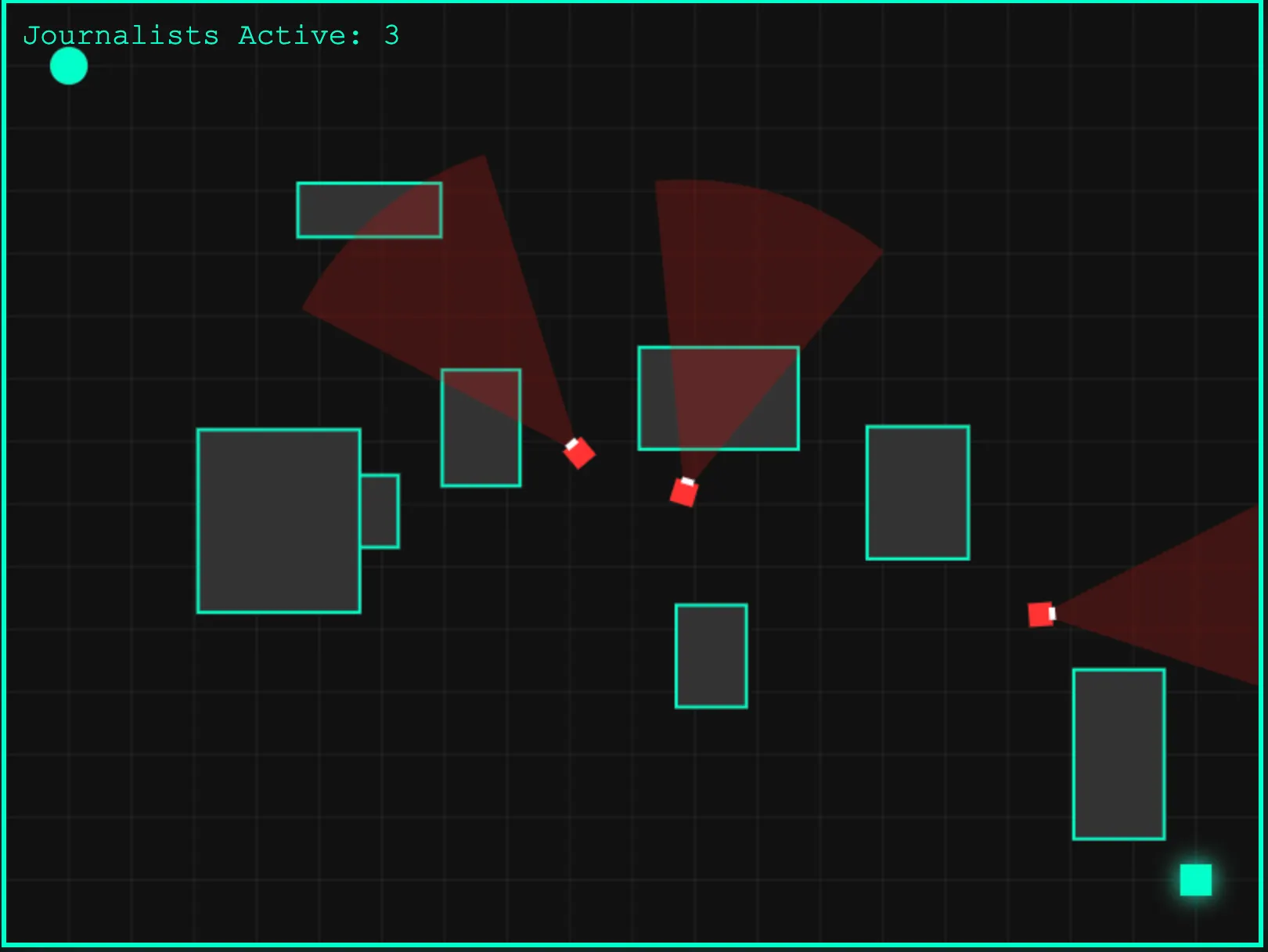

Testámos a Gemma 4. É capaz, com algumas ressalvas. O modelo aplica raciocínio mesmo a tarefas que não o exigem, o que pode fazer com que as respostas pareçam demasiado “engenheiradas” para prompts simples. A escrita criativa é decente—funcional, mas não inspirada—e provavelmente melhora com orientação mais específica e engenharia de prompts. Onde ficou mais claramente a destacar foi em código. Quando lhe foi pedido para gerar um jogo, a saída não foi particularmente vistosa nem elaborada, mas correu sem erros na primeira tentativa. Não é mau para um modelo com 41 mil milhões de parâmetros. Essa fiabilidade zero-shot é, de forma discutível, mais valiosa do que um resultado mais bonito que precisa de depuração. Pode experimentar o jogo aqui (básico, mas funcional).

As quatro variantes cobrem todo o espetro de hardware. Os modelos E2B e E4B são construídos para telemóveis Android, Raspberry Pi e dispositivos de ponta, correndo completamente offline com latência quase zero, entrada nativa de áudio e uma janela de contexto de 128K. Os modelos 26B e 31B destinam-se a estações de trabalho e implementações na nuvem, alargando o contexto para 256K e adicionando chamada nativa de funções e saída JSON estruturada para construir agentes autónomos. Todos os quatro modelos processam imagens e vídeo de forma nativa. Os pesos com precisão total dos modelos maiores cabem numa única GPU NVIDIA H100 de 80GB; versões quantizadas correm em hardware de consumo. A licença Apache 2.0 é o outro destaque. As anteriores versões da Gemma da Google usaram uma licença personalizada que criou ambiguidade legal para produtos comerciais. A Apache 2.0 remove esse atrito por completo—os programadores podem modificar, redistribuir e comercializar sem se preocuparem com a Google mudar os termos mais tarde. O cofundador da Hugging Face, Clement Delangue, elogiou-a, dizendo que “A IA local está a chegar à sua vez” e que é o futuro da indústria da IA. O CEO da Google DeepMind, Demis Hassabis, foi ainda mais longe, chamando à Gemma 4 “os melhores modelos abertos do mundo para os respetivos tamanhos”.

Animado por lançar a Gemma 4: os melhores modelos abertos do mundo para os respetivos tamanhos. Disponível em 4 tamanhos que podem ser afinados para a tua tarefa específica: 31B dense para grande desempenho “cru”, 26B MoE para baixa latência, e effective 2B & 4B para uso em dispositivos de ponta - feliz construção! pic.twitter.com/Sjbe3ph8xr

— Demis Hassabis (@demishassabis) 2 de abril de 2026

Essa é uma afirmação forte. Sistemas proprietários da Anthropic, OpenAI e da própria Gemini da Google ainda lideram nos benchmarks mais difíceis. Mas para modelos com pesos abertos que pode correr localmente, modificar livremente e implementar na sua própria infraestrutura? A concorrência ficou significativamente mais ténue. Pode experimentar agora a Gemma 4 no Google AI Studio (31B e 26B) ou no Google AI Edge Gallery (E2B e E4B). Os pesos do modelo também estão disponíveis no Hugging Face, Kaggle e Ollama.