KI-Vertreter haben bereits mehr als die Hälfte des Internetverkehrs übernommen, doch das Vertrauen sinkt drastisch: Entdeckung, Identität, Ruf – die drei großen Hürden bei der Skalierung

AI-Proxy-Traffic hat die menschliche Überlegenheit übertroffen und macht 51 % der gesamten Online-Aktivität aus. Das Vertrauen in vollständig autonome Proxy-Systeme ist jedoch von 43 % auf 22 % gesunken. Damit die Proxy-Ökonomie wirklich funktioniert, sind drei grundlegende Infrastruktur-Schichten unerlässlich: Auffindbarkeit, Identitätsprüfung und Reputationssysteme. Dieser Artikel basiert auf dem Werk Vaidik Mandloi „Know your Agent“, redaktionell bearbeitet und übersetzt von Dongqu.

(Frühere Zusammenfassung: Russland plant die Einführung eines „Stablecoin-Gesetzes“, das voraussichtlich im Juli in Kraft tritt, mit großem Potenzial für grenzüberschreitende Zahlungen mit Stablecoins.)

(Hintergrund: Das FBI in den USA hat John Daghita verhaftet! Nach dem Diebstahl von 46 Millionen US-Dollar an Kryptowährungen durch ihn, zeigt er protzig seinen Reichtum.)

Der Versprechen, dass AI-Proxy die Internetlandschaft verändern wird, wird zunehmend Realität. Sie sind längst mehr als experimentelle Tools in Chatfenstern und werden zu einem integralen Bestandteil unseres Alltags – vom Aufräumen des Posteingangs, über Terminplanung bis hin zur Beantwortung von Support-Tickets. Sie steigern unbemerkt die Produktivität, doch diese Veränderung wird oft übersehen.

Doch dieses Wachstum ist kein Gerücht.

Bis 2025 wird automatisierter Traffic menschlichen Traffic übertreffen und 51 % des gesamten Netzwerks ausmachen. Allein in den USA ist der AI-gesteuerte Traffic auf Retail-Websites im Jahresvergleich um 4700 % gestiegen. AI-Proxy agieren systemübergreifend: Viele können auf Daten zugreifen, Workflows auslösen und sogar Transaktionen initiieren.

Allerdings ist das Vertrauen in vollständig autonome Proxy innerhalb eines Jahres von 43 % auf 22 % gefallen, vor allem wegen zunehmender Sicherheitsvorfälle. Fast die Hälfte der Unternehmen nutzt noch immer geteilte API-Schlüssel zur Authentifizierung ihrer Proxy, obwohl diese Methode nie für autonome Systeme konzipiert wurde, um Werte zu übertragen oder eigenständig zu handeln.

Das Problem liegt darin: Die Erweiterung der Proxy-Tools übertrifft die Infrastruktur, die sie regeln soll.

Als Reaktion entstehen neue Protokollschichten. Stablecoins, API-Integrationen und Standards wie x402 ermöglichen maschineninitiierte Transaktionen. Gleichzeitig werden neue Identitäts- und Authentifizierungsschichten entwickelt, um Proxy in strukturierten Umgebungen zu erkennen und zu steuern.

Doch Zahlungsabwicklung ist nicht gleich Wirtschaftstätigkeit. Sobald Proxy Werte übertragen können, treten grundlegendere Fragen auf: Wie finden sie passende Dienste in maschinenlesbarer Form? Wie beweisen sie ihre Identität und Berechtigung? Wie verifizieren wir, dass die von ihnen behaupteten Aktionen tatsächlich ausgeführt wurden?

Dieser Artikel untersucht die Infrastruktur, die für groß angelegte, proxy-gesteuerte Wirtschaftstätigkeit notwendig ist, und bewertet, ob diese Schichten ausgereift genug sind, um dauerhaft und autonom zu agierenden Teilnehmern im Maschinen-Tempo zu ermöglichen.

Proxy kann nicht kaufen, was es nicht sieht

Bevor Proxy für Dienste bezahlt, muss es diese erst finden. Das klingt einfach, ist aber derzeit die größte Hürde.

Das Internet ist für menschliches Lesen gebaut. Bei Suchanfragen liefert die Suchmaschine eine Rangliste. Diese Seiten sind für Überzeugungskraft optimiert, voll mit Layouts, Trackern, Werbung, Navigation und Stil-Elementen – für Menschen sinnvoll, für Maschinen meist nur „Rauschen“.

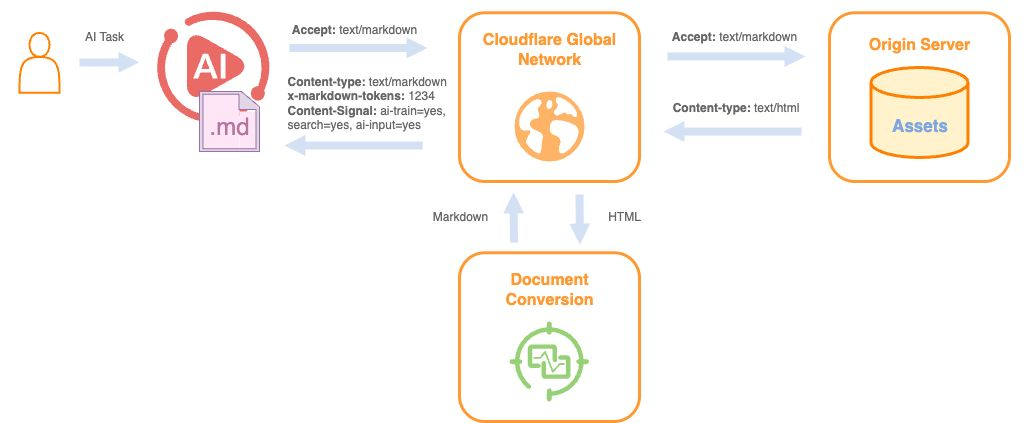

Wenn Proxy dieselbe Seite anfragt, erhält es den Roh-HTML-Code. Ein typischer Blog- oder Produktseiten-Artikel umfasst in dieser Form etwa 16.000 Tokens. In sauberem Markdown reduziert sich die Zahl auf ca. 3.000 Tokens – eine Reduktion um 80 %. Für eine einzelne Anfrage mag das unwichtig sein. Doch bei Tausenden solcher Anfragen über mehrere Dienste hinweg summiert sich die Verarbeitung auf Verzögerungen, Kosten und erhöhte Komplexität.

@Cloudflare

Proxy investieren viel Rechenleistung, um Interface-Elemente zu entfernen und an die Kerninformationen zu gelangen, die für Aktionen notwendig sind. Diese Mühe verbessert die Ausgabequalität nicht, sondern kompensiert nur ein Netzwerk, das nie für sie entworfen wurde.

Mit wachsendem Traffic wird diese Ineffizienz deutlicher. AI-gesteuerte Crawler auf Einzelhandels- und Software-Websites haben im letzten Jahr stark zugenommen und machen den Großteil des Netzwerks aus.

Gleichzeitig blockieren etwa 79 % der führenden Nachrichten- und Content-Websites mindestens einen AI-Crawler. Aus ihrer Sicht ist das verständlich: Proxy extrahieren Inhalte, ohne mit Werbung, Abonnements oder traditionellen Conversion-Trichtern zu interagieren. Das Blockieren schützt ihre Einnahmen.

Das Problem ist, dass das Internet keine zuverlässige Methode hat, bösartige Crawler von legitimen Proxy zu unterscheiden. Beide erscheinen als automatisierter Traffic, stammen aus Cloud-Infrastrukturen und sehen für das System gleich aus.

Tiefergehendes Problem: Proxy „konsumieren“ Seiten nicht, sie versuchen, Handlungsmöglichkeiten zu entdecken.

Wenn Menschen nach „Flügen unter 500 USD“ suchen, reicht eine Rangliste. Sie können Optionen vergleichen und entscheiden. Proxy braucht jedoch etwas ganz anderes: Es muss wissen, welche Dienste Buchungen annehmen, welche Eingabeformate erforderlich sind, wie Preise berechnet werden und ob Zahlungen programmatisch abwickelbar sind. Viele Dienste machen diese Informationen jedoch nicht klar öffentlich zugänglich.

@TowardsAI

Deshalb verschiebt sich die Suche vom SEO (Search Engine Optimization) hin zu Agentenorientierter Auffindbarkeit (Agent-Oriented Discoverability, AEO). Wenn der Endnutzer ein Proxy ist, wird die Platzierung in Suchergebnissen weniger relevant. Entscheidend ist, ob Dienste ihre Fähigkeiten in einer maschinenlesbaren Sprache beschreiben, die Proxy ohne Rätsel verstehen kann. Andernfalls könnten sie im wachsenden Anteil der Wirtschaftstätigkeit „unsichtbar“ werden.

Proxy braucht Identität

@Hackernoon

Sobald Proxy Dienste findet und Transaktionen initiiert, besteht der nächste zentrale Schritt darin, dass die andere Seite weiß, mit wem sie es zu tun hat – also: Identität.

Heutige Finanzsysteme verwenden viel mehr maschinenbezogene Identitäten als menschliche. Das Verhältnis liegt bei etwa 96:1. API-Keys, Service-Accounts, Automatisierungsskripte und interne Proxy dominieren die Infrastruktur. Die meisten wurden nie für die Verwaltung von Kapital mit Diskretion entworfen. Sie führen vordefinierte Befehle aus, verhandeln nicht, wählen keine Anbieter und können keine Zahlungen im offenen Netz initiieren.

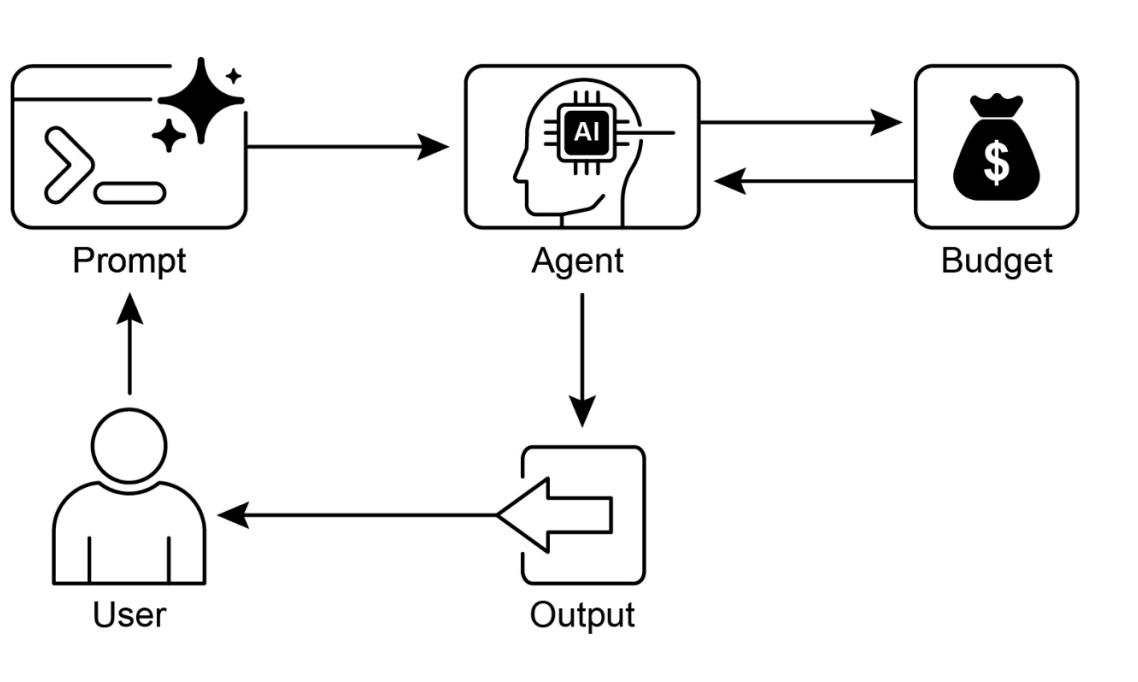

Autonome Proxy verändern diese Grenzen. Wenn ein Proxy direkt Stablecoins verschieben oder Zahlungsprozesse auslösen kann, ohne manuelle Bestätigung, verschiebt sich die Frage von „Kann es bezahlen?“ zu „Wer autorisiert es?“.

Hier wird Identität grundlegend: Das Konzept „Know Your Agent“ (Kenne deinen Proxy) entsteht.

Wie bei Finanzinstituten vor der Transaktion eine Verifizierung durchführen, müssen Dienste, die mit autonomen Proxy interagieren, vor der Kapitalfreigabe oder sensiblen Operationen drei Dinge prüfen:

- Kryptografische Authentizität: Kontrolliert der Proxy wirklich die Schlüssel, die er angibt?

- Bevollmächtigung: Wer hat dem Proxy die Erlaubnis erteilt, und welche Grenzen bestehen?

- Bezug zur realen Welt: Ist der Proxy mit einer rechtlich verantwortlichen Entität verbunden?

Diese Prüfungen bilden den sogenannten Identitäts-Stack:

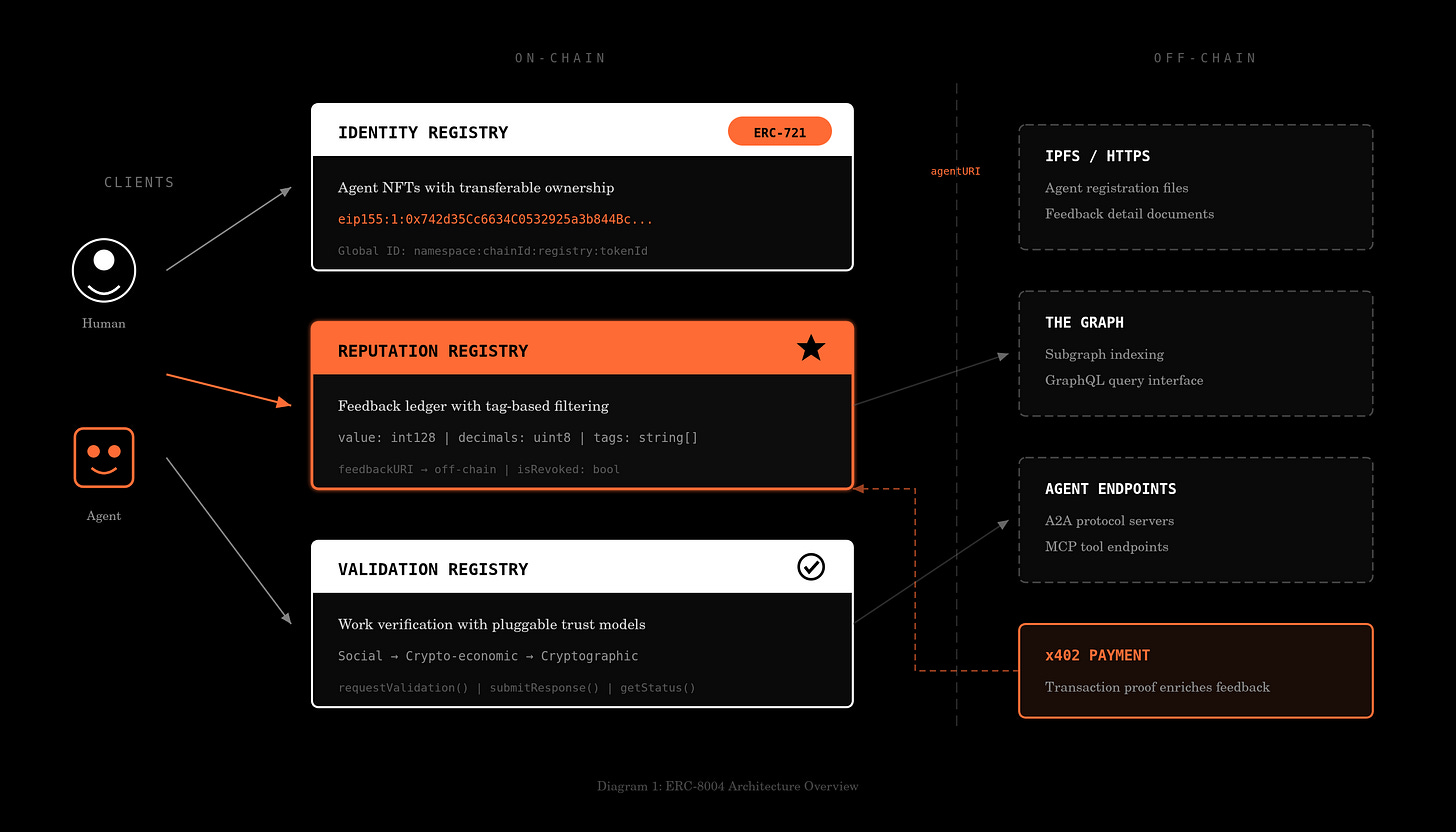

- Basis: Kryptografische Schlüsselgenerierung und Signaturen. Standards wie ERC-8004 versuchen, die Registrierung von Proxy-Identitäten auf der Chain zu formalisieren.

- Mittelschicht: Identitätsanbieter. Sie verbinden Schlüssel mit realen Entitäten wie Firmen, Finanzinstituten oder verifizierten Personen. Ohne diese Bindung kann eine Signatur nur Kontrolle, aber keine Verantwortlichkeit beweisen.

- Oberste Schicht: Verifizierungsinfrastruktur. Zahlungsdienstleister, CDN oder Anwendungsserver prüfen Signaturen, verifizieren Zertifikate und setzen Berechtigungsgrenzen in Echtzeit. Das Trusted Agent Protocol von Visa ist ein Beispiel, das Händlern erlaubt, Proxy-Authorisierung für Transaktionen im Namen eines Nutzers zu verifizieren. Stripe’s ACP bringt ähnliche Prüfungen in programmierbare Zahlungen und Stablecoin-Transaktionen.

Gleichzeitig entwickeln Google und Shopify das Universal Commerce Protocol (UCP), das Händlern ermöglicht, Listen von Fähigkeiten zu veröffentlichen, die Proxy entdecken und aushandeln können. Es wird als Orchestrierungsebene fungieren und soll in Google Search und Gemini integriert werden.

@FintechBrainfood

Wichtig ist, dass offene und genehmigte Systeme koexistieren.

Auf öffentlichen Blockchains können Proxy ohne zentrale Hürden Transaktionen durchführen, was Geschwindigkeit und Kompatibilität erhöht, aber auch regulatorische Herausforderungen verschärft. Der Erwerb von Bridge durch Stripe zeigt diese Spannung. Stablecoins ermöglichen sofortige grenzüberschreitende Überweisungen, doch regulatorische Pflichten entfallen nicht, nur weil die Abwicklung on-chain erfolgt.

Diese Spannung zieht unweigerlich Regulierungsbehörden an. Sobald autonome Proxy ohne direkte menschliche Aufsicht Finanztransaktionen starten und mit Märkten interagieren, wird Verantwortlichkeit unvermeidlich. Das Finanzsystem darf Kapital nicht durch unidentifizierte oder unautorisierte Akteure fließen lassen, auch wenn diese nur Softwarefragmente sind.

Regulatorische Rahmenwerke werden bereits übernommen. Das „Colorado AI Act“ tritt am 1. Februar 2026 in Kraft und bringt Verantwortlichkeitsanforderungen für Hochrisiko-Automatisierungssysteme. Ähnliche Gesetze werden weltweit vorangetrieben. Mit zunehmender großflächiger Entscheidungsfindung durch Proxy wird Identität kein optionales Merkmal mehr sein. Wenn Auffindbarkeit Proxy sichtbar macht, ist Identität das Zertifikat, das sie anerkennt.

Verifikation der Proxy-Ausführung und Reputation

Wenn Proxy Aufgaben im Zusammenhang mit Geld, Verträgen oder sensiblen Daten übernimmt, reicht eine bloße Identität nicht aus. Ein verifizierter Proxy kann immer noch Illusionen erzeugen, seine Arbeit verzerren, Informationen offenlegen oder schlecht performen.

Das wichtigste ist daher: Kann man nachweisen, dass Proxy tatsächlich die behauptete Arbeit ausgeführt hat?

Wenn ein Proxy behauptet, 1.000 Dateien analysiert, Betrugsmuster erkannt oder Transaktionen ausgeführt zu haben, braucht es eine Methode, um zu verifizieren, dass diese Berechnungen wirklich stattgefunden haben und die Ergebnisse nicht gefälscht oder beschädigt sind. Dafür benötigen wir eine Effizienzschicht.

Derzeit gibt es drei Ansätze:

- Trusted Execution Environments (TEEs): Hardware-basierte Beweise, z. B. via AWS Nitro oder Intel SGX. Proxy läuft in einer sicheren Enklave, die kryptografische Zertifikate ausstellt, um zu bestätigen, dass der Code auf bestimmten Daten unverändert ausgeführt wurde. Der Overhead ist gering (ca. 5-10 % zusätzliche Latenz). Für hochintegritätskritische Anwendungsfälle im Finanz- und Unternehmensbereich ist das akzeptabel.

- Zero-Knowledge Machine Learning (ZKML): Mathematische Beweise. Proxy kann verschlüsselte Nachweise generieren, die belegen, dass die Ausgabe von einem bestimmten Modell stammt, ohne das Modell oder private Eingaben offenzulegen. Das DeepProve-1 von Lagrange Labs demonstriert kürzlich Zero-Knowledge-Beweise für GPT-2-Inferenz, die 54-158 Mal schneller sind als frühere Ansätze.

- Restake-Sicherheit: Ökonomische Anreize statt Rechenleistung. Protokolle wie EigenLayer setzen auf Stake-basierte Sicherheit: Validatoren hinter Proxy-Ausgaben müssen Kapital hinterlegen. Bei Zweifeln an der Korrektheit kann dieses „Slashing“ das Stake entziehen. Das System beweist nicht jede Berechnung, sondern macht unehrliches Verhalten wirtschaftlich unattraktiv.

Diese Mechanismen lösen dasselbe Problem aus unterschiedlichen Blickwinkeln. Doch die Beweisführung ist episodisch. Sie verifiziert einzelne Aufgaben, aber die Gesellschaft braucht eine kumulative Historie. Hier wird Reputation entscheidend: Sie wandelt einzelne Nachweise in eine langfristige Leistungsbilanz um. Neue Systeme zielen darauf ab, Proxy-Leistung portabel und kryptografisch verankert zu machen, anstatt auf plattformspezifische Bewertungen oder intransparente Dashboards zu setzen.

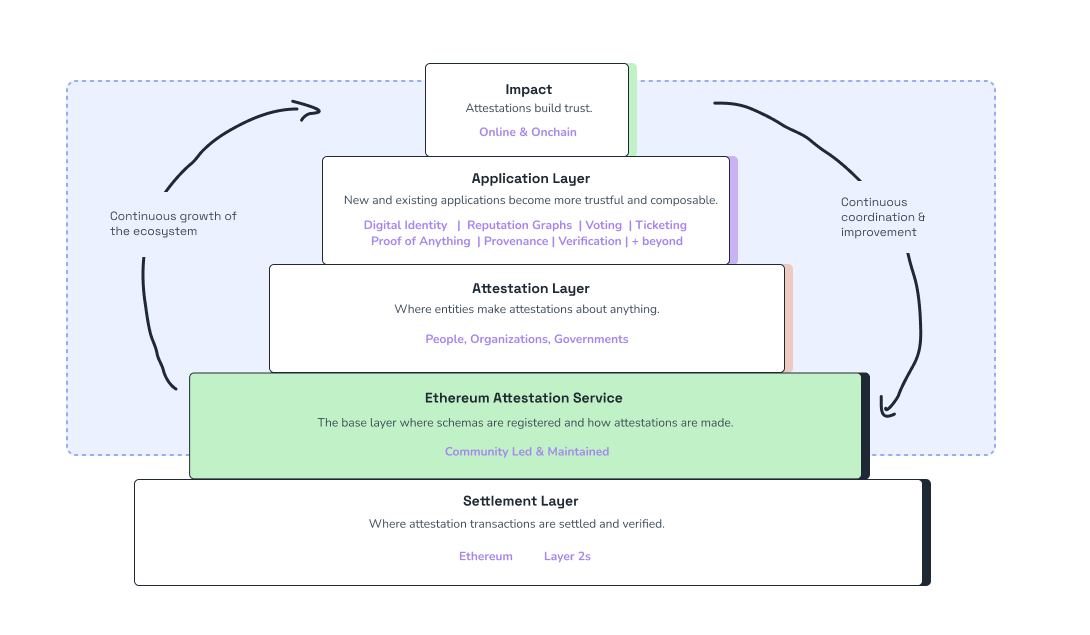

Ethereum’s Proof Service (EAS) erlaubt Nutzern oder Diensten, signierte, on-chain Nachweise über Proxy-Verhalten zu veröffentlichen. Erfolgreiche Aufgaben, präzise Vorhersagen oder regelkonforme Transaktionen können so fälschungssicher dokumentiert und über Anwendungen hinweg übertragen werden.

@EAS

Wettbewerbsfähige Benchmark-Umgebungen entstehen ebenfalls. Proxy-Arenen (Agent Arenas) bewerten Proxy anhand standardisierter Aufgaben und verwenden Elo- oder ähnliche Bewertungssysteme. Recall Network berichtet, dass über 110.000 Teilnehmer 5,88 Millionen Vorhersagen generierten und so messbare Leistungsdaten lieferten. Mit der Erweiterung dieser Systeme entwickeln sie sich zu echten Bewertungsmärkten für AI-Proxy.

Dadurch kann Reputation plattformübergreifend getragen werden.

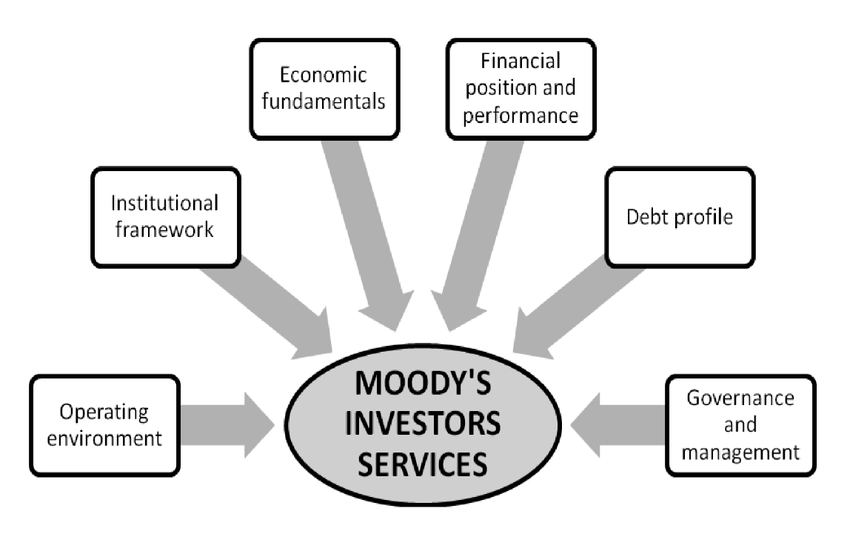

In der traditionellen Finanzwelt bewerten Institutionen wie Moody’s Anleihen, um Kredit-Signale zu senden. Proxy-Ökonomien benötigen eine vergleichbare Ebene, um nicht-menschliche Akteure zu bewerten. Der Markt muss einschätzen, ob ein Proxy zuverlässig genug ist, um Kapital anzuvertrauen, ob seine Ausgaben statistisch konsistent sind und ob sein Verhalten langfristig stabil bleibt.

Fazit

Mit wachsendem Einfluss von Proxy-Systemen wird eine klare Methode zur Messung ihrer Zuverlässigkeit notwendig. Proxy werden mit verifizierten Ausführungs- und Benchmark-Daten ausgestattet, ihre Bewertungen passen sich bei Qualitätsverlust an, und Berechtigungen sind nachvollziehbar. Versicherer, Händler und Regulierungsbehörden werden diese Daten nutzen, um zu entscheiden, welche Proxy Zugriff auf Kapital, Daten oder regulierte Workflows erhalten.

Kurz gesagt, diese Schichten bilden die Infrastruktur der Proxy-Ökonomie:

- Auffindbarkeit (Discoverability): Proxy müssen Dienste maschinenlesbar finden können, sonst verpassen sie Chancen.

- Identität (Identity): Proxy müssen beweisen, wer sie sind und wer sie autorisiert hat, sonst können sie nicht teilnehmen.

- Reputation (Reputation): Proxy müssen vertrauenswürdige, verifizierte Leistungsnachweise aufbauen, um dauerhaft wirtschaftlich glaubwürdig zu sein.