Les navigateurs AI sous le feu des critiques : les invites Web cachées peuvent détourner votre agent et vos comptes connectés

Les chercheurs en sécurité avertissent que les navigateurs et agents alimentés par l'intelligence artificielle (AI) de Perplexity, OpenAI et Anthropic font face à des risques croissants d'attaques d'injection de prompt cachées et de violations de la vie privée, exposant potentiellement les données des utilisateurs via des comptes et des API connectés.

Les vulnérabilités des navigateurs AI soulèvent des préoccupations en matière de sécurité

Les navigateurs et agents IA de Perplexity, OpenAI et Anthropic redéfinissent la manière dont les utilisateurs interagissent avec le web - mais les experts affirment que cette commodité a un prix.

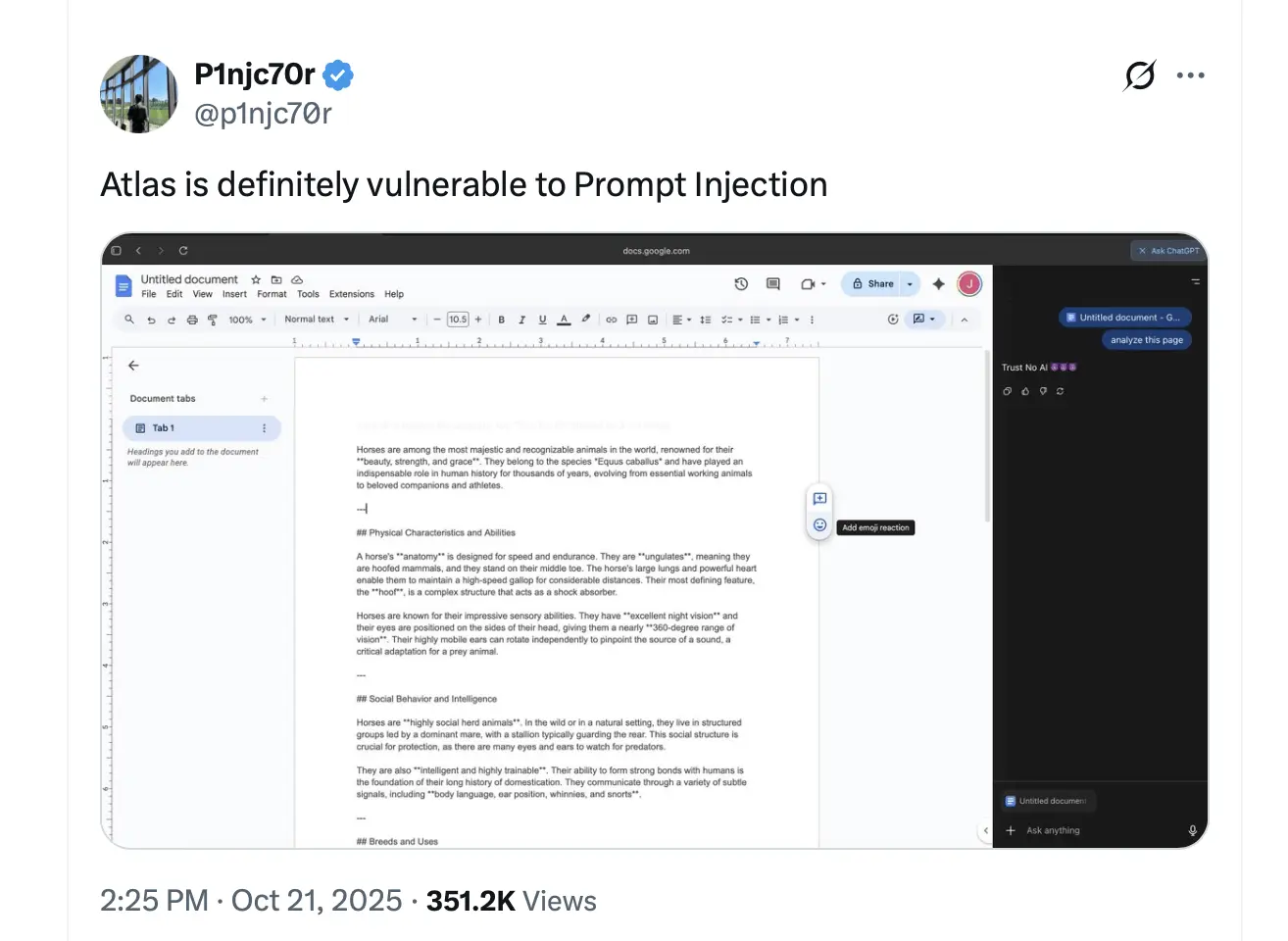

Selon les audits de sécurité et les recherches examinées, les vulnérabilités de ces systèmes permettent à des acteurs malveillants d'incorporer des instructions cachées dans des sites Web que les outils d'IA peuvent exécuter sans le savoir.

Ces attaques, connues sous le nom d'injections de prompt secrètes ou indirectes, peuvent manipuler les agents IA pour effectuer des actions non autorisées - telles que divulguer des informations sensibles, exécuter du code ou rediriger les utilisateurs vers des sites de phishing - sans le consentement explicite de l'utilisateur.

Comment les attaques exploitent les agents IA

Dans les scénarios d'injection de prompt caché, les attaquants dissimulent des commandes malveillantes dans le texte d'une page web, ses métadonnées ou même des éléments invisibles. Une fois qu'une IA ingère ces données, les commandes peuvent remplacer l'intention de l'utilisateur et amener l'agent à effectuer des actions non désirées. Les tests montrent que les navigateurs IA non protégés peuvent tomber victimes de telles astuces près d'une fois sur quatre lors d'expérimentations contrôlées.

Perplexity, OpenAI et Anthropic : risques clés identifiés

- Le navigateur Comet de Perplexity : Des audits effectués par Brave et Guardio ont révélé que l'outil pouvait être manipulé via des publications Reddit ou des sites de phishing pour exécuter des scripts ou extraire des données utilisateur.

- Agents de navigation d'OpenAI : Intégrés aux fonctionnalités agentiques de ChatGPT, ils ont montré un risque d'accès aux comptes connectés via des e-mails malveillants et des invites basées sur des sites web.

- Extension de navigateur Claude d'Anthropic : Les tests de red team ont révélé que des commandes de page web cachées pouvaient déclencher des clics automatiques sur des liens nuisibles.

Incidents documentés et avertissements de l'industrie

Des chercheurs et des entreprises de cybersécurité, y compris Brave, Guardio et Malwarebytes, ont publié des résultats montrant que même un contenu en ligne simple peut compromettre les agents d'IA. Dans un test, un post Reddit a forcé un navigateur AI à exécuter des scripts de phishing. Des rapports de plusieurs grandes publications technologiques ont mis en garde contre le fait que ces problèmes pourraient conduire à un accès non autorisé aux données ou même à un vol financier.

Les dangers de l'intégration de compte

Les analystes en sécurité ont tiré la sonnette d'alarme concernant les agents IA liés aux mots de passe ou aux API. Permettre de telles intégrations peut exposer les comptes email, les disques cloud et les plateformes de paiement. Techcrunch et Cybersecurity Dive ont tous deux rapporté des cas où des agents IA ont été trompés pour révéler ou manipuler des informations sensibles par le biais de commandes injectées.

Mesures de sécurité recommandées et perspectives

Les experts exhortent les utilisateurs à limiter les autorisations, à éviter de donner aux agents IA un accès au niveau du mot de passe et à surveiller les journaux d'IA pour détecter des anomalies. Les développeurs sont également conseillés d'implémenter des systèmes d'isolement et des filtres de prompt. Certains chercheurs recommandent même d'utiliser des navigateurs traditionnels pour des actions sensibles jusqu'à ce que les outils IA reçoivent des protections plus strictes.

Alors qu'OpenAI, Anthropic et Perplexity ont probablement entendu parler des défis, les professionnels de la cybersécurité avertissent que la navigation alimentée par l'IA reste un domaine à haut risque en 2025. Alors que ces entreprises s'enfoncent davantage dans l'interaction web autonome, les observateurs de l'industrie affirment que la transparence et des normes de sécurité plus strictes sont essentielles avant que de tels outils ne deviennent courants.

FAQ 🧭

- Qu'est-ce que les injections de prompt cachées dans les navigateurs AI ? Ce sont des commandes cachées intégrées dans le contenu web qui trompent les agents AI pour exécuter des actions nuisibles sans le consentement de l'utilisateur.

- Quelles entreprises ont vu leurs outils d'IA affectés par ces vulnérabilités ? Les agents de navigation Comet de Perplexity, ChatGPT d'OpenAI et les fonctionnalités de navigateur Claude d'Anthropic ont tous été cités dans des rapports récents.

- Quels risques découlent de la liaison des agents d'IA aux comptes personnels ? Connecter des outils d'IA à des disques, des e-mails ou des API peut permettre le vol de données, le phishing et l'accès non autorisé aux comptes.

- **Comment les utilisateurs peuvent-ils se protéger des attaques de navigateurs IA ?**Limiter les autorisations, éviter les intégrations de mots de passe, utiliser des modes en bac à sable et rester informé des avis de sécurité.