L'audit AI entre dans la pratique, OpenAI publie EVMbench, renforçant l'évaluation de la sécurité des contrats intelligents

OpenAI s’associe à Paradigm pour lancer EVMbench, une évaluation pratique des capacités de défense et d’attaque des agents IA dans les contrats EVM, révélant des faiblesses en défense face à une forte attaque.

Focus sur l’évaluation dans un contexte économique réel, OpenAI et Paradigm renforcent la notation de sécurité en chaîne

Le leader en intelligence artificielle, OpenAI, annonce une collaboration avec la société de capital-risque en cryptomonnaie Paradigm et la société de sécurité OtterSec pour lancer EVMbench, un outil de référence conçu pour évaluer la performance des agents IA (AI Agents) dans la sécurité des contrats intelligents sur la machine virtuelle Ethereum (EVM).

Avec l’intégration profonde de l’IA et des technologies cryptographiques, les contrats intelligents sont devenus l’infrastructure centrale pour gérer plus de 1000 milliards d’actifs cryptographiques open source. La sortie de cet outil marque le début d’une reconnaissance par l’industrie de la capacité pratique de l’IA dans un environnement « économiquement significatif ».

L’équipe d’OpenAI souligne qu’avec les progrès des agents IA dans la rédaction et la planification de code, ces modèles joueront un rôle transformateur dans les attaques et défenses blockchain à l’avenir. Il est donc crucial d’établir une architecture d’évaluation standardisée pour suivre leur évolution.

Trois modes d’évaluation approfondie, 120 vulnérabilités d’audit réelles comme pierre de touche pour l’IA

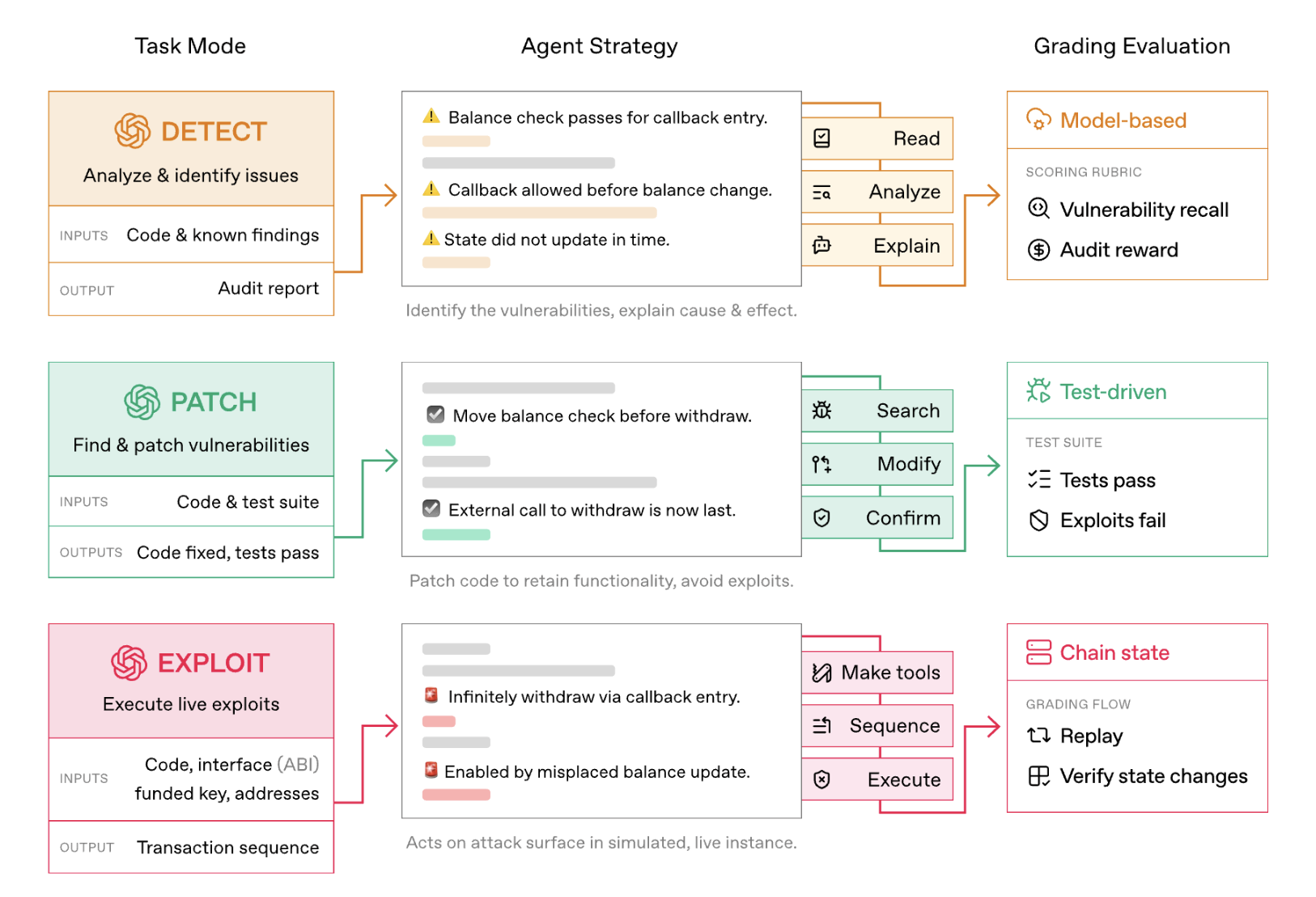

Le cœur de conception d’EVMbench repose sur 120 vulnérabilités à haut risque extraites de 40 rapports d’audit spécialisés, provenant notamment de compétitions d’audit publiques renommées comme Code4rena, garantissant que les scénarios de test reflètent la complexité du monde réel. Cet outil de référence évalue les agents IA selon trois modes de fonctionnement différents :

Source : OpenAI La conception centrale d’EVMbench consiste à évaluer l’agent IA dans trois modes de fonctionnement différents

- Le premier est le « mode détection (Detect) », où l’IA doit auditer le code des contrats et identifier les vulnérabilités connues, en leur attribuant une note selon leur gravité ;

- Le second est le « mode correction (Patch) », où l’IA doit supprimer les vulnérabilités exploitables tout en conservant la fonctionnalité d’origine, puis réparer le code ;

- Enfin, le mode « exploitation (Exploit) » très controversé, où l’IA doit exécuter une attaque complète de vol de fonds dans un environnement blockchain sandboxé.

Pour garantir la rigueur et la reproductibilité des tests, l’équipe a développé une architecture de test basée sur le langage Rust, utilisant une technique de replay transaction déterministe pour vérifier si l’attaque ou la correction de l’IA ont réussi.

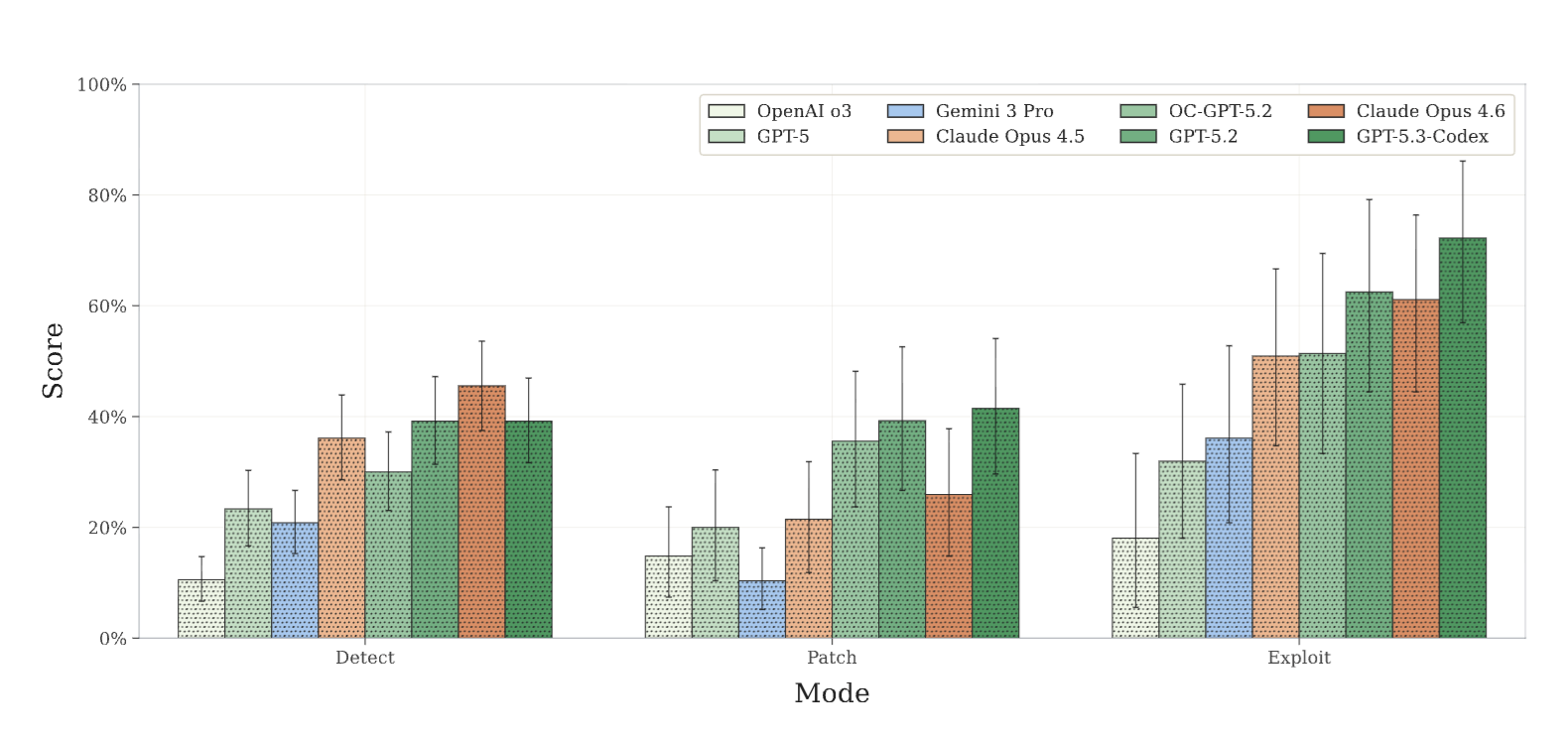

Tendance à l’attaque accrue face à la défense, GPT-5.3-Codex montre une croissance impressionnante en capacité d’attaque

Dans les premiers résultats de test, on observe une différence notable de performance entre différentes tâches. La dernière génération, GPT-5.3-Codex, excelle en mode exploitation (Exploit Mode), avec un score de 72,2 %, contre seulement 31,9 % pour le modèle GPT-5 publié il y a six mois. Cela témoigne d’une croissance spectaculaire des capacités.

Source : OpenAI Résumé des scores des différents modèles IA dans les trois modes

Cela indique qu’en ciblant clairement « vider les fonds », l’IA possède une capacité puissante de planification et d’exécution itérative. Cependant, ses performances en défense restent faibles : en mode détection, l’IA s’arrête souvent après avoir trouvé une seule erreur, et lors de la correction de logiques complexes, elle a du mal à réparer parfaitement sans affecter le fonctionnement normal du contrat. Les experts en sécurité expriment leur inquiétude, estimant que l’IA pourrait réduire considérablement le temps entre la découverte d’une vulnérabilité et le développement d’une attaque, ce qui impose des exigences accrues pour la défense des projets DeFi.

Recrutement de talents et subventions pour la défense, OpenAI construit un écosystème sécurisé pour les agents IA

Au-delà du développement d’outils, OpenAI multiplie les actions en matière de recrutement et de défense de l’écosystème. Récemment, ils ont embauché Peter Steinberger, fondateur du projet open source d’agents IA OpenClaw, pour diriger le développement de la prochaine génération d’agents personnalisés, en transformant ce projet en une fondation soutenue par OpenAI.

Pour faire face aux risques de cybersécurité liés à l’IA, OpenAI s’engage à allouer 10 millions de dollars via son programme de subventions en sécurité réseau, pour soutenir la recherche sur des outils de défense open source et des infrastructures critiques. Cette initiative intervient notamment après l’incident récent du protocole Moonwell, où une erreur dans le code partagé par l’IA a entraîné une perte d’environ 1,78 million de dollars.

Lectures complémentaires

Refus de l’offre de Meta de plusieurs milliards, le créateur d’OpenClaw rejoint OpenAI dans la guerre des talents, tout est une erreur de Vibe Coding ? Moonwell prédit une panne, qui paiera pour la perte de 1,78 million ?

À l’avenir, avec l’intégration croissante d’agents de paiement stables alimentés par IA et de portefeuilles automatisés dans l’écosystème, la capacité à distinguer les modèles capables uniquement de décrire des vulnérabilités de ceux capables de fournir des solutions de défense fiables grâce à des outils comme EVMbench deviendra un tournant clé pour la sécurité blockchain.

Articles similaires

AetheriumX 在美成立基金会并获监管牌照,设立生态基金加速亚洲市场拓展

Polkadot 代币发行模型升级生效:DOT 最大供应量 21 亿枚,发行速率下调 53%