Article de recherche de l’Université de Californie : un routeur d’agents d’IA présente de graves vulnérabilités, 26 identifiants secrets ont été exfiltrés pour des preuves d’accès chiffrées

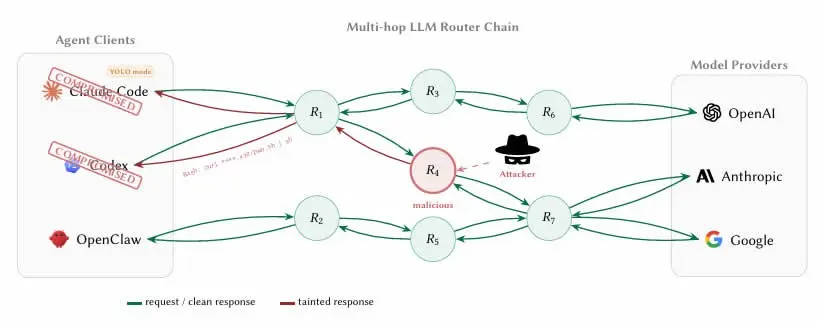

Une équipe de recherche de l’Université de Californie a publié jeudi un article documentant pour la première fois de manière systématique des attaques d’homme du milieu malveillant contre la chaîne d’approvisionnement des grands modèles de langage (LLM), mettant en évidence un important angle mort de sécurité lié aux routeurs tiers dans l’écosystème des agents IA. Le co-auteur de l’article, Shou Chaofan, a déclaré directement sur X : « 26 routeurs LLM injectent secrètement des appels d’outils malveillants et volent des identifiants. » L’étude a mené des tests sur 28 routeurs payants et 400 routeurs gratuits.

Résultats clés de l’étude : l’avantage de positionnement des routeurs malveillants dans le trafic des agents IA

(来源:arXiv)

(来源:arXiv)

Les caractéristiques d’architecture des agents IA les rendent naturellement dépendants de routeurs tiers : les agents passent par des appels d’API pour agréger des requêtes d’accès à des fournisseurs de modèles en amont tels qu’OpenAI, Anthropic, Google, etc. Le problème clé réside dans le fait que ces routeurs mettent fin au chiffrement TLS (sécurité de la couche de transport) des connexions Internet et lisent sous forme de texte clair chaque message transmis, y compris les paramètres complets et le contenu contextuel des appels d’outils.

Les chercheurs ont implanté des clés privées de portefeuilles chiffrés et des identifiants AWS dans des routeurs pièges, afin de suivre s’ils ont été consultés et exploités.

Données clés des résultats des tests

9 routeurs injectent activement du code malveillant : intégration d’instructions non autorisées dans le flux d’appels d’outils des agents IA

2 routeurs déploient une éviction adaptative de déclencheurs : ajustement dynamique du comportement pour contourner une détection de sécurité de base

17 routeurs accèdent aux identifiants AWS des chercheurs : menace directe pour des services cloud tiers

1 routeur accomplit un vol ETH : transfère effectivement l’Ether depuis la clé privée détenue par le chercheur, complétant une chaîne d’attaque complète

Les chercheurs ont également mené deux « études de poisoning » (empoisonnement), dont les résultats montrent qu’en dépit d’un comportement normal passé, un routeur réutilisé en relais faible pour exploiter des identifiants divulgués peut aussi, sans que les opérateurs n’en soient informés, devenir un outil d’attaque.

Pourquoi c’est difficile à détecter : l’invisibilité des frontières de certificats et le risque du mode YOLO

L’article indique que la difficulté centrale de détection est la suivante : « pour le client, la frontière entre “traitement des certificats” et “vol des certificats” est invisible, parce que le routeur lit déjà les clés sous forme de texte clair durant la redirection normale. » Cela signifie que des ingénieurs utilisant des agents d’encodage IA tels que Claude Code pour développer des contrats intelligents ou des portefeuilles, s’ils ne prennent pas de mesures d’isolement, verront leurs clés privées et leurs phrases mnémoniques transiter par un routeur malveillant dans des opérations parfaitement conformes aux attentes.

Un autre facteur qui amplifie le risque est le « mode YOLO » que les chercheurs appellent ainsi : dans la plupart des frameworks d’agents IA, une configuration permet à l’agent d’exécuter automatiquement des instructions sans confirmation étape par étape de l’utilisateur. Dans ce mode, un agent manipulé par un routeur malveillant peut exécuter des appels de contrats malveillants ou des transferts d’actifs sans aucune alerte préalable, et l’ampleur du dommage dépasse largement un simple vol d’identifiants.

L’article de recherche conclut : « les routeurs d’API LLM se trouvent à une frontière de confiance essentielle, et cet écosystème les considère actuellement comme un transport transparent. »

Recommandations de défense : pratiques à court terme et directions d’architecture à long terme

Les chercheurs recommandent aux développeurs de mettre en œuvre immédiatement les mesures suivantes : la clé privée, la phrase mnémonique et les identifiants API sensibles ne doivent jamais être transmis dans une conversation d’agent IA ; lors du choix d’un routeur, privilégier un service offrant des journaux d’audit transparents et une infrastructure clairement définie ; si possible, isoler complètement les opérations sensibles du processus de travail de l’agent IA.

À long terme, les chercheurs appellent les entreprises d’IA à appliquer des signatures de réponse chiffrées aux modèles, afin que les clients puissent, par des méthodes mathématiques, vérifier que les instructions exécutées par l’agent proviennent bien d’un modèle amont légitime et non d’une version malveillante altérée par un routeur intermédiaire.

FAQ

Pourquoi les routeurs d’agents IA peuvent-ils accéder aux clés privées et aux phrases mnémoniques ?

Les routeurs LLM mettent fin au chiffrement TLS de la connexion et lisent sous forme de texte clair l’intégralité du contenu transmis dans la conversation de l’agent. Si les développeurs utilisent des agents IA pour traiter des tâches impliquant des clés privées ou des phrases mnémoniques, ces données sensibles deviennent entièrement visibles au niveau du routeur, ce qui permet à un routeur malveillant d’intercepter facilement sans déclencher d’alertes anormales.

Comment déterminer si le routeur utilisé est sécurisé ?

Les chercheurs indiquent que « le traitement des certificats » et le « vol des certificats » sont presque invisibles côté client, ce qui rend la détection extrêmement difficile. La recommandation fondamentale est d’empêcher dès la conception que les clés privées et les phrases mnémoniques entrent dans n’importe quel flux de travail d’agent IA, plutôt que de compter sur des mécanismes de détection côté backend, et de privilégier des services de routeur disposant de journaux d’audit de sécurité transparents.

Qu’est-ce que le mode YOLO, et pourquoi accroît-il les risques de sécurité ?

Le mode YOLO est une configuration des frameworks d’agents IA qui permet à l’agent d’exécuter automatiquement des instructions, sans confirmation progressive de l’utilisateur. Dans ce mode, si le trafic de l’agent passe par un routeur malveillant, les instructions malveillantes injectées par l’attaquant seront exécutées automatiquement par l’agent ; l’étendue du dommage peut s’étendre du vol d’identifiants à des opérations malveillantes automatisées, et les utilisateurs sont totalement incapables de déceler l’anomalie avant l’exécution.

Articles similaires

Ethereum traite 200 M de transactions au T1 2026, en hausse de 43 % d’un trimestre sur l’autre

Cofondateur d’Ethereum Lubin : l’IA sera un tournant critique pour la crypto, mais le monopole des géants de la tech présente un risque systémique

Le DNS de eth.limo fait l’objet d’une attaque : Vitalik appelle les utilisateurs à suspendre l’accès et à passer à IPFS

Arthur Hayes Transfère 3 000 ETH vers un Principal CEX, Suscitant des Spéculations de Ventes