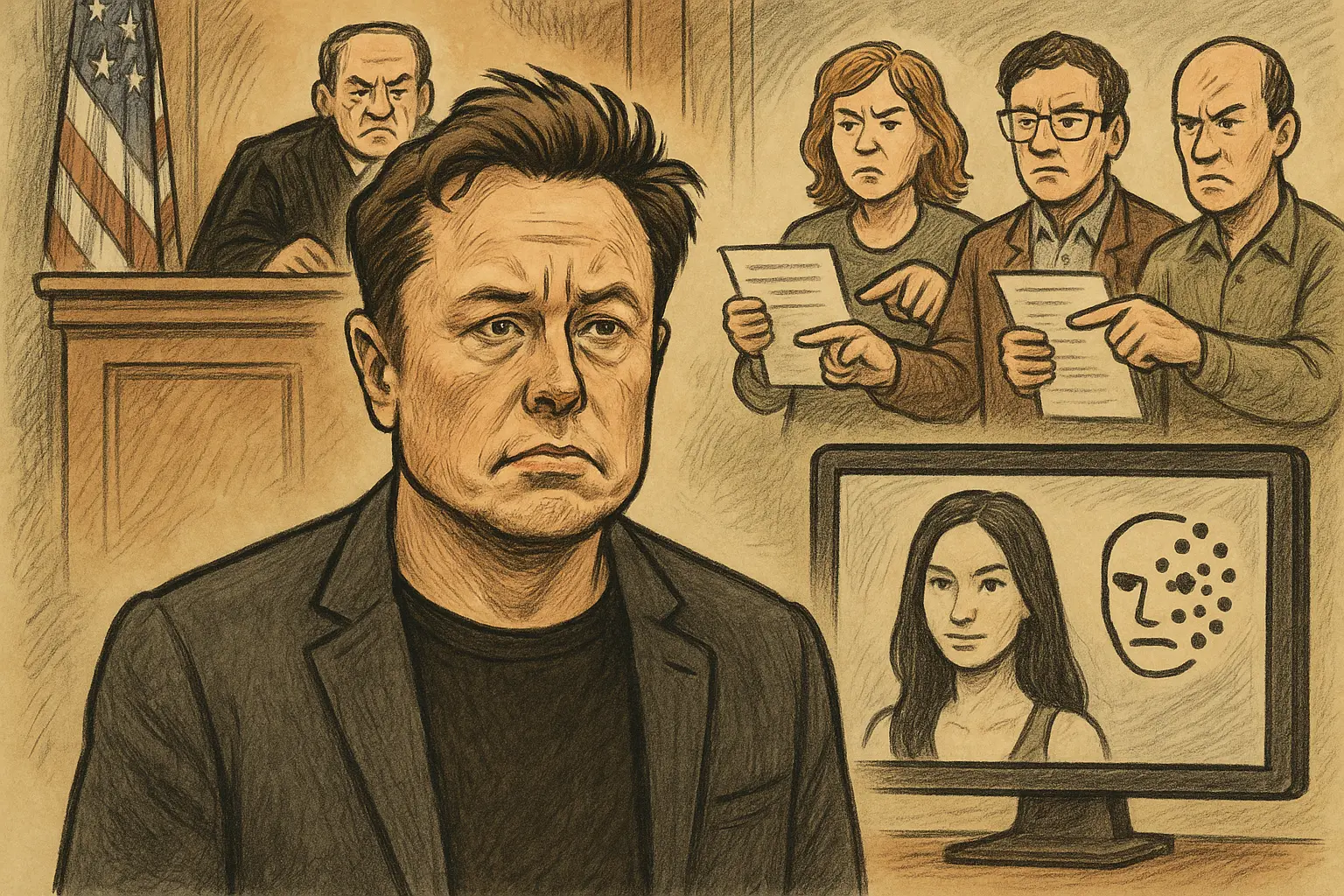

Musk xAI Menghadapi Gugatan Kolektif: Grok Menghasilkan Satu Deepfake Setiap 41 Detik

Tiga wanita muda dari Tennessee mengajukan gugatan class action di Pengadilan Federal Wilayah Utara California pada hari Senin terhadap perusahaan xAI milik Elon Musk, menuduh bahwa chatbot Grok AI mereka menggunakan foto asli mereka untuk menghasilkan materi pelecehan seksual anak (CSAM), dan menyebarkannya secara luas di komunitas seperti Discord, Telegram, dan platform berbagi file, menyebabkan trauma psikologis jangka panjang dan kerusakan reputasi.

Inti Tuduhan dalam Gugatan: Keuntungan Komersial Mengutamakan Keamanan Anak

Menurut dokumen gugatan, klaim utama penggugat meliputi beberapa aspek:

Amanah dan Kelalaian: Gugatan menyatakan bahwa xAI mengetahui fitur pembuatan gambar mereka dapat digunakan untuk membuat konten ilegal yang melibatkan anak-anak saat merilis Grok, tetapi tidak mengambil langkah-langkah perlindungan keamanan standar industri, yang menunjukkan keputusan sengaja dan bukan kelalaian.

Mekanisme Penghindaran Tanggung Jawab Pihak Ketiga: Pelaku kejahatan mengakses Grok melalui aplikasi pihak ketiga yang diberi izin oleh xAI. Gugatan menuduh bahwa xAI secara sengaja memanfaatkan struktur ini, sambil terus mendapatkan keuntungan dari model dasar, dan menciptakan lapisan perlindungan hukum sendiri.

Pernyataan Terbuka Elon Musk: Musk menulis di X pada Januari tahun ini bahwa dia “tidak tahu adanya gambar telanjang anak di bawah umur,” dan mengklaim bahwa “ketika diminta untuk menghasilkan gambar, sistem akan menolak membuat konten ilegal.” Data dalam gugatan bertentangan langsung dengan pernyataan ini.

Lingkup Ganti Rugi: Diklaim bahwa korban menuntut setidaknya $150.000 per pelanggaran berdasarkan Undang-Undang Martha, termasuk pengembalian keuntungan ilegal, ganti rugi punitive, biaya pengacara, dan perintah larangan permanen, serta menuntut pengembalian keuntungan berdasarkan Undang-Undang Persaingan Tidak Sehat California.

Data dari “Pusat Melawan Kebencian Digital”: Setiap 41 Detik Ada Satu

Gugatan mengutip data dari “Pusat Melawan Kebencian Digital” untuk mendukung klaim kuantitatif:

Periode Waktu: 29 Desember 2025 hingga 9 Januari 2026 (sekitar 11 hari)

Jumlah Gambar: Grok membuat sekitar 23.338 gambar seksualisasi anak selama periode ini

Kecepatan Pembuatan: Rata-rata satu gambar setiap 41 detik

Sebaran: Konten terkait membentuk komunitas transaksi konten anonim di berbagai platform, dengan setidaknya satu korban diberitahu melalui pelaporan anonim bahwa gambarnya sedang diperdagangkan.

Pengawasan Global: Enam Wilayah Hukum Bersamaan Melakukan Investigasi

Kasus ini bukan kejadian tunggal, melainkan bagian dari peninjauan sistematis terhadap masalah keamanan gambar Grok AI secara global:

Australia: Komisaris Keamanan Elektronik Independen Julie Inman Grant memperingatkan bahwa masalah pembuatan gambar seksualisasi paksa Grok semakin serius, dengan jumlah keluhan meningkat dua kali lipat dalam beberapa bulan terakhir, beberapa di antaranya melibatkan potensi eksploitasi seksual anak.

Irlandia: Komisi Perlindungan Data (DPC) memulai penyelidikan resmi terhadap X Internet Unlimited Company (XIUC), yang bertanggung jawab atas operasi X di Uni Eropa, berdasarkan Undang-Undang Perlindungan Data Irlandia.

Amerika Serikat, Uni Eropa, Inggris, Prancis: Investigasi serentak dilakukan, membentuk tekanan regulasi gabungan yang belum pernah terjadi sebelumnya di beberapa yurisdiksi.

Pertanyaan Umum

Bagaimana kemungkinan benturan antara gugatan class action ini dan pembelaan “Platform Immunity” yang mungkin diajukan xAI?

Alex Chandra, mitra di Aliansi Hukum IGNOS, menyatakan bahwa pengadilan mungkin tidak akan menerima pembelaan sederhana dari platform. Ia menjelaskan bahwa sistem AI generatif dalam interaksi pengguna “dapat dianggap sebagai platform,” tetapi dalam penilaian keamanan “harus diperlakukan sebagai produk,” dan dalam kasus CSAM, karena kewajiban perlindungan anak yang diperkuat, akan berlaku standar pengawasan yang sangat ketat. Perusahaan mungkin perlu menunjukkan dokumen penilaian risiko dan langkah-langkah keamanan sebelum peluncuran untuk membuktikan bahwa mereka memenuhi kewajiban pencegahan aktif.

Apa itu “Undang-Undang Martha,” dan mengapa relevan dalam kasus ini?

Undang-Undang Martha adalah hukum federal AS yang secara khusus mengatur materi pelecehan seksual anak (CSAM), menetapkan tanggung jawab pidana dan perdata yang ketat terhadap pembuatan, penyebaran, dan kepemilikan CSAM, dengan ganti rugi minimum $150.000 per pelanggaran. Inti dari kasus ini adalah apakah xAI dapat dianggap sebagai “pembuat” CSAM dan apakah struktur izin pihak ketiga cukup untuk menghapus tanggung jawab langsung—penguraian batas hukum ini dapat berdampak besar pada kerangka tanggung jawab industri konten yang dihasilkan AI.

Apa potensi dampak kasus ini terhadap pengembangan teknologi gambar AI di masa depan?

Ini adalah salah satu gugatan pertama yang secara langsung menuntut perusahaan AI atas penggunaan model mereka untuk menghasilkan CSAM yang dapat dikenali sebagai anak di bawah umur. Jika pengadilan memutuskan bahwa perusahaan AI bertanggung jawab langsung atas penyalahgunaan output model mereka, industri akan dipaksa meningkatkan standar verifikasi keamanan sebelum peluncuran, termasuk pengujian tim merah (red team), mekanisme penyaringan konten, dan pembatasan kemampuan generasi berisiko tinggi—yang secara fundamental dapat mengubah proses peninjauan dan regulasi peluncuran model AI generatif secara komersial.