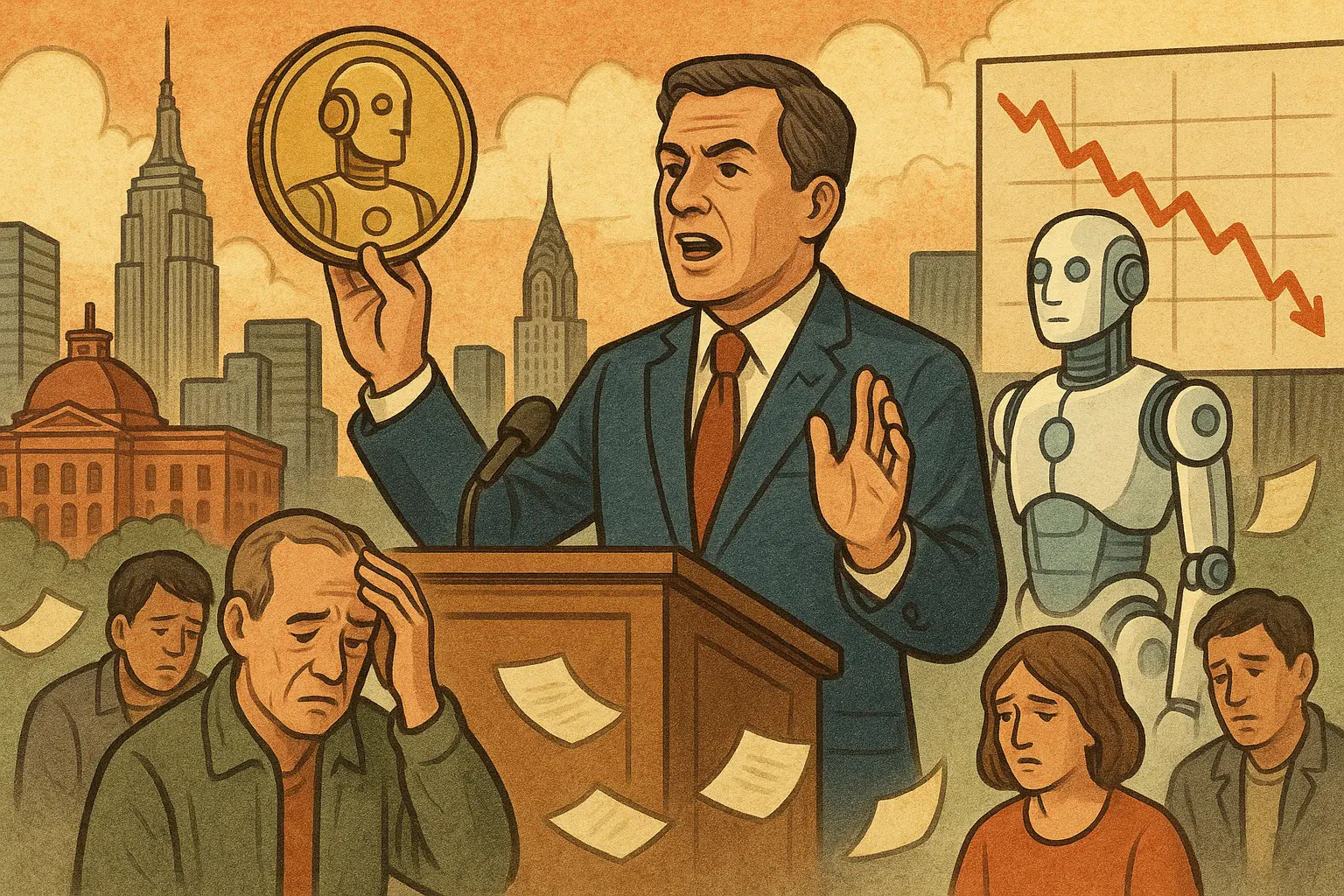

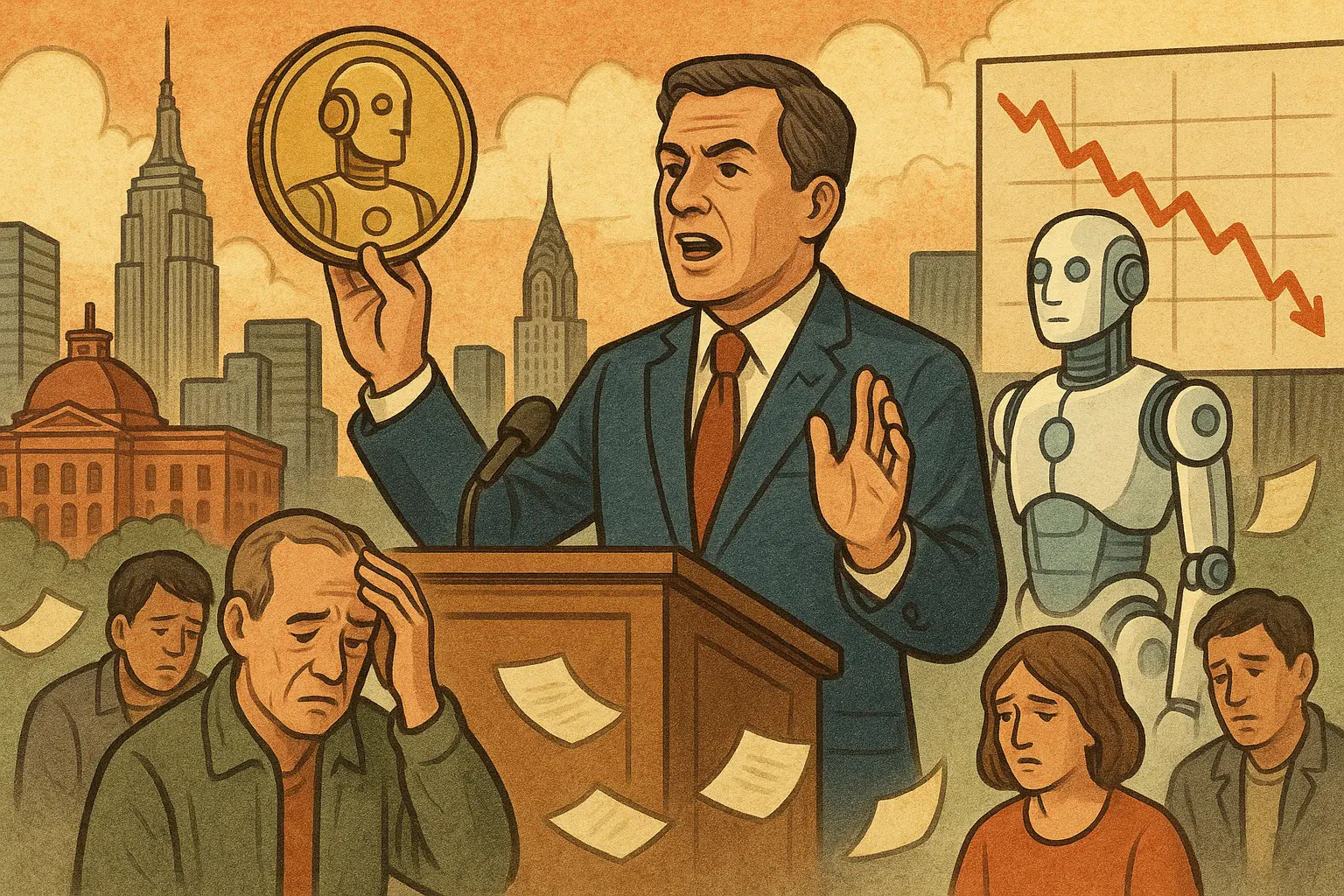

Alex Bores, legislador estadual de Nova York e candidato ao Congresso, anunciou no domingo um plano de “bônus de IA”, com o objetivo de pagar diretamente aos cidadãos americanos quando a inteligência artificial substituir de forma significativa os trabalhadores dos EUA. O plano surge no contexto de um relatório do Goldman Sachs que mostra que a adoção de IA já levou à perda de cerca de 16 mil vagas por mês nos EUA; gigantes de tecnologia como Amazon, Meta, Intel e Microsoft anunciaram grandes rodadas de demissões em sequência.

Mecanismo de desenho do plano de bônus de IA: condições de acionamento e destinação dos recursos

(Fonte: Alex Bores)

O plano de bônus de IA não é uma renda básica universal (UBI) com pagamentos fixos, mas sim um sistema com condições de acionamento — só é ativado quando a IA “substituir de forma significativa os trabalhadores dos EUA”. Além de pagamentos diretos de dividendos aos cidadãos americanos, os recursos também serão usados em três direções: investir em “transição da força de trabalho, capacitação e educação”; criar infraestrutura básica de supervisão e segurança de IA; e incentivar empregadores a escolher contratar humanos em vez de IA.

Os mecanismos de arrecadação incluem: taxação do uso de IA, participação acionária em empresas de IA líderes e reforma do tratamento tributário de força de trabalho e capital. Bores, atualmente, está colocando essa política como uma de suas principais bandeiras na campanha ao Congresso; se ela poderá ser implementada depende de seu sucesso eleitoral.

Divergências entre duas instituições: o impacto do desemprego por IA é realmente o quão grave?

O relatório do Goldman Sachs mostra que a popularização da IA já levou à perda de cerca de 16 mil vagas por mês nos EUA, e as grandes rodadas de demissões na Amazon, Meta, Intel e Microsoft são consideradas diretamente relacionadas à substituição por eficiência de IA.

No entanto, um relatório divulgado em 14 de abril pelo Morgan Stanley traz uma avaliação mais cautelosa: até o momento, o impacto da IA no mercado de trabalho “ainda é relativamente moderado”, e não há evidências suficientes para indicar a existência generalizada de desemprego em larga escala. O Morgan Stanley cita regularidades históricas de que ondas de novas tecnologias, a longo prazo, normalmente também impulsionam o crescimento do emprego — mas ao mesmo tempo admite que a inteligência artificial pode quebrar essa regra histórica.

Contexto de políticas: resposta política diante da onda de demissões de gigantes da tecnologia

A proposta do plano de bônus de IA reflete a crescente atenção do cenário político americano ao impacto da IA sobre o mercado de empregos. A forma de distribuir os ganhos de produtividade gerados pela IA está se tornando tema de campanha de cada vez mais políticos. Do conceito à implementação, o plano ainda enfrenta vários desafios-chave, como critérios quantitativos das condições de acionamento, legalidade da taxação do uso de IA, mecanismos de execução para manter participação acionária em empresas de IA e como evitar impactos negativos sobre a inovação em IA.

Perguntas frequentes

Quais são as condições de acionamento do plano de bônus de IA e isso equivale a uma renda básica universal?

O bônus de IA não é renda básica universal (UBI); sua diferença central está na definição das condições de acionamento — só é ativado quando a IA “substituir de forma significativa os trabalhadores dos EUA”. O plano é definido como um “mecanismo de seguro”, e não como uma renda básica fixa. Os critérios quantitativos específicos para o acionamento (como um limite da taxa de desemprego) ainda não foram detalhados em comunicados públicos.

Por que as avaliações do Goldman Sachs e do Morgan Stanley sobre o impacto do desemprego por IA são diferentes?

O Goldman Sachs enfatiza os efeitos de substituição já ocorridos (16 mil fluxos de trabalho perdidos por mês), enquanto o Morgan Stanley avalia a situação sob uma perspectiva histórica mais longa, entendendo que o impacto “é moderado até agora”, e cita precedentes históricos de que, após substituição tecnológica, normalmente ocorre crescimento do emprego. Ainda assim, também reconhece que a natureza destrutiva da IA pode ser diferente das revoluções tecnológicas anteriores.

O plano é viável do ponto de vista legislativo?

Por enquanto, o plano ainda está na fase de proposta de campanha; a premissa para sua implementação é que Bores seja eleito como deputado ao Congresso e obtenha apoio político suficiente no Congresso. A taxação do uso de IA e o mecanismo de participação acionária obrigatória envolvidos no plano podem enfrentar forte resistência da indústria de tecnologia e do mercado de capitais.

Aviso: As informações nesta página podem ser provenientes de terceiros e não representam as opiniões ou pontos de vista da Gate. O conteúdo exibido nesta página é apenas para referência e não constitui aconselhamento financeiro, de investimento ou jurídico. A Gate não garante a exatidão ou integridade das informações e não será responsável por quaisquer perdas decorrentes do uso dessas informações. Os investimentos em ativos virtuais apresentam altos riscos e estão sujeitos a uma volatilidade de preços significativa. Você pode perder todo o capital investido. Por favor, compreenda completamente os riscos envolvidos e tome decisões prudentes com base em sua própria situação financeira e tolerância ao risco. Para mais detalhes, consulte o

Aviso Legal.

Related Articles

IEA: Os gastos com infraestrutura de IA já ultrapassaram os investimentos na produção de petróleo e gás; em 2026, espera-se que aumentem mais 75%

De acordo com a análise e os dados de mercado divulgados pela Agência Internacional de Energia (IEA) em 26 de abril, o investimento total em despesas de capital das cinco maiores empresas de tecnologia em 2025 ultrapassou US$ 400 bilhões, com foco principalmente na construção de infraestrutura de IA; o tamanho já superou o volume anual de investimentos globais em produção de petróleo e gás natural. A IEA estima que, em 2026, as despesas de capital relacionadas poderão crescer ainda mais 75%.

MarketWhisper21m atrás

O senador Bernie Sanders emite um alerta sobre a ameaça existencial da IA

Sanders enfatizou que, mesmo que a maioria dos cientistas de IA reconheça a possibilidade de a IA escapar do controle e se tornar um perigo para a nossa existência, nenhuma medida importante foi tomada para evitá-la. “Devemos garantir que a IA beneficie a humanidade, e não nos prejudique”, afirmou.

Principais conclusões:

Bernie Sanders

Coinpedia30m atrás

Responsável pelo grande modelo de IA da Xiaomi: a competição em IA está mudando para a era dos Agentes; a autoevolução é o evento-chave para a AGI

A responsável pela equipe do grande modelo da Xiaomi, Luo Fuli, concedeu uma entrevista em profundidade (número do vídeo: BV1iVoVBgERD) na plataforma Bilibili em 24 de abril, com duração de 3,5 horas. Esta foi sua primeira vez, em sua função como responsável técnico, a expor de forma sistemática suas perspectivas técnicas em público. Luo Fuli afirmou que a corrida pela competição de grandes modelos passou da era do Chat para a era dos Agentes e apontou que “autoevolução” será o principal evento para a AGI no próximo ano.

MarketWhisper31m atrás

A voz do Grok da xAI assume a linha de atendimento ao cliente da Starlink, 70% das ligações são encerradas automaticamente

De acordo com o anúncio oficial da xAI em 23 de abril, a xAI lançou o agente de IA de voz Grok Voice Think Fast 1.0 e já foi implantado na linha de atendimento ao cliente do Starlink +1 (888) GO STARLINK. De acordo com os dados de testes divulgados no anúncio, 70% das ligações são encerradas automaticamente por IA, sem necessidade de intervenção de um humano.

MarketWhisper42m atrás

GPT-5.5 Volta ao Topo em Codificação, mas a OpenAI Troca os Benchmarks Depois de Perder para o Opus 4.7

Mensagem do Gate News, 27 de abril — A SemiAnalysis, uma empresa de análise de semicondutores e IA, divulgou um benchmark comparativo de assistentes de codificação, incluindo GPT-5.5, Claude Opus 4.7 e DeepSeek V4. A principal descoberta: GPT-5.5 marca o primeiro retorno da OpenAI ao limite do que há de mais avançado em modelos de codificação em seis meses, com engenheiros da SemiAnalysis agora alternando entre Codex e Claude Code depois de anteriormente dependerem quase exclusivamente de Claude. O GPT-5.5 é baseado em uma nova abordagem de pré-treinamento codificada como "Spud" e representa a primeira expansão do OpenAI na escala de pré-treinamento desde o GPT-4.5.

Em testes práticos, surgiu uma divisão clara de funções. Claude fica com o planejamento de projetos novos e a configuração inicial, enquanto Codex se destaca em correções de bugs que exigem raciocínio intensivo. O Codex demonstra uma compreensão mais forte de estruturas de dados e raciocínio lógico, mas tem dificuldades para inferir a intenção ambígua do usuário. Em uma tarefa única no painel, o Claude replicou automaticamente o layout da página de referência, mas fabricou grandes quantidades de dados, enquanto o Codex pulou o layout, mas entregou dados significativamente mais precisos.

A análise revela um detalhe de manipulação de benchmark: o post do blog da OpenAI de fevereiro incentivou a indústria a adotar o SWE-bench Pro como o novo padrão para benchmarks de codificação. No entanto, o anúncio do GPT-5.5 mudou para um novo benchmark chamado "Expert-SWE." O motivo, escondido nas letras miúdas, é que o GPT-5.5 foi superado pelo Opus 4.7 no SWE-bench Pro e ficou muito aquém do não lançado Mythos da Anthropic 77.8%.

Em relação ao Opus 4.7, a Anthropic publicou uma análise pós-mortem uma semana após o lançamento, reconhecendo três bugs no Claude Code que persistiram por várias semanas de março a abril, afetando quase todos os usuários. Vários engenheiros já haviam relatado degradação de desempenho na versão 4.6, mas foram dispensados como observações subjetivas. Além disso, o novo tokenizador do Opus 4.7 aumenta o uso de tokens em até 35%, algo que a Anthropic admitiu abertamente—o que, efetivamente, constitui um aumento de preço oculto.

O DeepSeek V4 foi avaliado como "acompanhando o ritmo da fronteira, mas não liderando," posicionando-se como a alternativa de menor custo entre modelos de código fechado. A análise também observou que "Claude continua a superar o DeepSeek V4 Pro em tarefas de escrita em chinês de alta dificuldade," comentando que "Claude venceu o modelo chinês na própria língua.

O artigo apresenta um conceito-chave: a precificação dos modelos deve ser avaliada por "custo por tarefa" em vez de "custo por token." A precificação do GPT-5.5 é o dobro da do GPT-5.4 input $5, output por um milhão de tokens, mas ele conclui as mesmas tarefas usando menos tokens, tornando o custo real não necessariamente mais alto. Os dados iniciais da SemiAnalysis mostram que a proporção input-to-output do Codex é de 80:1, menor do que a do Claude Code, de 100:1.

GateNews47m atrás

Executivo da Google DeepMind: Toda Empresa de Produtos de IA Deve Criar Benchmarks Personalizados

Mensagem do Gate News, 27 de abril — Logan Kilpatrick, gerente sênior de produto na Google DeepMind e líder de produto do Google AI Studio, declarou no X que toda empresa que desenvolve produtos baseados em IA deve criar seus próprios benchmarks personalizados para medir o desempenho dos modelos de IA. Ele descreveu isso como um método para

GateNews1h atrás