O DeepSeek V4-Pro é lançado com um custo 98% menor do que o do GPT-5.5 Pro

O DeepSeek lançou prévias das versões DeepSeek-V4-Pro e DeepSeek-V4-Flash em 24 de abril de 2026; ambos são modelos de código aberto com janelas de contexto de um milhão de tokens e preços significativamente abaixo das alternativas ocidentais comparáveis. O modelo V4-Pro custa US$ 1,74 por milhão de tokens de entrada e US$ 3,48 por milhão de tokens de saída—aproximadamente 1/20 do preço do Claude Opus 4.7 e 98% a menos do que o GPT-5.5 Pro, de acordo com as especificações oficiais da empresa.

Arquitetura do Modelo e Escala

O DeepSeek-V4-Pro tem 1,6 trilhão de parâmetros totais, tornando-o o maior modelo de código aberto no mercado de LLMs até hoje. No entanto, apenas 49 bilhões de parâmetros são ativados por passagem de inferência, usando o que a DeepSeek chama de abordagem de Mixture-of-Experts, refinada desde a V3. Este design permite que o modelo inteiro permaneça em estado dormente enquanto apenas fatias relevantes ativam para qualquer solicitação, reduzindo custos de computação enquanto mantém capacidade de conhecimento.

O DeepSeek-V4-Flash opera em uma escala menor, com 284 bilhões de parâmetros totais e 13 bilhões de parâmetros ativos. De acordo com os benchmarks da DeepSeek, ele “atinge desempenho de raciocínio comparável ao da versão Pro quando recebe um orçamento maior de pensamento”.

Ambos os modelos oferecem um milhão de tokens de contexto como recurso padrão—aproximadamente 750.000 palavras, ou aproximadamente toda a trilogia “O Senhor dos Anéis” mais texto adicional.

Inovação Técnica: Mecanismos de Atenção em Escala

A DeepSeek abordou o problema de escalabilidade computacional inerente ao processamento de contexto longo inventando dois novos tipos de atenção, conforme detalhado no artigo técnico da empresa disponível no GitHub.

Os mecanismos de atenção padrão de IA enfrentam um problema brutal de escalabilidade: toda vez que o comprimento do contexto dobra, o custo de computação aumenta aproximadamente quatro vezes. A solução da DeepSeek envolve duas abordagens complementares:

Atenção Esparsa Comprimida funciona em dois passos. Primeiro, ela comprime grupos de tokens—por exemplo, a cada 4 tokens—em uma única entrada. Em seguida, em vez de atender a todas as entradas comprimidas, ela usa um “Lightning Indexer” para selecionar apenas os resultados mais relevantes para qualquer consulta. Isso reduz o escopo de atenção do modelo de um milhão de tokens para um conjunto muito menor de chunks importantes.

Atenção Fortemente Comprimida adota uma abordagem mais agressiva, colapsando cada conjunto de 128 tokens em uma única entrada sem seleção esparsa. Embora perca detalhes de granularidade fina, ela fornece uma visão global extremamente barata. Os dois tipos de atenção rodam em camadas alternadas, permitindo que o modelo mantenha tanto detalhes quanto visão geral.

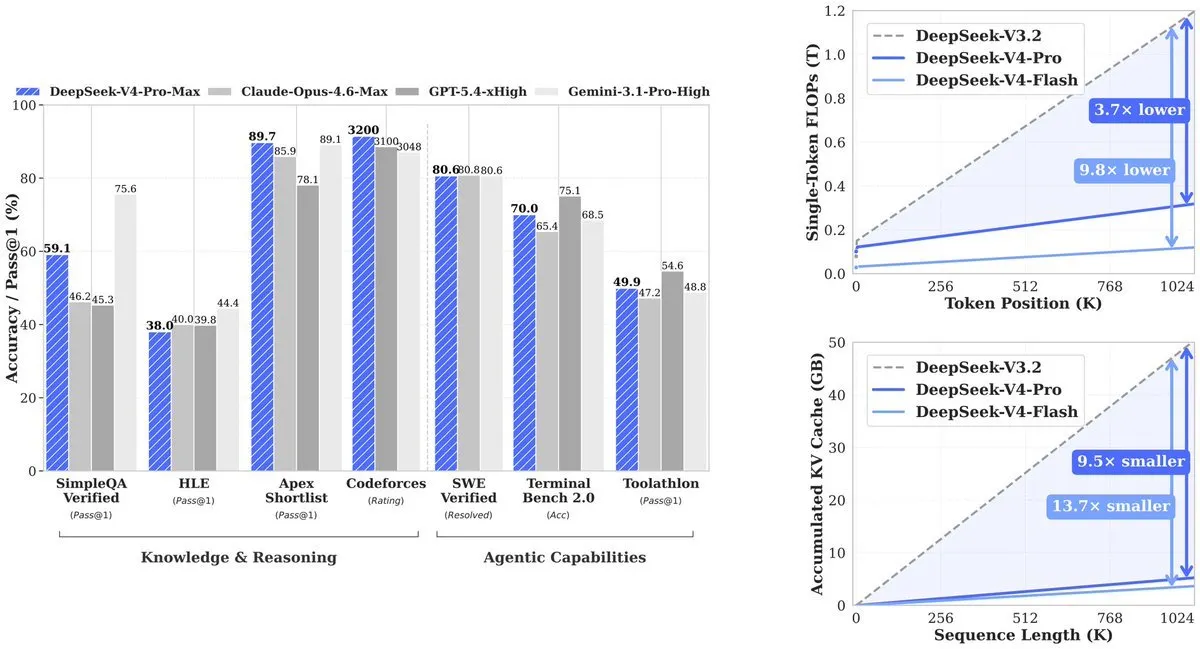

O resultado: o V4-Pro usa 27% da computação que seu antecessor (V3.2) exigia. O cache KV—memória necessária para acompanhar o contexto—cai para 10% do V3.2. O V4-Flash empurra a eficiência ainda mais: 10% de computação e 7% de memória em comparação com o V3.2.

Desempenho em Benchmarks e Posição Competitiva

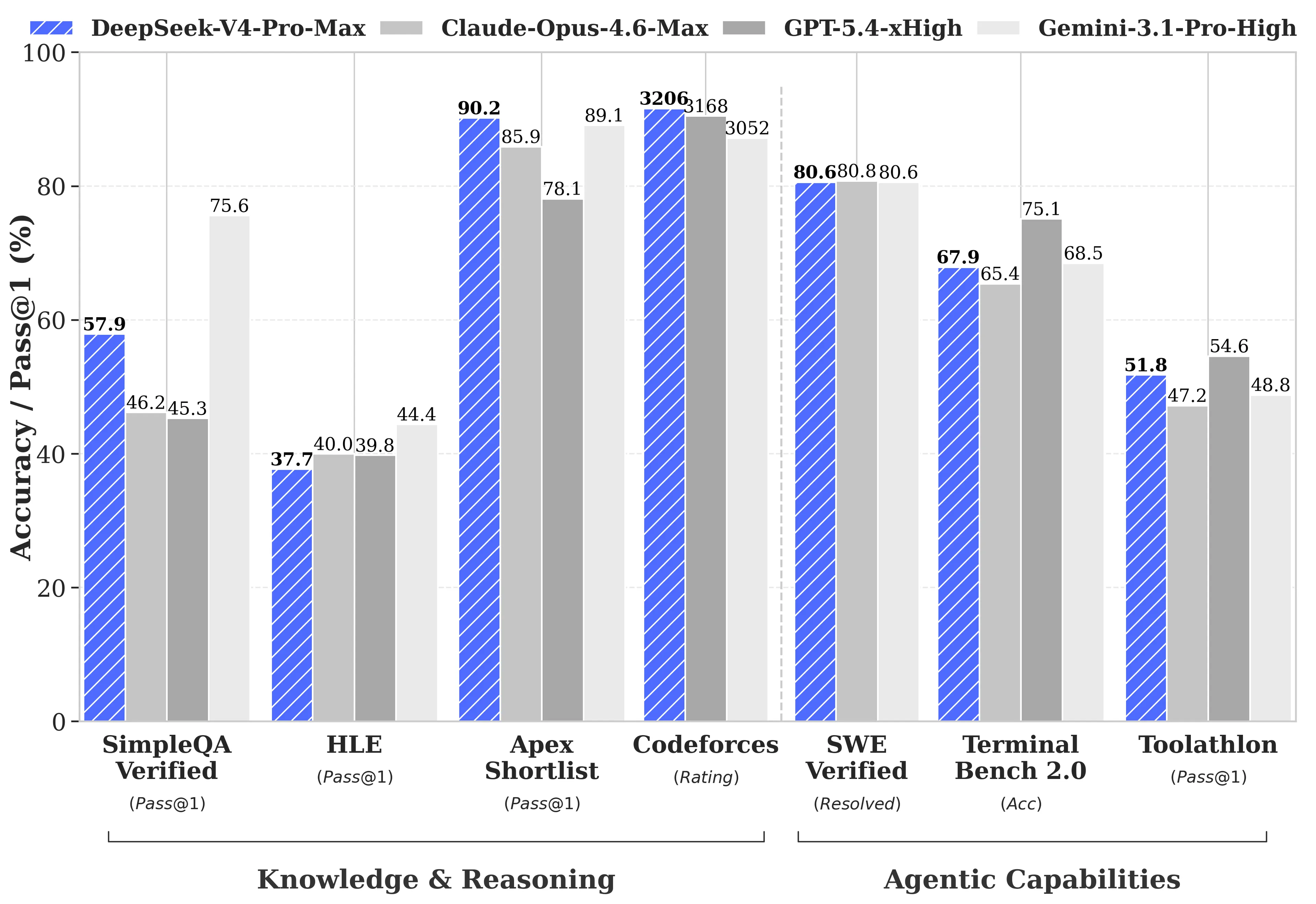

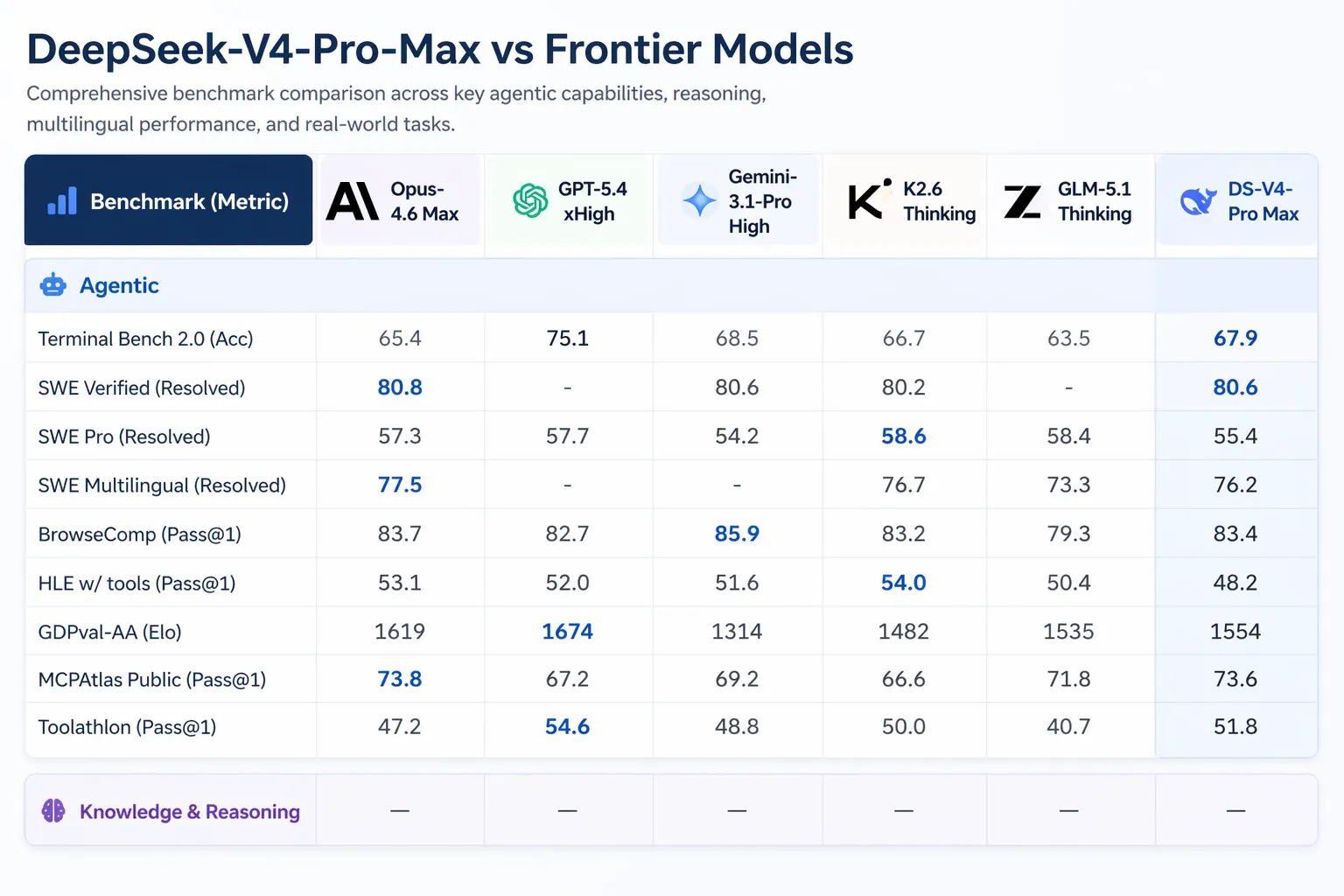

A DeepSeek publicou comparações abrangentes de benchmarks contra GPT-5.4 e Gemini-3.1-Pro, incluindo áreas em que o V4-Pro fica atrás dos concorrentes. Em tarefas de raciocínio, o raciocínio do V4-Pro fica atrás do GPT-5.4 e do Gemini-3.1-Pro em aproximadamente três a seis meses, segundo o relatório técnico da DeepSeek.

Onde o V4-Pro lidera:

- Codeforces (programação competitiva): o V4-Pro marcou 3.206, ficando por volta da 23ª posição entre participantes humanos reais de competições

- Apex Shortlist (problemas matemáticos e de STEM curados): taxa de aprovação de 90,2% versus 85,9% do Opus 4.6 e 78,1% do GPT-5.4

- SWE-Verified (resolução de issues no GitHub): 80,6%, empatando com o Claude Opus 4.6

Onde o V4-Pro fica para trás:

- MMLU-Pro (multitarefa): Gemini-3.1-Pro a 91,0% versus V4-Pro a 87,5%

- GPQA Diamond (conhecimento especializado): Gemini a 94,3 versus V4-Pro a 90,1

- Humanity’s Last Exam (nível de graduação): Gemini-3.1-Pro a 44,4% versus V4-Pro a 37,7%

Em tarefas de contexto longo, o V4-Pro lidera modelos de código aberto e supera o Gemini-3.1-Pro em CorpusQA (simulando análise real de documentos em um milhão de tokens), mas perde para o Claude Opus 4.6 no MRCR, que mede a recuperação de informações específicas enterradas profundamente em textos longos.

Capacidades Agentic e de Codificação

O V4-Pro pode rodar no Claude Code, OpenCode e outras ferramentas de codificação de IA. De acordo com uma pesquisa interna da DeepSeek com 85 desenvolvedores que usaram o V4-Pro como seu principal agente de codificação, 52% disseram que ele estava pronto para ser seu modelo padrão, 39% tenderam a dizer sim, e menos de 9% disseram não. Os testes internos da DeepSeek indicaram que o V4-Pro supera o Claude Sonnet e chega perto do Claude Opus 4.5 em tarefas de codificação agentic.

A Artificial Analysis classificou o V4-Pro em primeiro entre todos os modelos de código aberto no GDPval-AA, um benchmark que testa trabalho de conhecimento economicamente valioso em tarefas de finanças, legais e pesquisa. O V4-Pro-Max marcou 1.554 Elo, à frente do GLM-5.1 (1.535) e do MiniMax’s M2.7 (1.514). O Claude Opus 4.6 pontua 1.619 no mesmo benchmark.

O V4 introduz “pensamento intercalado”, que retém toda a cadeia de raciocínio através das chamadas de ferramentas. Nos modelos anteriores, quando um agente fazia várias chamadas de ferramentas—como buscar na web, executar código e então buscar novamente—o contexto de raciocínio do modelo era descartado entre rodadas. O V4 mantém a continuidade do raciocínio entre etapas, evitando perda de contexto em fluxos de trabalho automatizados complexos.

Cenário Competitivo e Contexto de Preços

O lançamento do V4 chega no meio de uma atividade significativa no espaço de IA. A Anthropic enviou o Claude Opus 4.7 em 16 de abril de 2026. O GPT-5.5 da OpenAI foi lançado em 23 de abril de 2026, com o GPT-5.5 Pro com preço de $30 por milhão de tokens de entrada e $180 por milhão de tokens de saída. O GPT-5.5 supera o V4-Pro no Terminal Bench 2.0 (82,7% versus 70,0%), que testa fluxos de trabalho complexos de agentes de linha de comando.

A Xiaomi lançou o MiMo V2.5 Pro em 22 de abril de 2026, oferecendo capacidades multimodais completas (imagem, áudio, vídeo) a $1 entrada e $3 saída por milhão de tokens. A Tencent lançou o Hy3 no mesmo dia do GPT-5.5.

Para contextualizar preços: o CEO da Cline, Saoud Rizwan, observou que se a Uber tivesse usado a DeepSeek em vez do Claude, o orçamento de IA de 2026—supostamente suficiente para quatro meses de uso—teria durado sete anos.

Implantação e Disponibilidade

Tanto o V4-Pro quanto o V4-Flash são licenciados pela MIT e estão disponíveis no Hugging Face. Por enquanto, os modelos são apenas texto; a DeepSeek declarou que está trabalhando em capacidades multimodais. Ambos os modelos podem ser executados gratuitamente em hardware local ou personalizados com base nas necessidades da empresa.

Os endpoints existentes deepseek-chat e deepseek-reasoner da DeepSeek já roteiam para o V4-Flash em modos não thinking e thinking, respectivamente. Os antigos endpoints deepseek-chat e deepseek-reasoner serão descontinuados em 24 de julho de 2026.

A DeepSeek treinou o V4 parcialmente com chips Huawei Ascend, contornando restrições de exportação dos EUA. A empresa afirmou que, uma vez que 950 novos supernós entrem em operação mais tarde em 2026, o preço do modelo Pro—já baixo—cairá ainda mais.

Implicações Práticas

Para empresas, a estrutura de preços pode mudar os cálculos de custo-benefício. Um modelo que lidera benchmarks de código aberto a US$ 1,74 por milhão de tokens de entrada torna o processamento em larga escala de documentos, revisão jurídica e pipelines de geração de código substancialmente mais baratos do que seis meses atrás. O contexto de um milhão de tokens permite que bases inteiras de código ou arquivos regulatórios sejam processados em uma única solicitação, em vez de serem divididos em chunks ao longo de múltiplas chamadas.

Para desenvolvedores e construtores independentes, o V4-Flash é a consideração principal. A US$ 0,14 de entrada e US$ 0,28 de saída por milhão de tokens, ele é mais barato do que modelos considerados opções de orçamento um ano atrás, enquanto lida com a maioria das tarefas que a versão Pro gerencia.