Novo recurso do Gen-2 "Magic Brush Ma Liang" explodiu, internautas: Urgente

Fonte do artigo: qubits

Fonte da imagem: Gerado por Unbounded AI

Fonte da imagem: Gerado por Unbounded AI

A IA evoluiu a este ponto para se envolver na geração de vídeo?!

Deslize para uma foto para colocar o alvo escolhido em movimento!

É obviamente um camião parado, mas corre com um pincel, e até a luz e a sombra são perfeitamente restauradas:

É obviamente um camião parado, mas corre com um pincel, e até a luz e a sombra são perfeitamente restauradas:

Originalmente, era apenas uma foto de um incêndio, mas agora pode fazer as chamas voarem para o céu com um deslize de sua mão, e o calor está chegando:

Originalmente, era apenas uma foto de um incêndio, mas agora pode fazer as chamas voarem para o céu com um deslize de sua mão, e o calor está chegando:

Se você continuar assim, você não pode dizer a diferença entre fotos e vídeos reais!

Se você continuar assim, você não pode dizer a diferença entre fotos e vídeos reais!

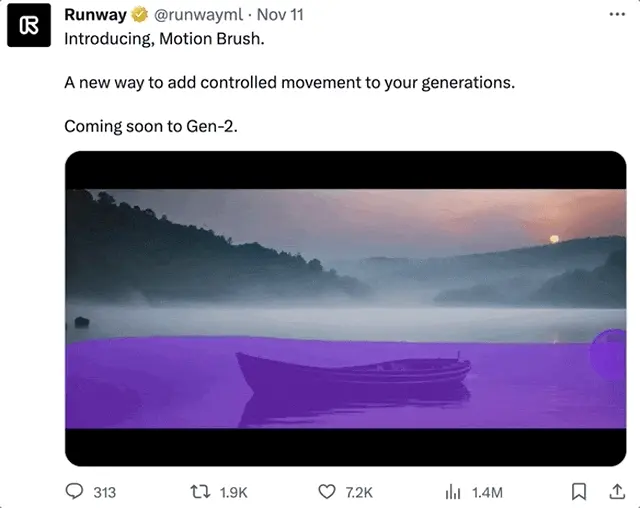

Acontece que este é um novo recurso criado pela Runway para o software de vídeo AI Gen-2, que pode fazer com que os objetos na imagem se movam com uma pintura e pincel, e o grau de realismo não é menor do que o da caneta mágica Ma Liang.

Embora seja apenas uma função de aquecimento, explodiu na Internet assim que o efeito saiu:

Vendo que os internautas se transformaram em reis ansiosos, um a um, eles gritaram “Mal posso esperar para tentar uma onda”:

Vendo que os internautas se transformaram em reis ansiosos, um a um, eles gritaram “Mal posso esperar para tentar uma onda”:

A Runway também lançou mais recursos para aquecer o efeito, vamos dar uma olhada.

A Runway também lançou mais recursos para aquecer o efeito, vamos dar uma olhada.

**Foto para vídeo, mova-se para onde quer que aponte **

Esta nova funcionalidade na pista chama-se Motion Brush.

Como o nome sugere, você só precisa usar este pincel para “pintar” qualquer objeto na imagem para fazê-los se mover.

Não só pode ser uma pessoa estática, mas até o movimento da saia e da cabeça é natural:

Também pode ser um líquido fluido, como uma cachoeira, e até mesmo a névoa pode ser restaurada:

Também pode ser um líquido fluido, como uma cachoeira, e até mesmo a névoa pode ser restaurada:

Ou um cigarro que ainda não se apagou:

Ou um cigarro que ainda não se apagou:

Uma fogueira acesa na frente de todos:

Uma fogueira acesa na frente de todos:

Fundos maiores também podem ser dinâmicos, alterando até mesmo os efeitos de luz e sombra da imagem, como as nuvens escuras em movimento rápido:

Fundos maiores também podem ser dinâmicos, alterando até mesmo os efeitos de luz e sombra da imagem, como as nuvens escuras em movimento rápido:

Claro, estes são todos os “cartões brilhantes” da Runway que tomam a iniciativa de dizer que “fizeram alguma coisa” com as fotos.

Claro, estes são todos os “cartões brilhantes” da Runway que tomam a iniciativa de dizer que “fizeram alguma coisa” com as fotos.

Os seguintes vídeos sem marcas de esfregaço são quase completamente indistinguíveis dos ingredientes modificados pela IA:

Uma série de efeitos explodiu, o que também levou ao fato de que a função não foi lançada oficialmente, e os internautas não podem esperar.

Uma série de efeitos explodiu, o que também levou ao fato de que a função não foi lançada oficialmente, e os internautas não podem esperar.

Muitas pessoas estão tentando entender como esse recurso é implementado. Há também internautas que prestam mais atenção em quando a função vai sair, e esperam que o link seja diretamente no 321 (cabeça manual do cão)

Pode, de facto, esperar uma onda.

Pode, de facto, esperar uma onda.

Mas não é apenas este novo recurso Motion Brush que a Runway introduziu.

A recente enxurrada de avanços gerados por IA parece indicar que o campo da geração de vídeo está realmente prestes a inaugurar uma explosão tecnológica.

O vídeo gerado por IA está realmente em ascensão?

Assim como nos últimos dias, alguns internautas desenvolveram uma nova maneira de jogar o muito popular software de animação Wensheng Animatediff.

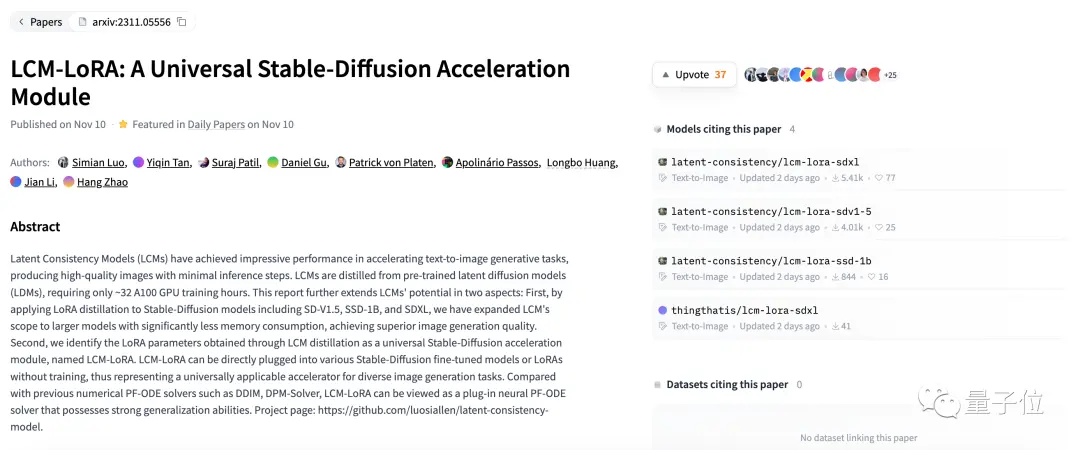

Combinado com a pesquisa mais recente, LCM-LORA, leva apenas 7 segundos** para gerar um vídeo animado com 16 quadros.

Combinado com a pesquisa mais recente, LCM-LORA, leva apenas 7 segundos** para gerar um vídeo animado com 16 quadros.

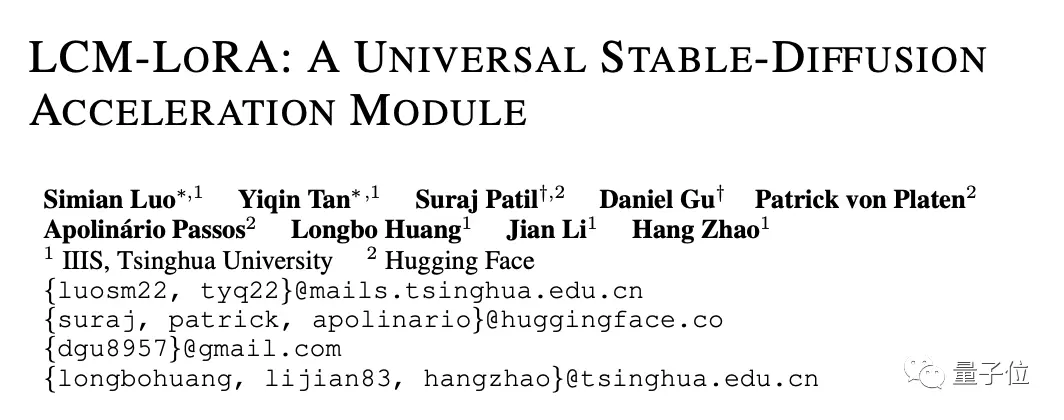

LCM-LoRa é uma nova tecnologia de geração de imagem de IA da Universidade de Tsinghua e Hugging Face, que pode melhorar muito a velocidade de geração de imagem da Difusão Estável.

Entre eles, o LCM (Latent Consistency Models) é um novo método de geração de imagens baseado no “modelo de consistência” da OpenAI no início deste ano, que pode gerar rapidamente 768×768 imagens de alta resolução.

No entanto, o LCM não é compatível com os modelos existentes, então a Universidade de Tsinghua e os membros da Huhuyan lançaram uma nova versão do modelo LCM-LoRa, que pode ser compatível com todos os modelos de difusão estável e acelerar a velocidade de desenho.

Combinado com Animatediff, leva apenas cerca de 7 segundos para gerar tal animação:

Combinado com Animatediff, leva apenas cerca de 7 segundos para gerar tal animação:

Atualmente, o LCM-LORA tem sido de código aberto no Hug Face.

Atualmente, o LCM-LORA tem sido de código aberto no Hug Face.

Como você se sente sobre o progresso recente na geração de vídeo de IA e quão longe você está de ser utilizável?

Como você se sente sobre o progresso recente na geração de vídeo de IA e quão longe você está de ser utilizável?

Links de referência:

[1]

[2]