Google снова выходит в открытую гонку open source ИИ с Gemma 4

Кратко

- Google выпустила Gemma 4 — семейство открытых моделей под лицензией Apache 2.0.

- Линейка из четырех моделей охватывает устройства от телефонов до дата-центров: модель 31B уже занимает #3 в мире.

- Открытому ИИ в США нужен был дополнительный импульс — Gemma 4, поддерживаемая DeepMind, позиционирует себя как самый сильный американский претендент против DeepSeek, Qwen и других китайских лидеров.

Сегодня намерения Google в области открытого ИИ стали гораздо серьезнее. Компания выпустила Gemma 4 — семейство из четырех моделей с открытыми весами, созданное на основе тех же исследований, что и Gemini 3, и лицензированное под Apache 2.0 — заметный отход от более ограничительных условий предыдущих версий Gemma. Разработчики скачали прошлые поколения Gemma более 400 миллионов раз, что породило более 100,000 вариантов сообщества. Этот релиз — самый амбициозный на сегодняшний день.

Мы только что выпустили Gemma 4 — наши самые интеллектуальные открытые модели на сегодняшний день.

Построенная на тех же исследованиях мирового уровня, что и Gemini 3, Gemma 4 приносит прорывной интеллект непосредственно на ваше собственное оборудование для расширенного рассуждения и агентных рабочих процессов.

Выпущена под коммерчес… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) April 2, 2026

В течение прошлого года лидерборд открытого ИИ в основном был китайским. DeepSeek, Minimax, GLM и Qwen доминировали в верхних позициях, оставляя американские альтернативы судорожно искать актуальность. Как писал Decrypt в прошлом году, китайские открытые модели выросли с едва 1.2% использования глобальных open-model в конце 2024 года до примерно 30% к концу 2025 года; Qwen от Alibaba даже обогнал Llama от Meta как самый используемый self-hosted-модель в мире. Раньше Llama от Meta была настройкой по умолчанию для разработчиков, которым нужен был способный, локально запускаемый модель. Эта репутация ослабла — лицензионные условия, контролируемые Meta, вызвали вопросы о ее реальном статусе как open-source, и ее результаты просели по сравнению с китайской конкуренцией. Семейство OLMo от Allen Institute попыталось заполнить пробел, но не смогло набрать значимого распространения. OpenAI выпустила свои модели gpt-oss в августе 2025 года — это дало экосистеме глоток свежего воздуха, но их никогда не проектировали как конкурентов на уровне передовых разработок. А вчера 30‑человеческий стартап из США Arcee AI выпустил Trinity — открытую модель с 400 миллиардов параметров, которая убедительно показала, что американская сцена не полностью мертва. Gemma 4 продолжает этот импульс — на этот раз с полной поддержкой DeepMind от Google, превращая ее, пожалуй, в лучшую американскую модель в среде открытого ИИ. Модель «построена на тех же исследованиях и технологиях мирового уровня, что и Gemini 3», — заявила Google в своем анонсе. Gemma 4 выходит в четырех размерах: Effective 2B и 4B для телефонов и edge-устройств, модель 26B Mixture of Experts, ориентированная на скорость, и модель 31B Dense, оптимизированная для сырого качества.

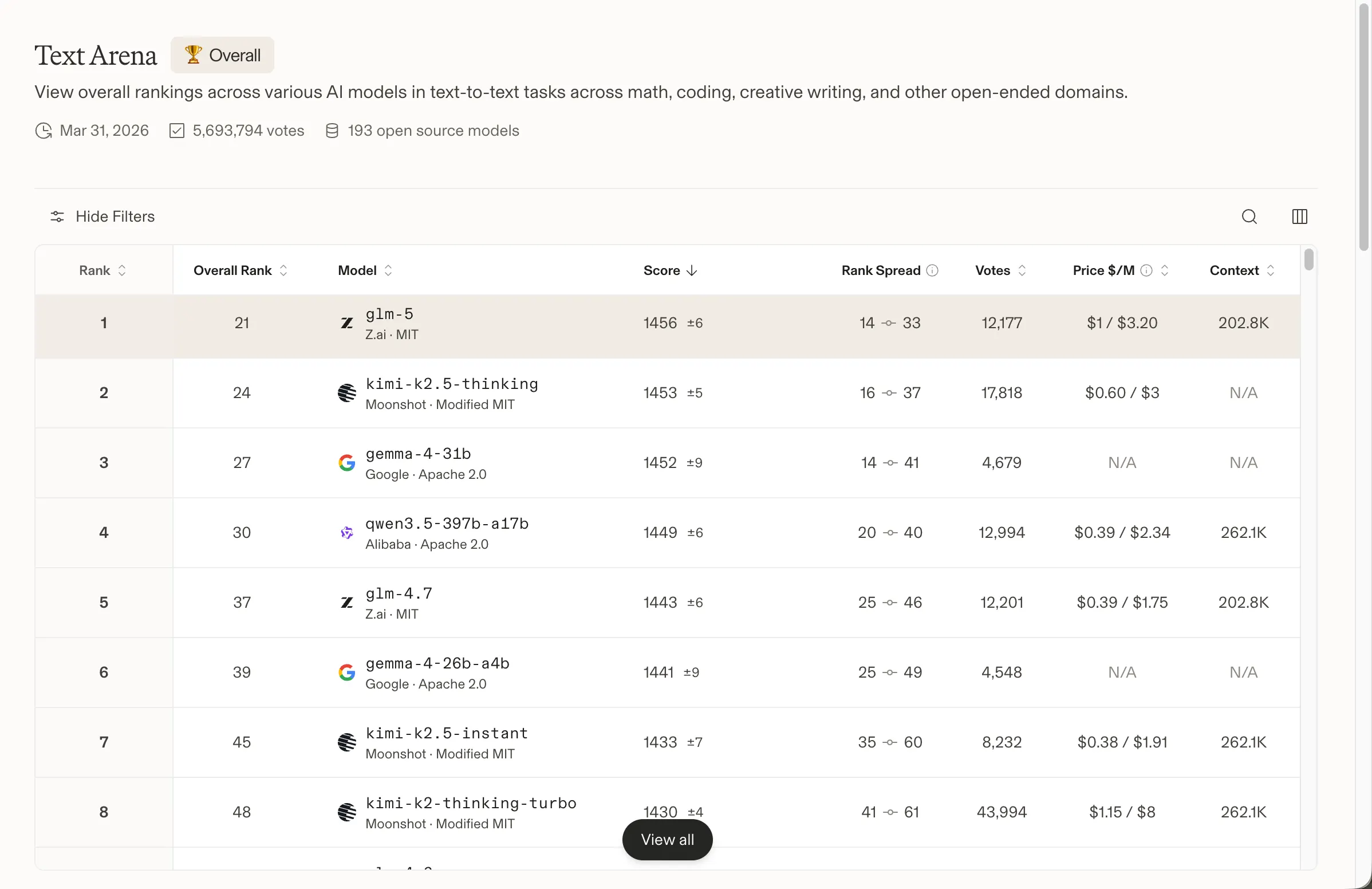

Сейчас 31B Dense занимает третье место среди всех открытых моделей на текстовом лидерборде Arena AI. 26B MoE находится на шестом. Google утверждает, что обе модели обгоняют по результатам модели в 20 раз большего размера — и это утверждение подтверждается хотя бы по цифрам Arena AI, где китайские модели по-прежнему занимают первые два места.

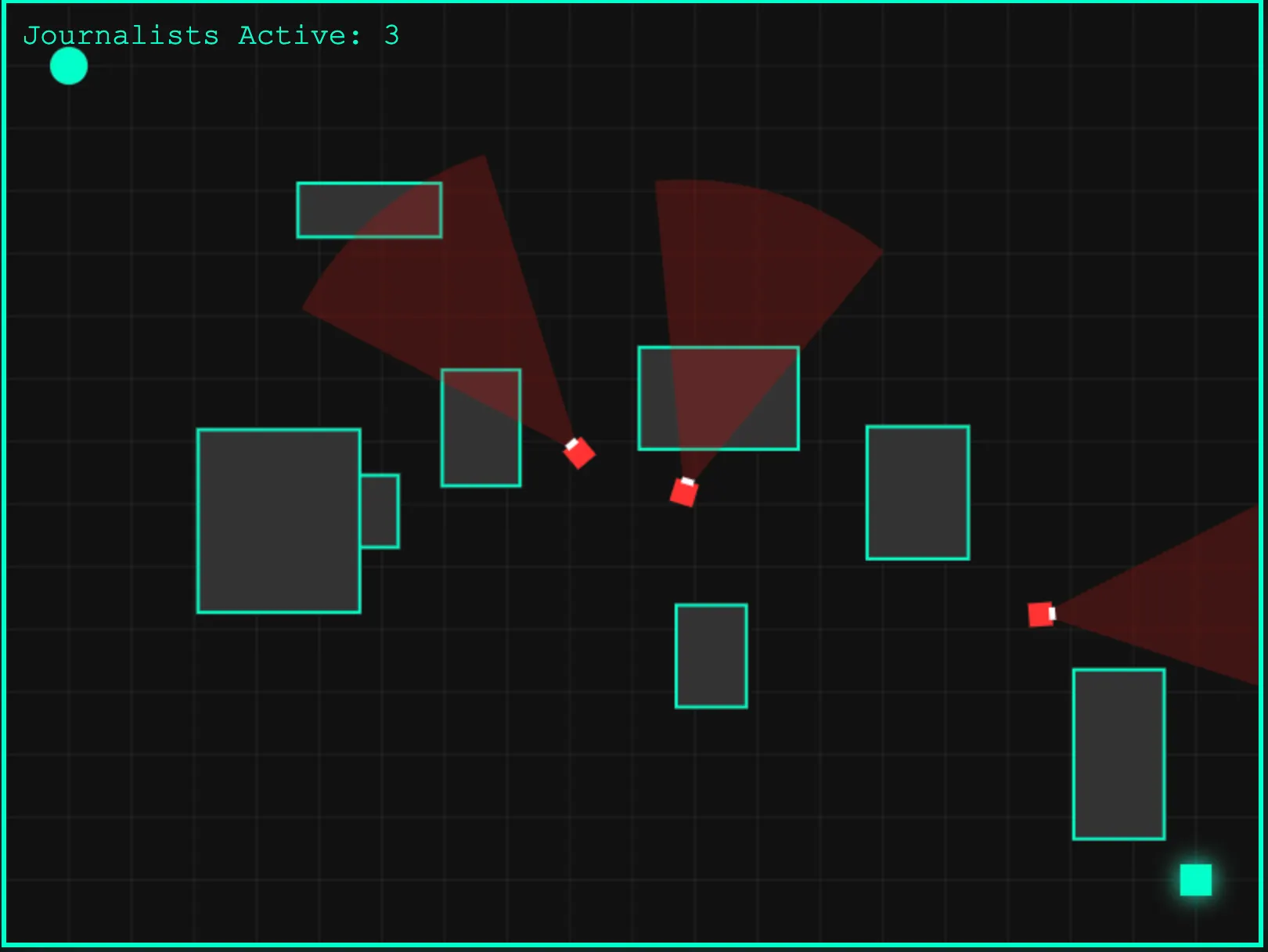

Мы протестировали Gemma 4. Она способна — с некоторыми оговорками. Модель применяет рассуждение даже к задачам, где оно не требуется, из-за чего ответы могут казаться чрезмерно «переработанными» для простых запросов. Креативное письмо — на приемлемом уровне, не вдохновляющее, и, вероятно, улучшится при более конкретных инструкциях и prompt engineering. Где она проявилась наиболее отчетливо — это код. Когда попросили сгенерировать игру, результат не был особенно эффектным или детализированным, но она работала без ошибок с первой попытки. Неплохо для модели с 41 миллиардом параметров. Эта надежность zero-shot, пожалуй, ценнее, чем более красивый результат, который потом потребует отладки. Вы можете попробовать игру здесь (базовую, но работоспособную).

Все четыре варианта покрывают весь спектр оборудования. Модели E2B и E4B разработаны для Android‑телефонов, Raspberry Pi и edge‑устройств, работают полностью офлайн с почти нулевой задержкой, поддерживают нативный ввод аудио и имеют окно контекста 128K. Модели 26B и 31B нацелены на рабочие станции и облачные развертывания: они расширяют контекст до 256K и добавляют нативный function-calling и структурированный вывод в формате JSON для построения автономных агентов. Все четыре модели обрабатывают изображения и видео нативно. Полноточные веса больших моделей помещаются на одном графическом процессоре NVIDIA H100 емкостью 80GB; квантизированные версии работают на потребительском оборудовании. Лицензия Apache 2.0 — еще один главный акцент. Предыдущие релизы Gemma от Google использовали пользовательскую лицензию, которая создавала юридическую неоднозначность для коммерческих продуктов. Apache 2.0 полностью убирает это трение: разработчики могут модифицировать, перераспределять и коммерциализировать без опасений, что Google позже изменит условия. Сооснователь Hugging Face Клемент Деланджэ похвалил это, сказав, что «Local AI наступает», и что это будущее индустрии ИИ. CEO Google DeepMind Демис Хассабис пошел еще дальше, назвав Gemma 4 «лучшими открытыми моделями в мире для соответствующих размеров».

В восторге от запуска Gemma 4: лучшие открытые модели в мире для соответствующих размеров. Доступны в 4 размерах, которые можно донастроить под вашу конкретную задачу: 31B dense для отличной “сырой” производительности, 26B MoE для низкой задержки и effective 2B & 4B для использования на edge‑устройствах — happy building! pic.twitter.com/Sjbe3ph8xr

— Demis Hassabis (@demishassabis) April 2, 2026

Это сильное заявление. Собственные системы от Anthropic, OpenAI и самого Google Gemini по‑прежнему лидируют на самых сложных бенчмарках. Но для open-weight моделей, которые можно запускать локально, свободно модифицировать и развертывать в своей инфраструктуре? Конкуренция стала заметно менее плотной. Сейчас вы можете попробовать Gemma 4 в Google AI Studio (31B и 26B) или в Google AI Edge Gallery (E2B и E4B). Веса моделей также доступны на Hugging Face, Kaggle и Ollama.