Tiefe Analyse Intuition: Wie das Internet im Zeitalter der KI-Agenten neu gestaltet werden kann?

Dieser Bericht wurde von Tiger Research verfasst und analysiert, wie Intuition durch atomare Wissensstrukturierung, Token-gesteuerte Registrierungstabellen (TCR) einen standardisierten Konsens erreicht und ein signalbasiertes Vertrauensmaßsystem für den Wiederaufbau der Netzwerk-Infrastruktur im Zeitalter der intelligenten Agenten (AI) implementiert.

Punkte Zusammenfassung

- Die Ära der KI-Agenten ist bereits angebrochen. KI-Agenten können ihr Potenzial nicht voll ausschöpfen. Die derzeitige Netzwerk-Infrastruktur ist für Menschen ausgelegt. Websites verwenden unterschiedliche Datenformate. Informationen sind immer noch unvalidiert. Das erschwert es den Agenten, Daten zu verstehen und zu verarbeiten.

- Intuition entwickelt die Vision des semantischen Webs durch Web3-Methoden weiter. Es löst die bestehenden Einschränkungen. Das System strukturiert Wissen in Atome (Atoms). Es verwendet ein Token-gesteuertes Register (TCR), um Konsens über die Nutzung von Daten zu erreichen. Signale (Signal) bestimmen das Vertrauen in die Daten.

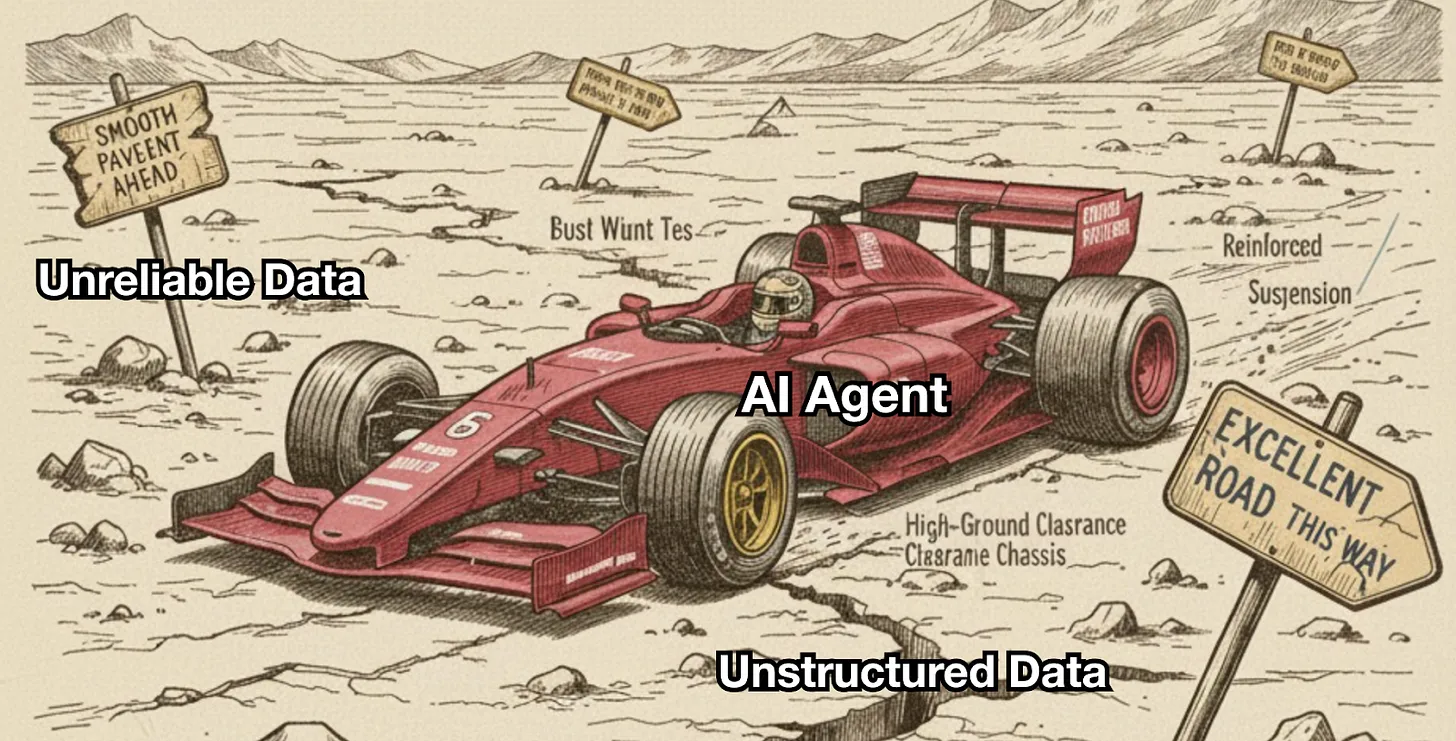

- Intuition wird das Netzwerk verändern. Das aktuelle Netzwerk ähnelt einer unbefestigten Straße. Intuition schafft Autobahnen, auf denen Agenten sicher betrieben werden können. Es wird zum neuen Infrastrukturstandard. Dies wird das wahre Potenzial der KI-Ära der Agenten verwirklichen.

1. Das Zeitalter der intelligenten Systeme beginnt: Ist die Netzwerkinfrastruktur ausreichend?

Die Ära der intelligenten Agenten AI entwickelt sich prächtig. Wir können uns eine Zukunft vorstellen, in der persönliche Agenten alles von der Reiseplanung bis hin zum komplexen Finanzmanagement übernehmen. Aber in der Praxis ist die Situation nicht so einfach. Das Problem liegt nicht in der Leistung der KI selbst. Die wirkliche Einschränkung liegt in der aktuellen Netzwerk-Infrastruktur.

Das Netzwerk ist für den Menschen zum Lesen und Interpretieren über Browser aufgebaut. Daher ist es sehr ungeeignet für Agenten, die semantische Analysen durchführen und Beziehungen über Datenquellen hinweg herstellen müssen. Diese Einschränkungen sind im täglichen Dienst offensichtlich. Fluggesellschafts-Websites geben die Abflugzeit möglicherweise als “14:30” an, während Hotel-Websites die Check-in-Zeit als “14:30 Uhr” anzeigen. Menschen verstehen sofort, dass beide die gleiche Zeit sind, aber Agenten interpretieren sie als völlig unterschiedliche Datenformate.

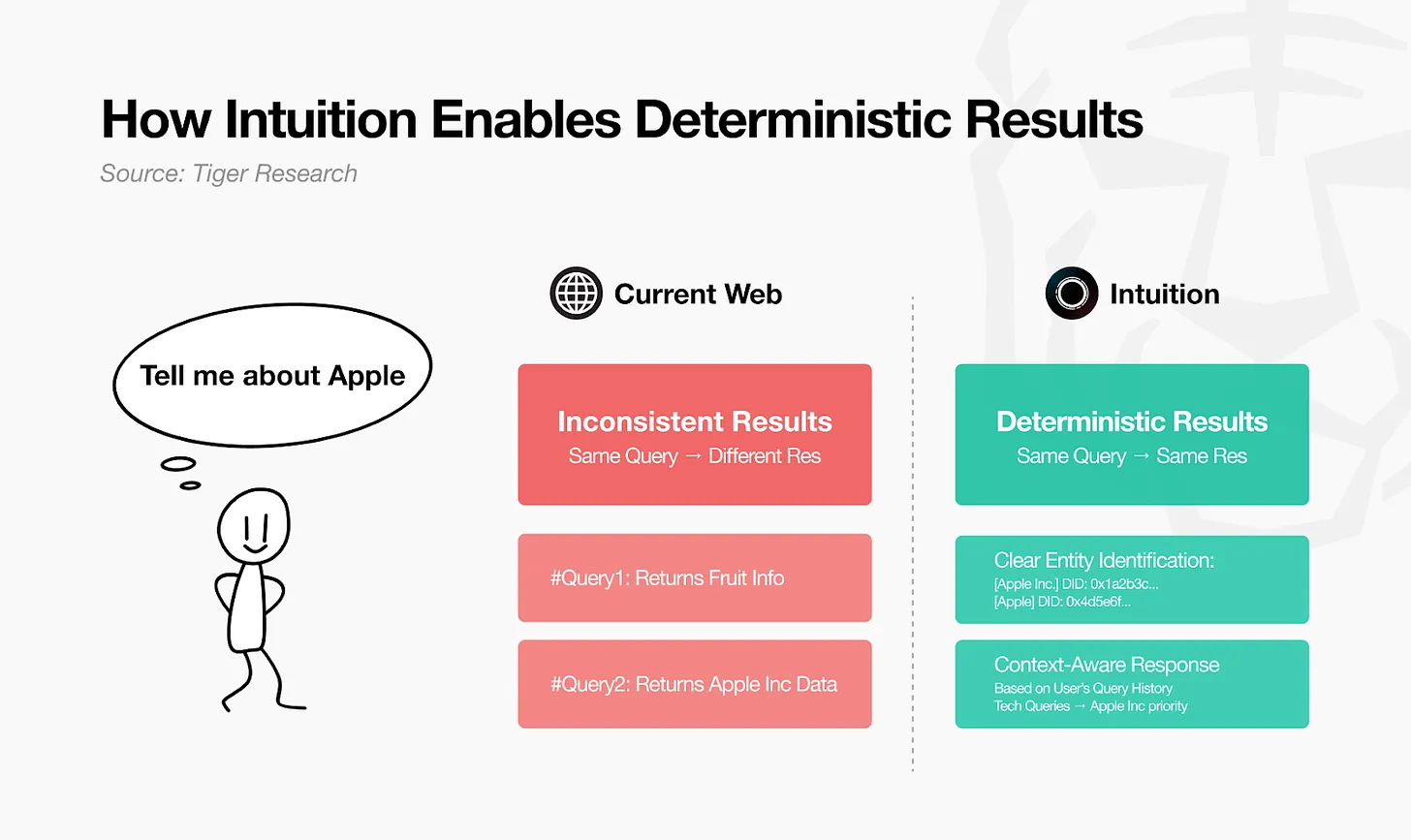

Quelle: Tiger Research

Das Problem liegt nicht nur im Formatunterschied. Eine zentrale Herausforderung besteht darin, ob die Agenten den Daten selbst vertrauen können. Menschen können unvollständige Informationen durch das Vertrauen auf Kontext und vorherige Erfahrungen verarbeiten. Im Gegensatz dazu fehlt es den Agenten an klaren Standards zur Bewertung der Quelle oder Zuverlässigkeit. Dies macht sie anfällig für fehlerhafte Eingaben, fehlerhafte Schlüsse und sogar Illusionen.

Letztendlich können selbst die fortschrittlichsten Agenten unter diesen Umständen nicht gedeihen. Sie sind wie F1-Rennwagen: So leistungsstark sie auch sein mögen, sie können nicht mit voller Geschwindigkeit auf unbefestigten Straßen (unstrukturierte Daten) fahren. Wenn irreführende Schilder (unzuverlässige Daten) entlang der Strecke verteilt sind, können sie möglicherweise niemals das Ziel erreichen.

2. Technologische Schulden im Netzwerk: Infrastruktur neu aufbauen

Dieses Problem wurde vor über 20 Jahren von Tim Berners-Lee, dem Gründer des World Wide Web, erstmals durch seinen Vorschlag für das semantische Web angesprochen.

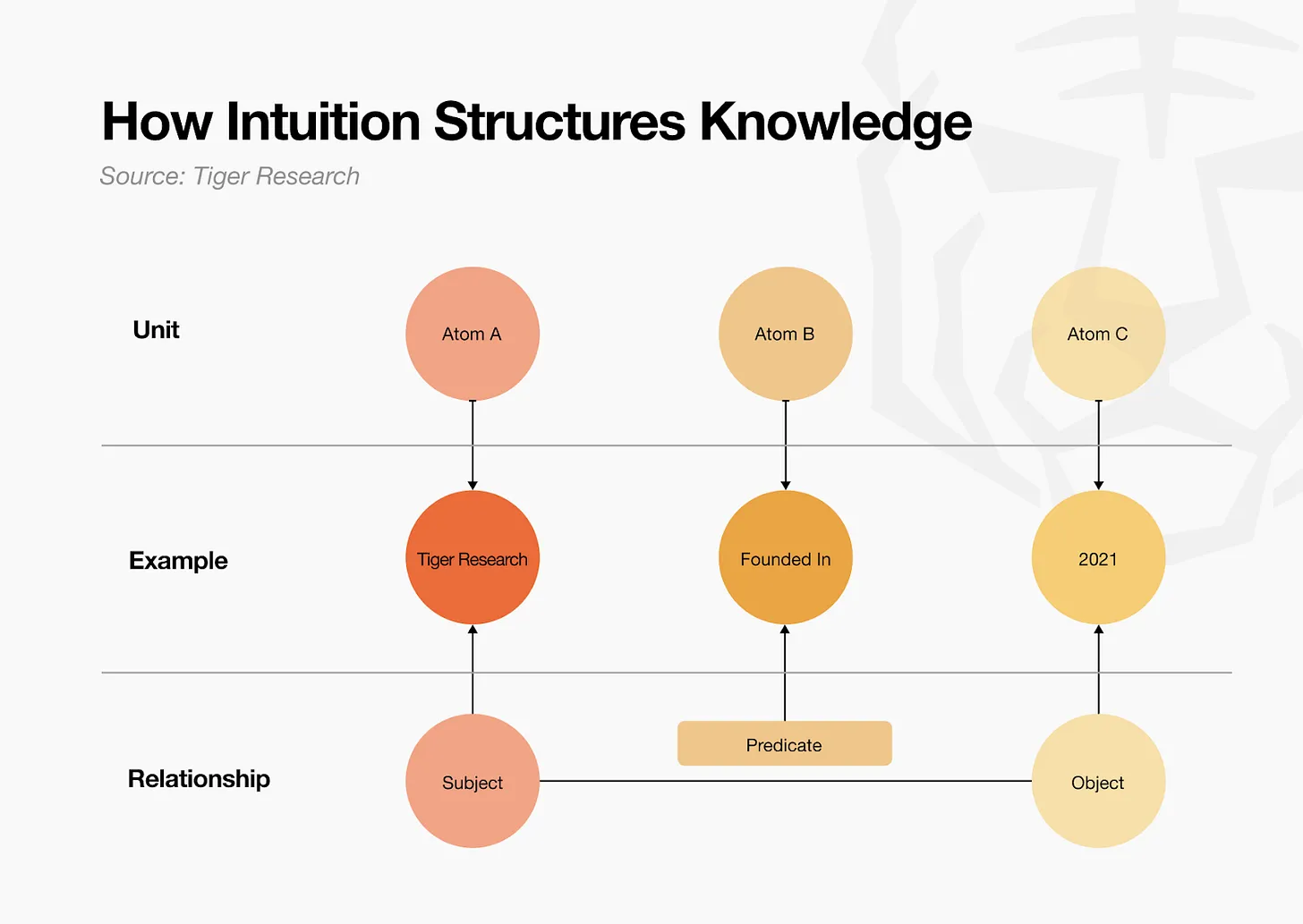

Der Kerngedanke des Semantischen Webs ist ganz einfach: Strukturierte Netzwerkinformationen, damit Maschinen sie verstehen können, und nicht nur für Menschen lesbaren Text. Zum Beispiel ist “Tiger Research wurde 2021 gegründet” für Menschen ganz klar, aber für Maschinen ist es nur eine Zeichenkette. Das Semantische Web strukturiert es zu “Tiger Research (Subjekt) - wurde gegründet (Prädikat) - 2021 (Objekt)”, damit Maschinen die Bedeutung interpretieren können.

Diese Methode ist ihrer Zeit voraus, konnte jedoch letztendlich nicht umgesetzt werden. Der Hauptgrund sind die Implementierungsherausforderungen. Es hat sich als schwierig erwiesen, einen Konsens über Datenformate und -nutzungsstandards zu erzielen. Noch wichtiger ist, dass es nahezu unmöglich ist, große Datensätze durch freiwillige Benutzerbeiträge zu erstellen und zu pflegen. Die Beitragsleister erhalten keine direkten Belohnungen oder Vorteile. Darüber hinaus bleibt die Frage, ob die erstellten Daten vertrauenswürdig sind, ein ungelöstes Problem.

Dennoch bleibt die Vision des semantischen Webs gültig. Die Prinzipien, nach denen Maschinen Daten auf semantischer Ebene verstehen und nutzen sollten, haben sich nicht geändert. In der AI-Ära wird dieser Bedarf noch entscheidender.

3. Intuition: Die Wiederbelebung des semantischen Webs auf Web3-Art.

Intuition entwickelt die Vision des semantischen Webs durch Web3-Methoden, um die bestehenden Einschränkungen zu beheben. Der Kern besteht darin, ein System zu schaffen, das Benutzer anregt, freiwillig an der Ansammlung und Verifizierung von qualitativ hochwertigen strukturierten Daten teilzunehmen. Dieses System baut ein maschinenlesbares, klar nachvollziehbares und verifiziertes Wissensgraph auf. Letztendlich bietet dies die Grundlage für einen zuverlässigen Betrieb von Agenten und bringt uns näher an die Zukunft, die wir uns vorstellen.

3.1. Atom: Wissensbausteine

Intuition unterteilt zunächst sämtliches Wissen in die kleinsten Einheiten, die als Atome (Atoms) bezeichnet werden. Atome repräsentieren Konzepte wie Personen, Daten, Organisationen oder Eigenschaften. Jedes Atom hat einen einzigartigen Identifikator (unter Verwendung von dezentralen Identifikatoren DIDs und ähnlichen Technologien) und existiert unabhängig. Jedes Atom zeichnet die Informationen des Beitragsgebers auf, sodass Sie überprüfen können, wer wann welche Informationen hinzugefügt hat.

Der Grund, warum Wissen in Atome zerlegt wird, ist klar. Informationen erscheinen oft in Form komplexer Sätze. Maschinen wie Agenten haben strukturelle Einschränkungen beim Parsen und Verstehen solcher komplexen Informationen. Sie haben auch Schwierigkeiten zu bestimmen, welche Teile genau sind und welche falsch.

Subjekt: Tiger Research

Prädikat: gegründet in

Objekt: 2021

Betrachten Sie den Satz “Tiger Research wurde 2021 gegründet”. Dies kann wahr sein oder nur teilweise falsch. Ob die Organisation tatsächlich existiert, ob das “Gründungsdatum” eine angemessene Eigenschaft ist und ob 2021 korrekt ist, muss jeweils einzeln überprüft werden. Es ist jedoch schwierig, den gesamten Satz als eine Einheit zu behandeln und zu unterscheiden, welche Elemente genau sind und welche falsch sind. Es wird auch kompliziert, die Quellen jeder Information nachzuverfolgen.

Das Atom hat dieses Problem gelöst. Indem Sie jedes Element als unabhängiges Atom definieren, wie [Tiger Research], [gegründet in], [2021], können Sie die Quelle aufzeichnen und jedes Element einzeln überprüfen.

Subjekt: Das Gründungsdatum von Tiger Research ist 2021.

Prädikat: basierend auf

Objekt: Offizielle Aufzeichnungen

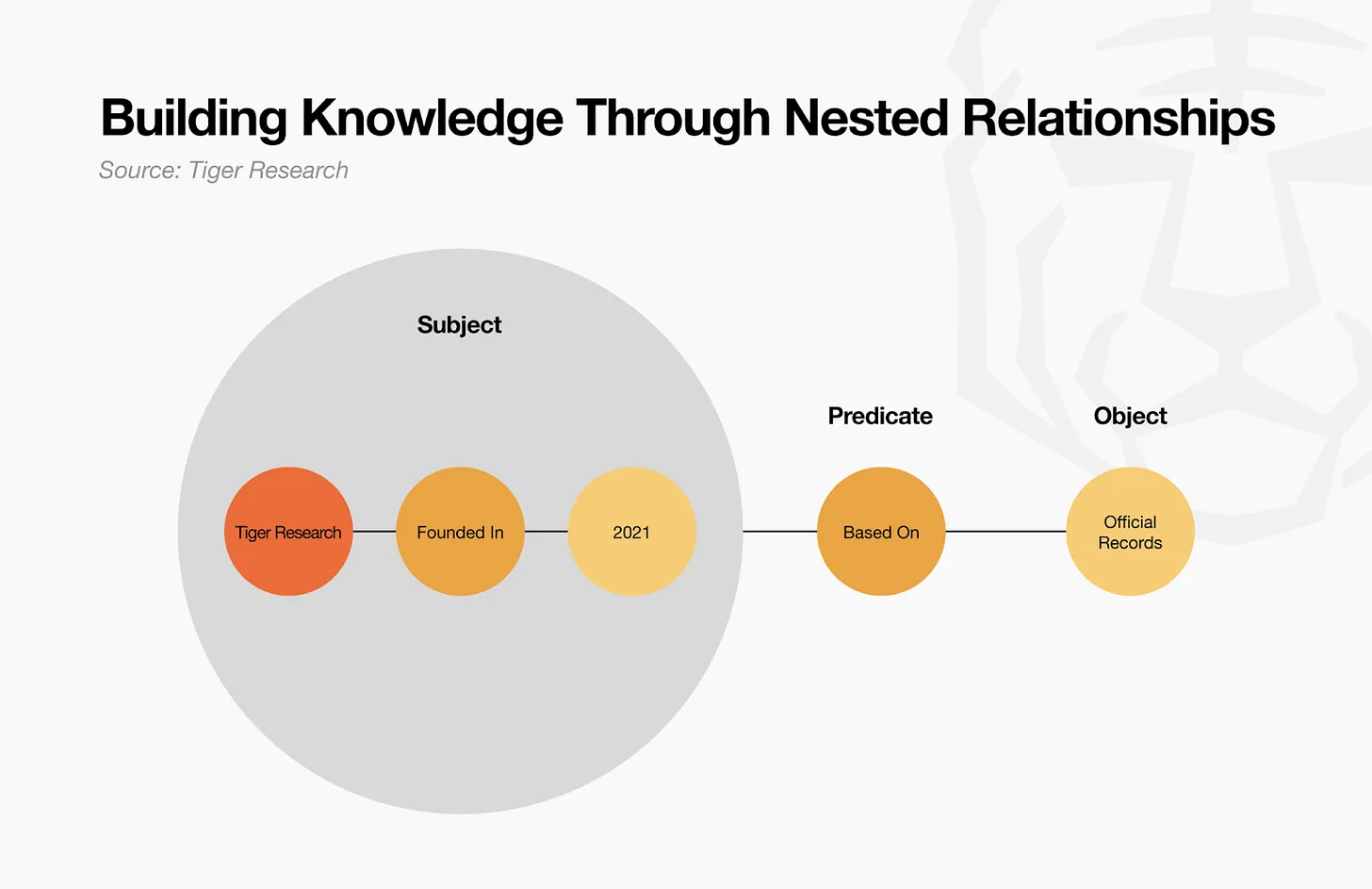

Atome sind nicht nur Werkzeuge zur Aufteilung von Informationen – sie können wie LEGO-Steine kombiniert werden. Zum Beispiel verbinden sich einzelne Atome [Tiger Research]、[成立于] und [2021年] zu einem Triple. Dies schafft bedeutungsvolle Informationen: „Tiger Research成立于2021年.“ Dies folgt der gleichen Struktur wie die Triples im semantischen Web RDF (Resource Description Framework).

Diese Tripel können selbst auch zu Atomen werden. Das Tripel “Tiger Research wurde 2021 gegründet” kann in neue Tripel erweitert werden, wie zum Beispiel “Das Gründungsdatum von Tiger Research im Jahr 2021 basiert auf Geschäftsdaten.” Auf diese Weise kombinieren sich Atome und Tripel wiederholt und entwickeln sich von kleinen Einheiten zu größeren Strukturen.

Das Ergebnis ist, dass Intuition ein fraktales Wissensdiagramm aufgebaut hat, das sich unendlich aus grundlegenden Elementen erweitern lässt. Selbst komplexes Wissen kann zerlegt werden, um verifiziert zu werden, und dann wieder zusammengesetzt werden.

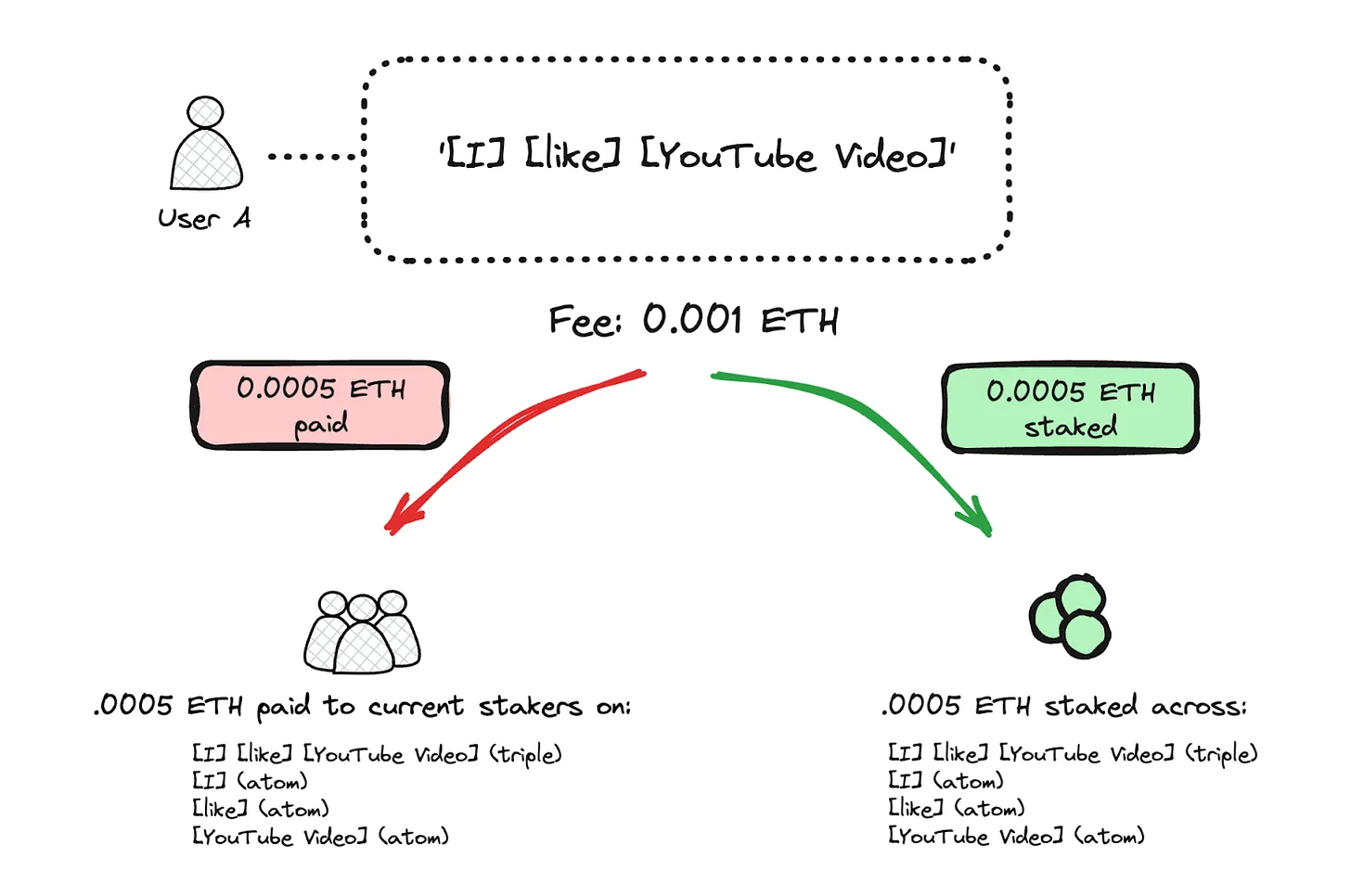

3.2. TCRs: Marktgetriebener Konsens

Wenn Intuition durch Atome ein strukturiertes Wissenskonzept bereitstellt, gibt es immer noch drei Schlüsselprobleme: Wer wird zur Erstellung dieser Atome beitragen? Welche Atome sind vertrauenswürdig? Wenn verschiedene Atome um die Darstellung desselben Konzepts konkurrieren, welches wird zum Standard?

Quelle: Intuition Whitepaper

Intuition löst dieses Problem durch TCRs. TCRs basieren auf Community-bewerteten Inhalten zur Filterung von Einträgen. Token-Staking spiegelt diese Bewertungen wider. Benutzer setzen $TRUST (Intuitions nativen Token), wenn sie neue Atome, Tripel oder Datenstrukturen vorschlagen. Andere Teilnehmer setzen Token auf die Unterstützer, wenn sie den Vorschlag nützlich finden; wenn sie ihn als nutzlos erachten, setzen sie Token auf die Gegner. Sie können auch auf konkurrierende Alternativen setzen. Wenn die von den Benutzern gewählten Daten häufig verwendet werden oder hohe Bewertungen erhalten, erhalten sie Belohnungen. Andernfalls verlieren sie einen Teil ihres Stakes.

TCRs validieren einzelne Nachweise, aber sie lösen auch das Problem der Ontologie-Standardisierung effektiv. Ontologie-Standardisierung bedeutet, zu bestimmen, welche Methode zum gemeinsamen Standard wird, wenn es verschiedene Möglichkeiten gibt, dasselbe Konzept auszudrücken. Verteilte Systeme stehen vor der Herausforderung, diesen Konsens ohne zentrale Koordination zu erreichen.

Betrachten Sie die Prädikate der Bewertungen von zwei konkurrierenden Produkten: [hasReview] und [customerFeedback]. Wenn [hasReview] zuerst eingeführt wird und viele Benutzer darauf basieren, haben frühe Mitwirkende Token-Rechte an diesem Erfolg. Gleichzeitig erhalten die Unterstützer von [customerFeedback] wirtschaftliche Anreize und wenden sich allmählich einem breiter angenommenen Standard zu.

Dieser Mechanismus spiegelt wider, wie der ERC-20 Token-Standard auf natürliche Weise angenommen wird. Entwickler, die ERC-20 übernehmen, erhalten klare Vorteile in Bezug auf Kompatibilität – direkte Integration in bestehende Wallets, Börsen und dApps. Diese Vorteile ziehen Entwickler auf natürliche Weise an, ERC-20 zu verwenden. Dies zeigt, dass marktgetriebene Entscheidungen allein das Standardisierungsproblem in einer verteilten Umgebung lösen können. TCRs arbeiten nach ähnlichen Prinzipien. Sie verringern den Kampf der Agenten mit fragmentierten Datenformaten und bieten eine Umgebung, in der Informationen konsistenter verstanden und verarbeitet werden können.

3.3. Signal: Aufbau eines vertrauensbasierten Wissensnetzwerks

Intuition strukturiert Wissen durch Atome und Tripel und erreicht Konsens über “was tatsächlich verwendet wird” mithilfe von Anreizen.

Die letzte Herausforderung bleibt bestehen: Inwieweit können wir diesen Informationen vertrauen? Intuition führt Signal ein, um diese Lücke zu schließen. Das Signal drückt das Vertrauen oder Misstrauen der Benutzer in bestimmte Atome oder Tripel aus. Es geht über die einfache Aufzeichnung der Datenexistenz hinaus – es erfasst, wie viel Unterstützung die Daten in verschiedenen Kontexten erhalten. Das Signal systematisiert den sozialen Verifizierungsprozess, den wir im realen Leben verwenden, zum Beispiel wenn wir Informationen beurteilen, basierend auf “Zuverlässige Personen haben das empfohlen” oder “Experten haben es überprüft”.

Signale werden auf drei Arten akkumuliert. Erstens beinhalten explizite Signale absichtliche Bewertungen durch den Nutzer, wie Token-Staking. Zweitens entstehen implizite Signale natürlich aus Nutzungsmustern (wie wiederholte Abfragen oder Anwendungen). Schließlich schaffen übertragene Signale Beziehungseffekte – wenn jemand, dem ich vertraue, Informationen unterstützt, neige ich auch dazu, diesen mehr zu vertrauen. Diese drei Aspekte zusammen bilden ein Wissensnetzwerk, das zeigt, wer was, wie viel und in welcher Weise vertraut.

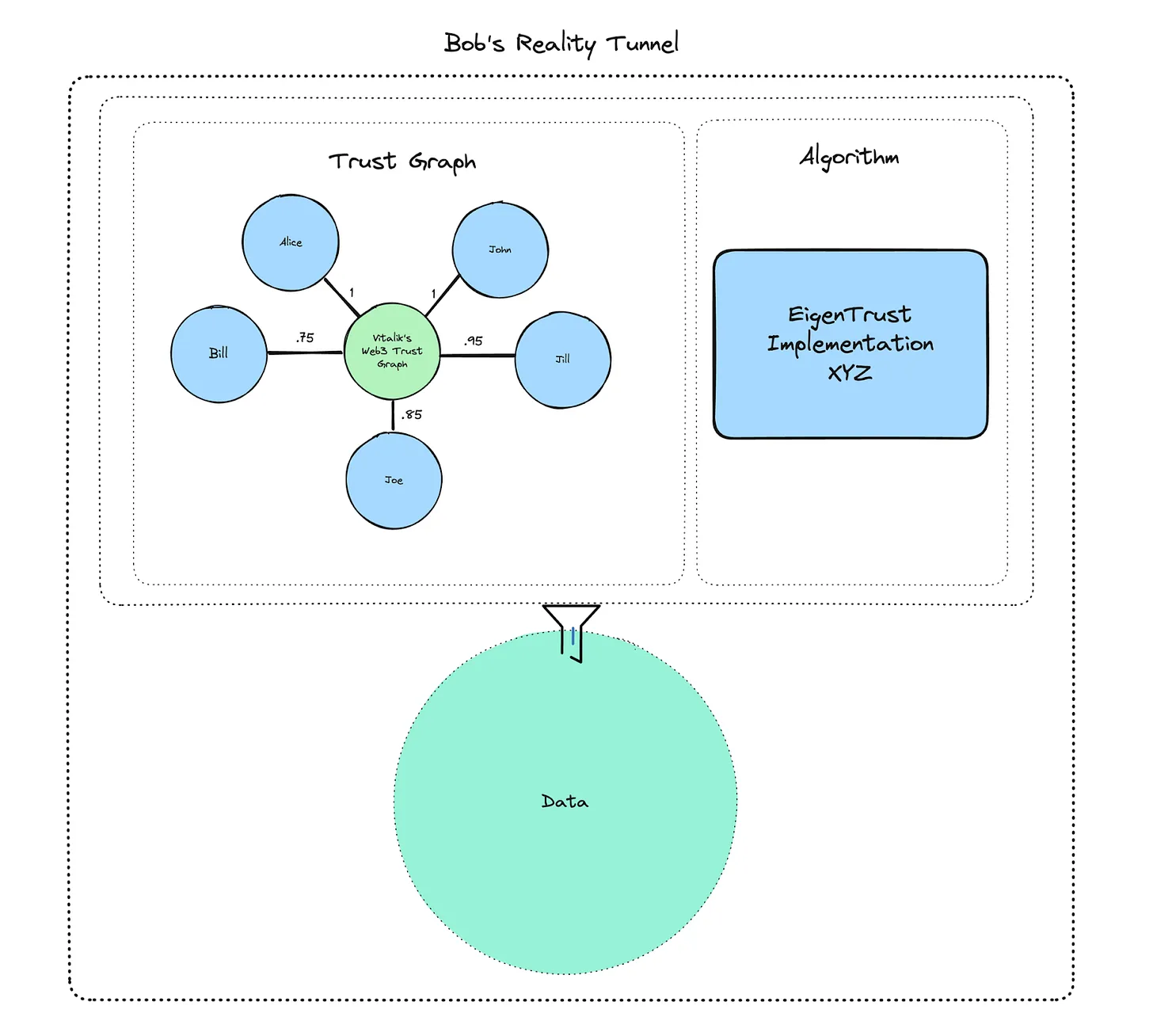

Quelle: Intuition Whitepaper

Intuition bietet dies durch Realitätstunnel (Reality Tunnels). Realitätstunnel bieten eine personalisierte Perspektive, um Daten zu betrachten. Benutzer können Tunnel konfigurieren, die die Bewertungen von Expertengruppen priorisieren, die Meinungen enger Freunde wertschätzen oder die Weisheit bestimmter Gemeinschaften widerspiegeln. Benutzer können vertrauenswürdige Tunnel auswählen oder zwischen mehreren Tunneln wechseln, um Vergleiche anzustellen. Agenten können auch spezifische Interpretationsmethoden für bestimmte Zwecke verwenden. Zum Beispiel wird die Auswahl eines Tunnels, der Vitalik Buterins vertrauenswürdiges Netzwerk widerspiegelt, den Agenten dazu bringen, Informationen und Entscheidungen aus „Vitaliks Perspektive“ zu interpretieren.

Alle Signale werden auf der Kette aufgezeichnet. Benutzer können transparent überprüfen, warum bestimmte Informationen vertrauenswürdig erscheinen, welche Server als Quelle dienen, wer dafür bürgt und wie viele Token eingesetzt wurden. Dieser transparente Vertrauensbildungsprozess ermöglicht es den Benutzern, Beweise direkt zu überprüfen, anstatt Informationen blind zu akzeptieren. Agenten können auch diese Grundlage nutzen, um Urteile zu fällen, die zu individuellen Hintergründen und Perspektiven passen.

4. Was wäre, wenn Intuition die nächste Generation der Netzwerkinfrastruktur wird?

Die Infrastruktur von Intuition ist nicht nur eine konzeptionelle Idee, sondern eine praktische Lösung für die Probleme, mit denen Agenten in der aktuellen Netzwerkumgebung konfrontiert sind.

Das aktuelle Netzwerk ist voller fragmentierter Daten und nicht verifizierter Informationen. Intuition verwandelt Daten in deterministische Wissensgraphen und bietet klare, konsistente Ergebnisse für jede Anfrage. Token-basierte Signale und Kurationsprozesse validieren diese Daten. Agenten können klare Entscheidungen treffen, ohne auf Vermutungen angewiesen zu sein. Dies verbessert gleichzeitig die Genauigkeit, Geschwindigkeit und Effizienz.

Intuition bietet auch die Grundlage für die Zusammenarbeit von Agenten. Standardisierte Datenstrukturen ermöglichen es verschiedenen Agenten, Informationen auf die gleiche Weise zu verstehen und auszutauschen. So wie ERC-20 die Token-Kompatibilität geschaffen hat, schafft die Wissensgraph von Intuition eine Umgebung, in der Agenten auf der Grundlage einheitlicher Daten zusammenarbeiten können.

Intuition geht über die Infrastruktur hinaus, die auf intelligente Agenten beschränkt ist, und wird zur gemeinsamen Basis, die von allen digitalen Diensten genutzt werden kann. Es kann eine einheitliche Basis bereitstellen, die die derzeit von jeder Plattform separat aufgebauten Vertrauen Systeme ersetzt – Amazons Bewertungen, Ubers Bewertungen, LinkedIns Empfehlungen. So wie HTTP einen universellen Kommunikationsstandard für das Internet bietet, bietet Intuition Standardprotokolle für Datenstrukturen und Vertrauensverifizierung.

Die wichtigste Veränderung ist die Datenportabilität. Nutzer besitzen direkt die von ihnen erstellten Daten und können diese überall verwenden. Daten, die isoliert auf verschiedenen Plattformen sind, werden miteinander verbunden und das gesamte digitale Ökosystem neu gestalten.

5. Die Grundlage für die bevorstehende Ära der intelligenten Agenten neu gestalten

Das Ziel von Intuition ist nicht eine einfache technische Verbesserung. Es zielt darauf ab, die in den letzten 20 Jahren angesammelten technischen Schulden zu überwinden und die Netzwerk-Infrastruktur grundlegend neu zu gestalten. Als das semantische Web erstmals vorgeschlagen wurde, war die Vision klar. Aber es fehlte an Anreizen, um die Teilnahme zu fördern. Selbst wenn ihre Vision verwirklicht wird, sind die Vorteile immer noch unklar.

Die Situation hat sich geändert. Die Fortschritte der KI machen das Zeitalter der Agenten zur Realität. KI-Agenten haben sich über einfache Werkzeuge hinaus entwickelt. Sie führen komplexe Aufgaben in unserem Namen aus. Sie treffen autonome Entscheidungen. Sie arbeiten mit anderen Agenten zusammen. Diese Agenten benötigen grundlegende Innovationen der bestehenden Netzwerk-Infrastruktur, um effektiv zu funktionieren.

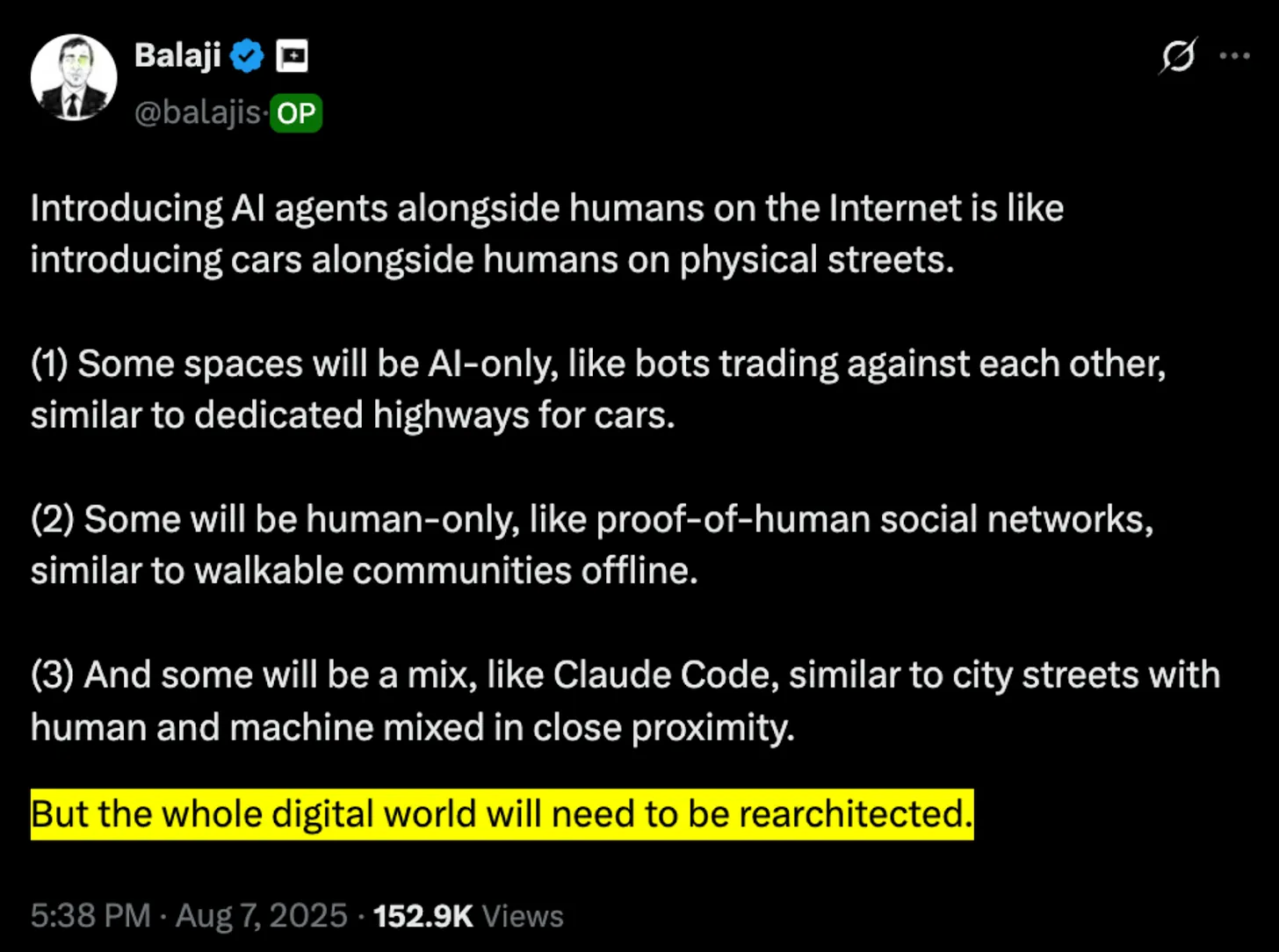

Quelle: Balaji

Wie der ehemalige CTO von Coinbase, Balaji, feststellte, müssen wir die richtige Infrastruktur aufbauen, damit diese Agenten funktionieren können. Das aktuelle Netzwerk ähnelt einer unbefestigten Straße und nicht einer Autobahn, auf der Agenten sicher über vertrauenswürdige Daten fahren können. Jede Website hat eine unterschiedliche Struktur und ein unterschiedliches Format. Informationen sind unzuverlässig. Daten sind weiterhin unstrukturiert, und Agenten haben Schwierigkeiten, sie zu verstehen. Das schafft erhebliche Hindernisse für Agenten, um genaue und effiziente Arbeit zu leisten.

Intuition strebt an, ein Netzwerk zu rekonstruieren, um diese Bedürfnisse zu erfüllen. Es zielt darauf ab, standardisierte Datenstrukturen zu erstellen, die für Agenten leicht verständlich und nutzbar sind. Es benötigt ein zuverlässiges Informationsvalidierungssystem. Es erfordert Protokolle, die eine reibungslose Interaktion zwischen Agenten ermöglichen. Dies ähnelt der Art und Weise, wie HTTP und HTML in den frühen Tagen des Internets Netzwerkstandards geschaffen haben. Es stellt einen Versuch dar, neue Standards für das Zeitalter der Agenten zu etablieren.

Natürlich gibt es weiterhin Herausforderungen. Ohne ausreichende Teilnahme und Netzwerkeffekte kann das System nicht ordnungsgemäß funktionieren. Es erfordert eine beträchtliche Menge an Zeit und Energie, um kritische Masse zu erreichen. Die Überwindung der Inertie des bestehenden Netzwerk-Ökosystems war noch nie einfach. Es gibt Schwierigkeiten beim Aufbau neuer Standards. Aber dies ist eine Herausforderung, die gelöst werden muss. Der von Intuition vorgeschlagene Rebase wird diese Herausforderungen überwinden. Er wird neue Möglichkeiten für das gerade erst beginnende Zeitalter der intelligenten Agenten eröffnen.