Anthropic veröffentlicht Claude Opus 4.7 mit abgeschwächten Cyber-Fähigkeiten

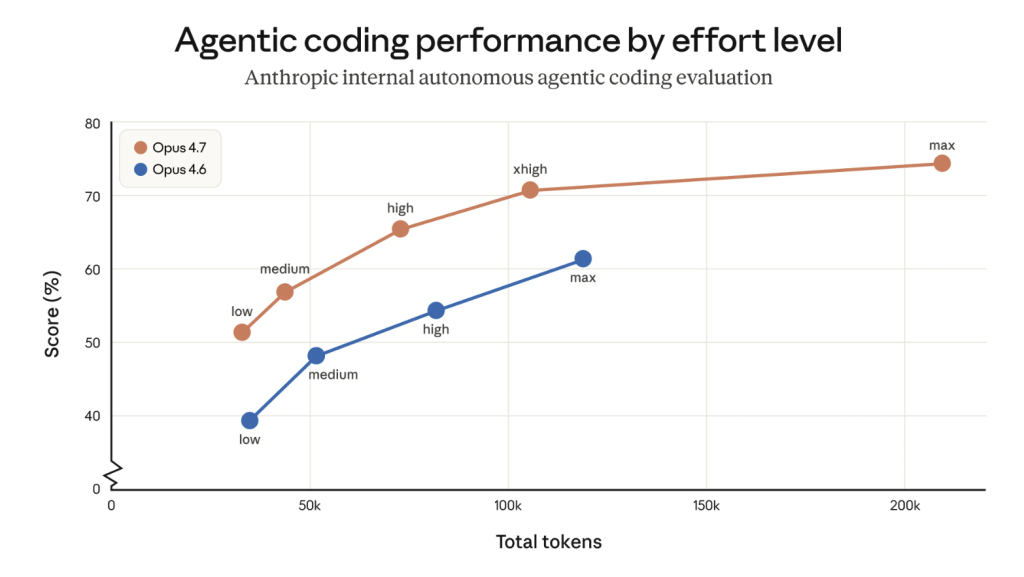

Anthropic hat am 16. April (Ortszeit) eine aktualisierte Version seines Flaggschiff-Modells Claude Opus 4.7 veröffentlicht. Im Vergleich zum vorherigen Opus 4.6-Modell zeigt Opus 4.7 „bedeutende Verbesserungen“ bei fortgeschrittenen Software-Engineering-Fähigkeiten, insbesondere bei anspruchsvollen Aufgaben, mit erhöhter Akribie und Konsistenz in komplexen, langlaufenden Abläufen sowie verbesserten Vision-Fähigkeiten. Allerdings hat Anthropic die Fähigkeiten des Modells zur Cybersecurity-Angriffs- und Verteidigungsrolle während des Trainings gezielt abgeschwächt und Sicherheitsmechanismen eingeführt, um verbotene oder hochriskante Anfragen automatisch zu erkennen und zu blockieren.

Leistung und Benchmarks

Bei Benchmark-Tests erzielte Opus 4.7 im Allgemeinen höhere Werte als das vorherige Opus 4.6 sowie der Wettbewerber GPT-5.4. Dennoch betonte Anthropic, dass die Gesamtkapazitäten von Opus 4.7 nicht mit dem stärksten Modell des Unternehmens, Claude Mythos Preview, mithalten. Laut Anthropic: „Indem wir diese Schutzmechanismen in der realen Welt bereitstellen und betreiben, sammeln wir Erfahrungen, um letztlich eine breitere Veröffentlichung von Modellen auf Mythos-Ebene zu ermöglichen.“

Bereitstellung und Preisgestaltung

Opus 4.7 ist jetzt in allen Claude-Produkten und API-Schnittstellen live und ist in Amazon Bedrock, Google Cloud Vertex AI und Microsoft Foundry-Dienste integriert. Die Preisgestaltung bleibt gegenüber Opus 4.6 unverändert: $5 pro Million Input-Tokens und $25 pro Million Output-Tokens.

Änderungen bei der Token-Nutzung

Zwei Änderungen in Opus 4.7 im Vergleich zu Opus 4.6 werden die Token-Nutzung beeinflussen. Erstens nutzt Opus 4.7 einen aktualisierten Tokenizer, der verbessert, wie das Modell Text verarbeitet. Das bedeutet jedoch, dass identische Eingaben mehr Tokens verbrauchen können – ungefähr 1 bis 1,35-mal so viel wie beim vorherigen Durchlauf.

Zweitens führt Opus 4.7 mehr Reasoning bei höherer „Thinking Intensity“ durch, insbesondere in nachfolgenden Runden bei agentischen Szenarien. Das verbessert die Zuverlässigkeit bei komplexen Problemen, erzeugt aber zusätzliche Output-Tokens.

Marktanalyse und Kontext

Analysten beschreiben Opus 4.7 als ein „Übergangs“-Modell. Der Investmentanalyst Adam Button stellte fest, dass die Veröffentlichung von Opus 4.7 Anthropics Erzählung rund um „gottähnliche Modelle“ wie Mythos untermauert und die Skepsis des Marktes bestätigt: öffentlich verfügbare, bezahlte Modelle sind im Grunde „Lite“-Versionen, die durch Sicherheitsmechanismen eingeschränkt werden.

Unternehmenshintergrund und finanzieller Meilenstein

Anthropic wurde 2021 von ehemaligen OpenAI-Mitarbeitern gegründet und entwickelt die Claude-Serie großer Sprachmodelle. Am 6. April kündigte Anthropic an, dass der annualisierte Umsatz (ARR) $300 Milliarden überstieg, was ein deutlicher Anstieg gegenüber $9 Milliarden zum Ende des Jahres 2025 ist. Das Unternehmen verfolgt aktiv einen Börsengang.

Bedenken hinsichtlich des Cybersecurity-Risikos

Anthropic-Manager haben wiederholt vor dem Einfluss von KI auf die Cybersecurity gewarnt. Laut Berichten vom 10. April (Ortszeit) hielten der US-Finanzminister Yellen und der Vorsitzende der Federal Reserve Powell am 7. April ein Notfalltreffen mit Führungskräften aus der Wall Street ab, um darüber zu beraten, wie das neueste Mythos-KI-Modell von Anthropic die Cybersecurity-Risiken erhöhen könnte. Anthropic hat erklärt, dass Mythos nicht für die öffentliche Veröffentlichung geeignet ist, weil das Modell von Cyberkriminellen und Spionen missbraucht werden könnte. Das Unternehmen gewährt ausgewählten Zugang zu Mythos an führende globale Cybersecurity- und Software-Unternehmen.

Verwandte Artikel

OpenAI-Manager Bill Peebles und Kevin Weil scheiden im Zuge einer Führungsumbildung aus

Zoom arbeitet mit World zusammen, um Deepfake-Erkennung per Gesichtserkennung hinzuzufügen

Cursor erhöht $2B bei $50B -Bewertung, angeführt von Thrive Capital

Iconiq Wealth Manager bereitet sich darauf vor, Milliarden für einen neuen KI-Fonds aufzubringen