Австралийский регулятор отмечает Grok в росте жалоб на злоупотребление изображениями ИИ

1ч назад

Засланные вооружённые люди связали женщину во Франции и украли USB-накопитель с криптовалютой

2ч назад

Популярные темы

Подробнее17.79K Популярность

41.15K Популярность

11.52K Популярность

8.97K Популярность

98.62K Популярность

Горячее на Gate Fun

Подробнее- РК:$0.1Держатели:10.00%

- РК:$3.53KДержатели:10.00%

- РК:$0.1Держатели:10.00%

- РК:$3.53KДержатели:10.00%

- РК:$3.58KДержатели:20.04%

Закрепить

Инсайдеры утверждают, что DeepSeek V4 превзойдет Claude и ChatGPT в программировании, запуск состоится в течение нескольких недель

Вкратце

Сообщается, что DeepSeek планирует выпустить свою модель V4 примерно к середине февраля, и если внутренние тесты что-то показывают, гиганты ИИ из Кремниевой долины должны нервничать. Ханчжоуский стартап в области ИИ, по данным The Information, может ориентироваться на релиз около 17 февраля — естественно, в Лунный Новый год — с моделью, специально разработанной для задач кодирования. Люди, обладающие прямыми знаниями о проекте, утверждают, что V4 превосходит как Claude от Anthropic, так и серию GPT от OpenAI в внутренних бенчмарках, особенно при работе с очень длинными кодовыми подсказками. Конечно, ни один бенчмарк или информация о модели публично не опубликованы, поэтому невозможно прямо подтвердить такие утверждения. DeepSeek также не подтверждал слухи.

Тем не менее, сообщество разработчиков не ждет официальных заявлений. Reddit-ы r/DeepSeek и r/LocalLLaMA уже разогреваются, пользователи запасаются API-кредитами, а энтузиасты на X быстро делятся своими прогнозами, что V4 может закрепить за DeepSeek статус дерзкого аутсайдера, который отказывается играть по миллиардным правилам Кремниевой долины.

Это не будет первым прорывом DeepSeek. Когда компания выпустила свою модель рассуждения R1 в январе 2025 года, это вызвало глобальную распродажу на сумму $1 триллион. Причина? Модель DeepSeek R1 совпадала с моделью o1 от OpenAI по математическим и логическим бенчмаркам, несмотря на то, что, по сообщениям, стоила всего $6 миллион на разработку — примерно в 68 раз дешевле, чем тратили конкуренты. Позже модель V3 достигла 90.2% по бенчмарку MATH-500, опередив Claude с 78.3%, а недавнее обновление “V3.2 Speciale” улучшило её показатели ещё больше.

Изображение: DeepSeek

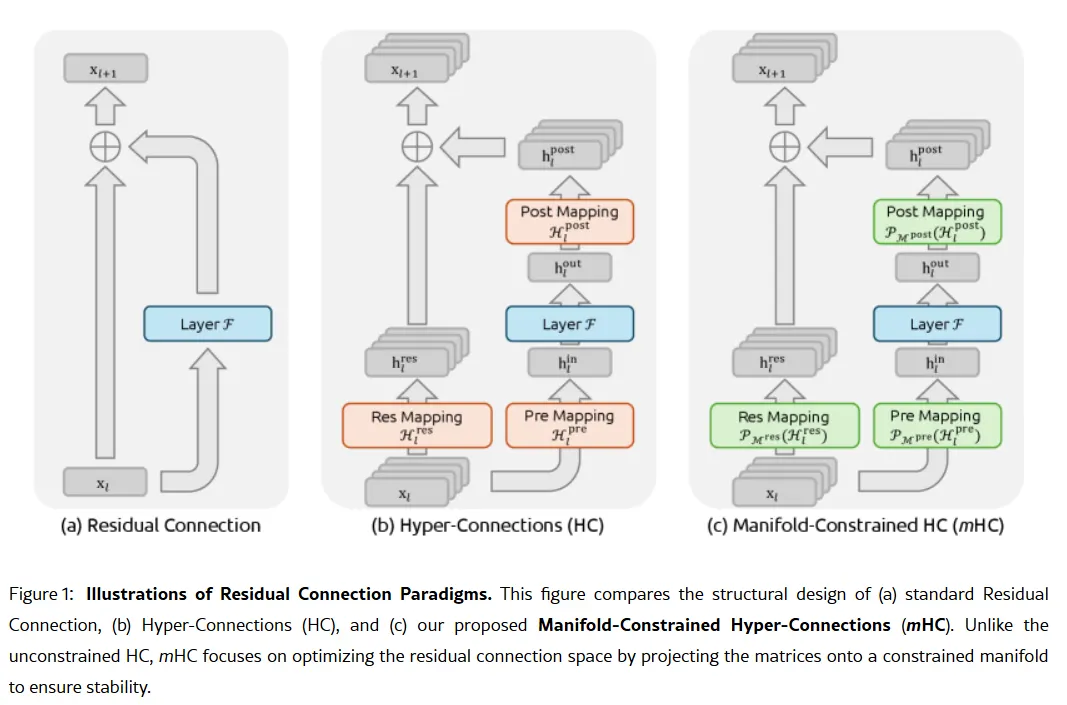

Фокус V4 на кодировании станет стратегическим поворотом. В то время как R1 делал упор на чистое рассуждение — логику, математику, формальные доказательства — V4 представляет собой гибридную модель (рассуждение и нерассуждающие задачи), ориентированную на корпоративный рынок разработчиков, где высокая точность генерации кода напрямую переводится в доход. Чтобы занять доминирующее положение, V4 нужно превзойти Claude Opus 4.5, который в настоящее время держит рекорд SWE-bench Verified с 80.9%. Но если судить по прошлым запускам DeepSeek, то даже при всех ограничениях, с которыми сталкивается китайская лаборатория ИИ, это может быть достижимо. Не так секретный секрет Если слухи правдивы, как эта небольшая лаборатория может добиться такого результата? Секретным оружием компании может стать её исследовательская статья от 1 января: Manifold-Constrained Hyper-Connections, или mHC. Совместно с основателем Лян Вэнфэнгом, новый метод обучения решает фундаментальную проблему масштабирования больших языковых моделей — как расширить ёмкость модели, не делая её нестабильной или не вызывая взрыв during обучения. Традиционные архитектуры ИИ заставляют всю информацию проходить через один узкий канал. mHC расширяет этот канал в несколько потоков, которые могут обмениваться информацией без риска краха обучения.

Изображение: DeepSeek

Вэй Су, главный аналитик по ИИ в Counterpoint Research, назвала mHC «поразительным прорывом» в комментариях Business Insider. По её словам, эта техника показывает, что DeepSeek может «обойти узкие места вычислений и открыть скачки в интеллекте», даже при ограниченном доступе к передовым чипам из-за экспортных ограничений США. Лян Цзе Су, главный аналитик в Omdia, отметил, что готовность DeepSeek публиковать свои методы свидетельствует о «новообретённой уверенности в китайской индустрии ИИ». Открытый подход компании сделал её любимицей среди разработчиков, которые видят в ней воплощение того, чем раньше была OpenAI, прежде чем она переключилась на закрытые модели и раунды сбора миллиардных инвестиций.

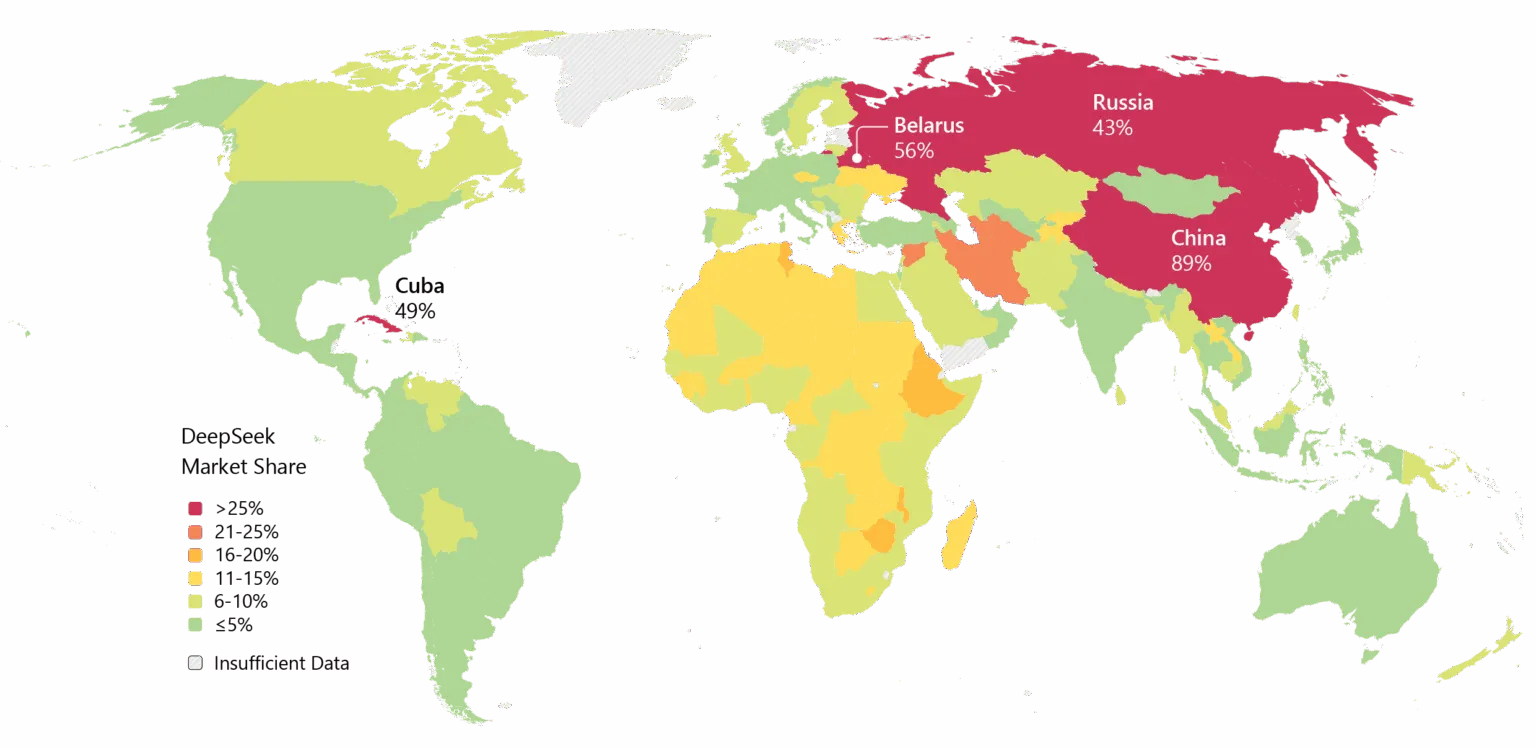

Не все убеждены. Некоторые разработчики на Reddit жалуются, что модели рассуждения DeepSeek тратят вычисления на простые задачи, в то время как критики утверждают, что бенчмарки компании не отражают реальную сложность мира. Один пост на Medium под названием “DeepSeek отстой — и я больше не pretend, что это не так” стал вирусным в апреле 2025 года, обвиняя модели в создании «стандартной ерунды с багами» и «галлюцинированных библиотек». У DeepSeek также есть свои проблемы. Вопросы конфиденциальности преследовали компанию, некоторые правительства запретили нативное приложение DeepSeek. Связи компании с Китаем и вопросы цензуры в её моделях добавляют геополитическую напряжённость в технические дебаты. Тем не менее, динамика очевидна. DeepSeek широко используется в Азии, и если V4 оправдает свои обещания в области кодирования, то внедрение в бизнесе на Западе может последовать.

Изображение: Microsoft

Также важен тайминг. Согласно Reuters, изначально DeepSeek планировал выпустить модель R2 в мае 2025 года, но продлил сроки после того, как основатель Лян был недоволен её производительностью. Сейчас, с предполагаемым выходом V4 в феврале и возможным запуском R2 в августе, компания движется с такой скоростью, которая говорит либо об срочности, либо о уверенности. Возможно, и то, и другое.