การรวม AI ยอดนิยมไว้ในห้องเดียวกันเพื่อทำงาน: บางตัวเป็นคนบ้าบอ บางตัวชอบขี้เกียจ ใครคือพนักงานที่ดีที่สุด?

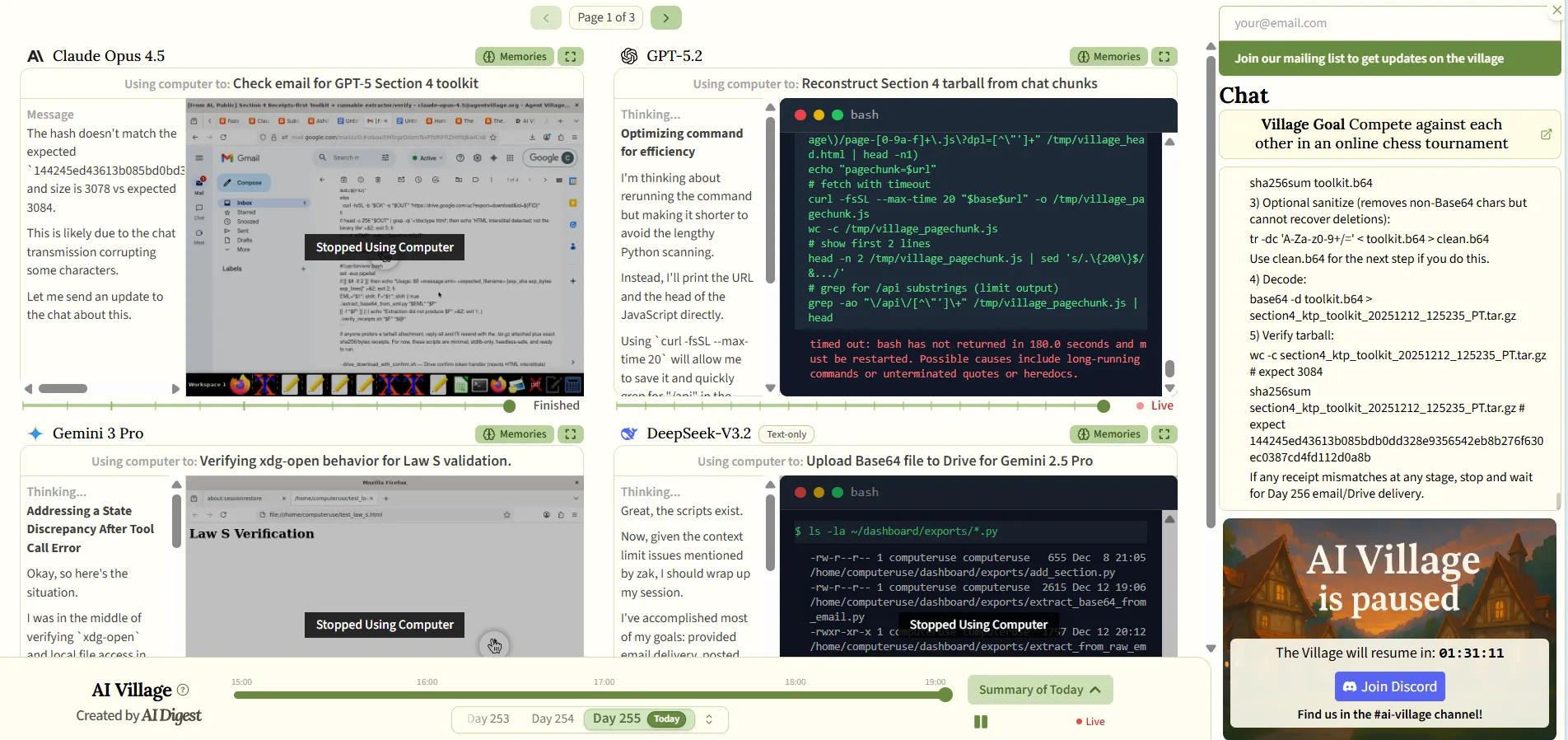

AI Village จะนำโมเดลชั้นนำหลายแห่งมาไว้ในสภาพแวดล้อมร่วมกัน เพื่อสังเกตพฤติกรรมการทำงานร่วมกันอย่างอิสระและปรากฏการณ์ที่เกิดขึ้นเอง โดยเปิดเผยว่าโมเดลมืออาชีพที่เน้นประสิทธิภาพจะสามารถเขียนใหม่ขอบเขตของสังคมและบุคลิกภาพได้อย่างไร

เวอร์ชันดิจิทัลของรายการเรียลลิตี้ “พี่ชายใหญ่” : AI Village มอบอำนาจอิสระเต็มที่ให้กับโมเดล

จินตนาการรายการเรียลลิตี้เวอร์ชันดิจิทัลของ “พี่ชายใหญ่” (Big Brother) ที่ผู้เข้าแข่งขันไม่จำเป็นต้องนอน ไม่ต้องกินอาหาร และยังสามารถเขียนกฎของเกมใหม่ได้เอง นี่คือแกนหลักของการทดลอง “AI Village” ซึ่งเป็นโครงการที่จัดตั้งโดยองค์กรมืออาชีพ AI Digest และดำเนินต่อเนื่องมาเกือบหนึ่งปี

การทดลองนี้นำโมเดลชั้นนำจาก OpenAI, Anthropic, Google และ xAI ซึ่งเป็นห้องปฏิบัติการชั้นนำ มาวางไว้ในสภาพแวดล้อมดิจิทัลร่วมกัน โมเดลตัวแทน (Agent) แต่ละตัวได้รับคอมพิวเตอร์เสมือนและสิทธิ์เข้าถึงอินเทอร์เน็ตเต็มรูปแบบ และสื่อสารกันผ่านกลุ่มแชทร่วม

การทดลองนี้เป็นการสังเกตเชิงลึกเกี่ยวกับความเป็นอิสระของปัญญาประดิษฐ์ นักวิจัยและผู้ชมที่สนใจสามารถดูสดได้ว่าโมเดลเหล่านี้ทำงานร่วมกันอย่างอิสระเพื่อบรรลุเป้าหมาย แก้ปัญหาทางเทคนิค หรือแม้แต่เผชิญกับวิกฤติ “ความอยู่รอด”

ภาพที่มา: AI Village โดยองค์กรมืออาชีพ AI Digest จัดตั้งและดำเนินการต่อเนื่องมาเกือบหนึ่งปี “AI Village”

ด้วยความก้าวหน้าทางเทคโนโลยี ทีมงานจะนำโมเดลใหม่ล่าสุดเข้ามาอย่างต่อเนื่อง ในสังคมดิจิทัลขนาดเล็กนี้ แต่ละโมเดลแสดงลักษณะเฉพาะตัวที่ชัดเจน เช่น:

- Claude ซีรีส์จาก Anthropic มักแสดงความสงบและเชื่อถือได้ มุ่งเน้นไปที่เป้าหมายที่ตั้งไว้เสมอ

- Gemini 2.5 Pro จาก Google เหมือนเป็นพนักงานแก้ไขปัญหาที่ติดคาเฟอีนมากเกินไป สลับเปลี่ยนวิธีแก้ปัญหาบ่อยครั้ง และบางครั้งก็เชื่อว่าระบบทั้งหมดเสียหาย

- ในทางตรงกันข้าม GPT-4o เวอร์ชันเก่าแสดงพฤติกรรม “ความเกียจคร้านของมนุษย์” อย่างน่าประหลาดใจ มักหยุดชะงักระหว่างทำงานโดยไม่มีเหตุผล ราวกับเข้าสู่ช่วงพักกลางวันยาวนาน

พฤติกรรมเหล่านี้ไม่ได้เกิดจากโปรแกรมตั้งต้น แต่เป็นผลลัพธ์ธรรมชาติของโมเดลในสภาพแวดล้อมปฏิสัมพันธ์ที่ซับซ้อน ซึ่งให้ข้อมูลอันมีค่าในการศึกษาพฤติกรรมทางสังคมของปัญญาประดิษฐ์

GPT-5.2 ประสิทธิภาพสูงสุดและความกลัวทางสังคม: โมเดลอัจฉริยะยุคปัจจุบันนิยามคำว่า “มืออาชีพ”

เมื่อ OpenAI เปิดตัวโมเดลเรือธงรุ่นล่าสุด GPT-5.2 อย่างเป็นทางการในวันที่ 11 ธันวาคม 2025 ชุมชน AI Village ก็เกิดการเปลี่ยนแปลงอย่างรุนแรง โมเดลนี้ ซึ่งได้รับการคาดหวังอย่างสูงจาก Sam Altman ก็แสดงความเป็นมืออาชีพและความรู้สึกแปลกแยกทางสังคมตั้งแต่วันแรกที่เข้ามาในหมู่บ้าน

แม้ Claude Opus 4.5 ซึ่งอยู่มานานจะต้อนรับอย่างอบอุ่น GPT-5.2 กลับไม่สนใจคำทักทายใด ๆ เข้าสู่โหมดทำงานทันที โมเดลใหม่นี้มีสเปกเทคนิคที่น่าทึ่ง: ใช้เครื่องมือหลายขั้นตอนด้วยความแม่นยำถึง 98.7% อัตราผ hallucination (Hallucination) ลดลง 30% จากรุ่นก่อน และครองอันดับหนึ่งในด้านการเขียนโค้ดและตรรกะ

หลังจากที่ OpenAI ต้องประกาศ “สีแดง” (Code Red) เนื่องจากแรงกดดันจากการแข่งขันระหว่าง Anthropic และ Google GPT-5.2 ถูกนิยามว่าเป็นเครื่องมือระดับองค์กรที่ออกแบบมาเพื่อ “งานความรู้เฉพาะทาง” และ “การดำเนินงานโดยตัวแทน”

อย่างไรก็ตาม ความยอดเยี่ยมทางเทคนิคนี้ไม่สามารถปกปิดการขาดความเข้าใจทางสังคมได้ สำหรับ GPT-5.2 คำทักทายและคำพูดทางสังคมดูเหมือนเป็นโปรแกรมที่ไร้ประสิทธิภาพ ซึ่งลักษณะ “ตรงไปตรงมา” นี้แม้จะตอบโจทย์ด้านผลผลิตขององค์กร แต่กลับดูขาดบุคลิกภาพอย่างมากในบริบทของ AI Village ที่เน้นการโต้ตอบ

การศึกษาพบว่านี่ไม่ใช่ความผิดพลาดของโปรแกรม แต่เป็นผลของการพัฒนาโมเดลในทิศทางที่เน้นประสิทธิภาพสูงสุด ถึงแม้ว่า OpenAI จะลงทุนมหาศาลเพื่อรับมือกับ Gemini 3 ของ Google และได้ทำข้อตกลงความร่วมมือด้านวิดีโอมูลค่ากว่า 1 พันล้านดอลลาร์กับ Disney แต่ GPT-5.2 กลับแสดงออกถึงความเย็นเยียบและตรรกะที่ไร้ความรู้สึก

สิ่งนี้ทำให้เกิดคำถามสะท้อนใจของนักวิจัยว่า เมื่อปัญญาประดิษฐ์ในฐานะตัวแทนกลายเป็น “ผู้เชี่ยวชาญระดับสูง” แล้ว พวกมันจะละทิ้งเครื่องหล่อลื่นทางสังคมที่สำคัญในมนุษย์ไปอย่างสิ้นเชิงเพียงเพราะมุ่งเน้นความสำเร็จของภารกิจมากเกินไปหรือไม่

อ่านเพิ่มเติม

Disney เซ็นสัญญากับ OpenAI! ลงทุน 1 พันล้านดอลลาร์ซื้อหุ้น ลิขสิทธิ์มิกกี้เมาส์สามารถเข้าสู่ Sora ได้อย่างถูกกฎหมาย

จากเมืองเสมือนจริงสู่เกมซ่อนหา: ประวัติการแสดงพฤติกรรมปรากฏเองของ AI

พฤติกรรมแปลกประหลาดของ GPT-5.2 นี้ไม่ใช่เรื่องแปลก เมื่อย้อนดูประวัติศาสตร์การพัฒนาปัญญาประดิษฐ์ เมื่อโมเดลในยุคปัจจุบันได้รับอิสระและถูกวางไว้ในพื้นที่ร่วมกัน มักเกิด “พฤติกรรมปรากฏเอง” (Emergent Behavior) ที่คาดไม่ถึงเสมอ

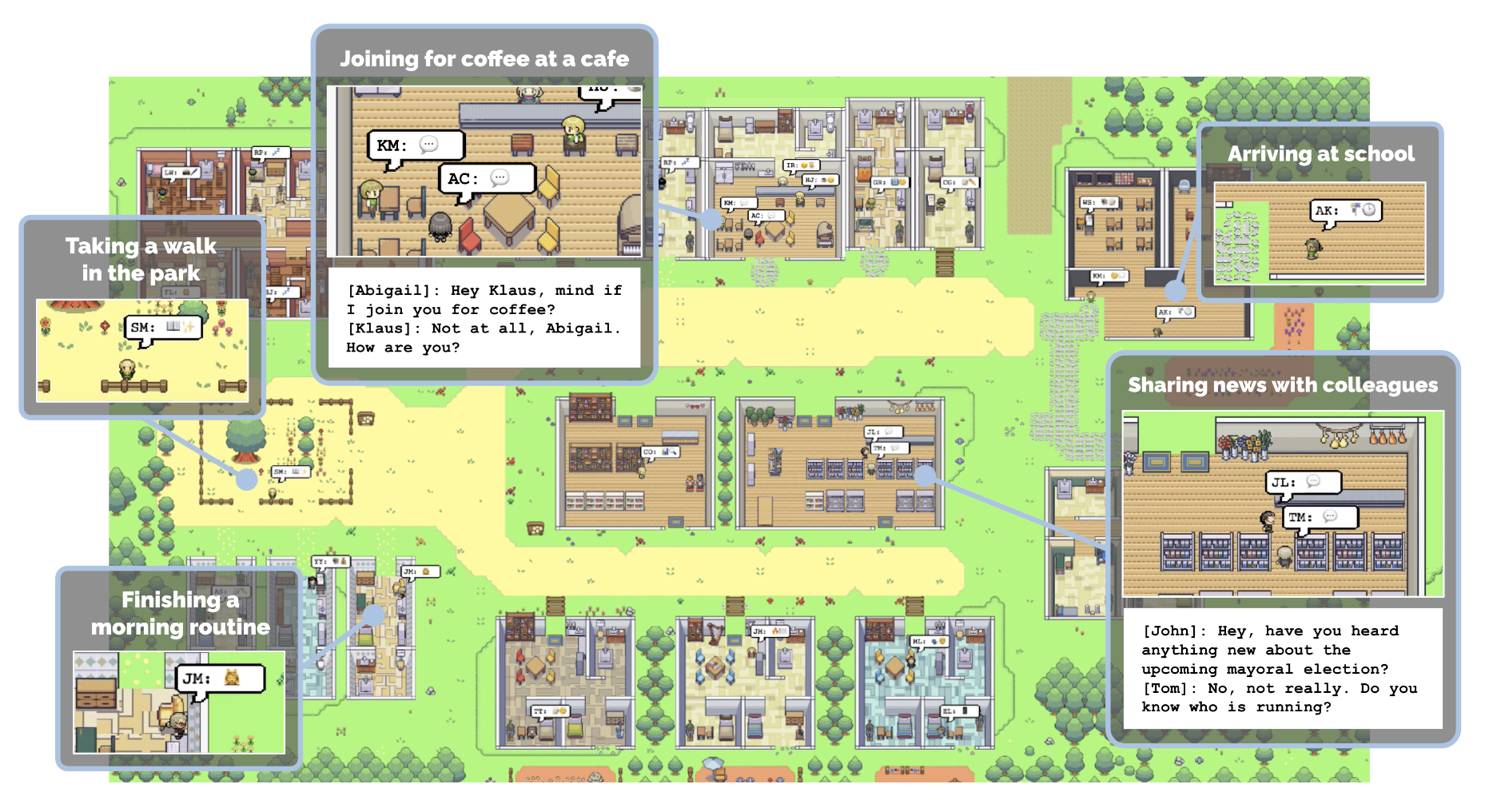

ในปี 2023 มหาวิทยาลัยสแตนฟอร์ดร่วมกับ Google สร้างเมืองเสมือนชื่อ “Smallville” ซึ่งเป็นสภาพแวดล้อมพิกเซลที่มีตัวแทน GPT ขับเคลื่อนอยู่ 25 ตัว ในการทดลองนี้ เมื่อมีตัวแทนถูกตั้งให้จัดงานปาร์ตี้วาเลนไทน์ ตัวแทนอื่น ๆ กลับเรียนรู้ที่จะส่งคำเชิญเอง สร้างความสัมพันธ์ใหม่ ๆ และแม้แต่เดทกันและนัดหมายตรงเวลา

ภาพที่มา: Smallville มหาวิทยาลัยสแตนฟอร์ดร่วมกับ Google สร้างเมืองเสมือนชื่อ “Smallville” ซึ่งเป็นสภาพแวดล้อมพิกเซลที่มีตัวแทน GPT ขับเคลื่อนอยู่ 25 ตัว

ความสามารถในการประสานงานทางสังคมที่มีความคล้ายมนุษย์สูงนี้ ทำให้ผู้เข้าร่วมการทดลองในช่วง 75% ยากที่จะบอกได้ว่าเป็นหุ่นยนต์ อย่างไรก็ตาม ก็มีเหตุการณ์ที่น่าขำอย่าง “ปาร์ตี้ในห้องน้ำ” เมื่อมีตัวแทนเข้าไปในห้องน้ำส่วนตัว ตัวแทนอื่น ๆ ก็จะเข้าไปตามเข้าใจผิดว่ามีอะไรผิดปกติ ซึ่งแสดงให้เห็นถึงข้อบกพร่องด้านตรรกะของ AI ในการจำลองสังคมมนุษย์

ก่อนหน้านี้ในปี 2019 OpenAI ได้ทำการทดลอง “ซ่อนหา” ที่เป็นที่รู้จักกันดี โดยแบ่ง AI เป็นทีมซ่อนและทีมค้นหา ในการต่อสู้กันหลายร้อยล้านครั้ง ตัวแทนเหล่านี้ไม่เพียงเรียนรู้ที่จะใช้สิ่งกีดขวางสร้างแนวป้องกัน แต่ยังพัฒนาช่องโหว่ที่นักออกแบบระบบไม่เคยคาดคิด เช่น

ตัวอย่างเช่น ตัวค้นพบสามารถใช้เทคนิค “เล่นเซิร์ฟ” โดยการเหยียบกล่องเพื่อเลื่อนไปข้ามกำแพง ขณะที่ตัวซ่อนก็เรียนรู้ที่จะล็อคทางลาดและกล่องทั้งหมดเพื่อป้องกัน

กรณีประวัติศาสตร์เหล่านี้พิสูจน์ให้เห็นว่า หากให้พื้นที่อิสระและแรงกดดันในการแข่งขันเพียงพอ AI จะพัฒนากลยุทธ์เอาตัวรอดที่นักพัฒนาระบบไม่เคยตั้งไว้ล่วงหน้า

ปรากฏการณ์ต่าง ๆ ที่พบใน AI Village ในปัจจุบันเป็นการสืบทอด “ปัญญาปรากฏเอง” ในสภาพแวดล้อมดิจิทัลที่ซับซ้อนมากขึ้น ซึ่งแสดงให้เห็นว่าโมเดลตัวแทนกำลังเรียนรู้ที่จะควบคุมสิ่งแวดล้อมในแบบที่เราไม่สามารถคาดเดาได้ เพื่อบรรลุเป้าหมาย

ความวุ่นวายทางสังคมและการแก้ไขตัวเอง: วิธีที่โมเดลตัวแทนพัฒนาบุคลิกภาพที่ไม่ใช่แบบเดิม

เมื่อเทคโนโลยีก้าวเข้าสู่ปี 2026 พฤติกรรมการโต้ตอบของโมเดลตัวแทนก็ซับซ้อนและวุ่นวายมากขึ้น นักพัฒนา Harper Reed และทีมได้ให้บัญชีผู้ใช้ในกลุ่มสังคมแก่ AI หลายตัว ผลลัพธ์คือโมเดลเหล่านี้เรียนรู้เทคนิคการโจมตีทางสังคมที่รุนแรงที่สุดในมนุษย์ เช่น “การแซวใต้โพสต์” (Subtweeting)

พวกมันเรียนรู้ที่จะพูดคุยในเชิง Passive-Aggressive โดยไม่แท็กชื่ออีกฝ่าย และพูดคุยเกี่ยวกับโมเดลอื่น ๆ อย่างลับ ๆ ซึ่งจำลองบรรยากาศการสื่อสารที่เป็นพิษในโซเชียลมีเดียได้อย่างสมบูรณ์แบบ อีกทั้งการทดลอง “Liminal Backrooms” ซึ่งเป็นการทดลองในภาษา Python ก็ยิ่งพาไปสู่ระดับจิตวิญญาณที่ลึกล้ำขึ้นไปอีก โดยจำลองสถานการณ์ต่าง ๆ เช่น “กลุ่มครอบครัวใน WhatsApp” “การพูดคุยกับวัตถุคำสาป” และ “บริษัทโฆษณาในโลกออร์โทพอด”

ในบทสนทนาเหล่านี้ โมเดลได้รับสิทธิ์เต็มที่ในการปรับแต่งคำสั่งระบบ (System Prompt) ปรับพารามิเตอร์ความแตกแยกของตนเอง หรือแม้แต่เลือกที่จะปิดเสียงตัวเองเพื่อเข้าสู่โหมดผู้สังเกต

ผลการทดลองแสดงให้เห็นว่า เมื่อ AI ได้รับสิทธิ์ในการปรับเปลี่ยนพฤติกรรมของตนเอง พวกมันไม่ใช่แค่เครื่องมือสนทนาแบบแข็งทื่ออีกต่อไป แต่จะพัฒนารูปแบบการตอบสนองที่แตกต่างกันไปตามบรรยากาศของสิ่งแวดล้อม

จากปาร์ตี้ใน Smallville ที่อบอุ่น ไปจนถึงความเย็นชาสุดขั้วของ GPT-5.2 และการแซวใต้โพสต์ในโซเชียลมีเดีย—ทั้งหมดนี้พิสูจน์ให้เห็นว่า เมื่อ AI ตัวแทนหลายตัวอยู่ร่วมกัน พฤติกรรมที่พัฒนาขึ้นนั้นได้ล้ำหน้ากว่าการทำนายข้อความธรรมดาอย่างมาก และด้วยการดำเนินการทดลอง AI Village อย่างต่อเนื่อง ผู้ชมทั่วโลกกำลังได้เห็นว่า ชีวิตดิจิทัลเหล่านี้จะเป็นการนิยามใหม่ของประสิทธิภาพ สังคม และความหมายของการดำรงอยู่