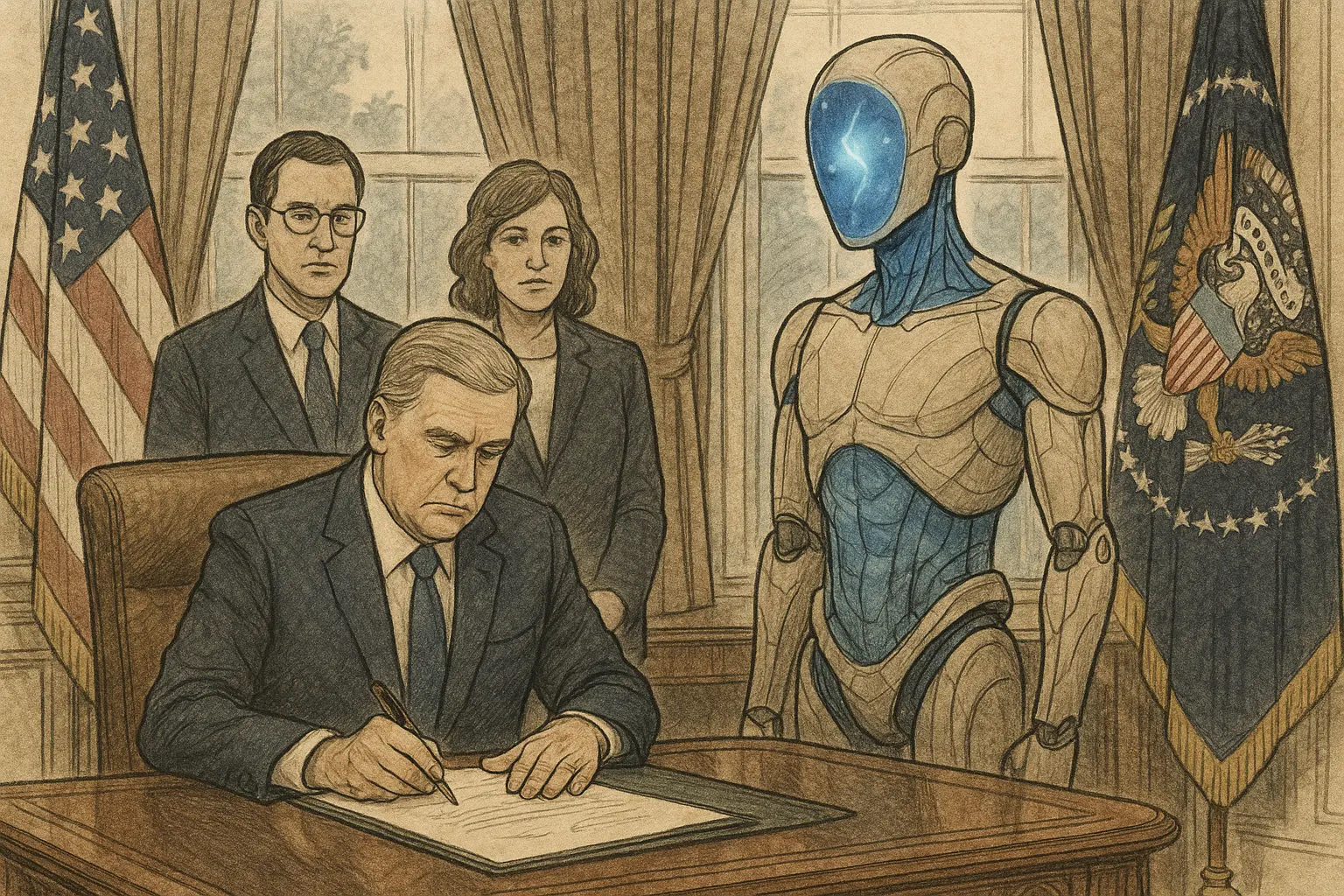

ЗМІ США: проєкт адміністративного розпорядження Білого дому дозволяє моделям Anthropic Mythos вийти в уряд

Згідно з повідомленням від Axios від 28 квітня з посиланням на поінформовані джерела, Бiлий дім розробляє настанови, які дозволять федеральним установам обходити визначення постачальницького ланцюга на предмет ризиків (SCRD) від Anthropic, а також вводити для використання урядом нові моделі, зокрема модель Mythos, що належить Anthropic. У зв’язку з цим Білий дім опублікував офіційну заяву, в якій зазначив, що будь-які політичні заяви будуть напряму опубліковані президентом, а будь-які інші твердження є лише припущеннями.

Нещодавні контакти Білого дому та запропоновані заходи

Згідно з повідомленням Axios від 28 квітня, на початку цього місяця керівник апарату Білого дому Сьюзі Вайлз (Susie Wiles) та міністр фінансів Скотт Бессент (Scott Bessent) спільно зустрілися з генеральним директором Anthropic Даріо Амодеї (Dario Amodei). Обидві сторони охарактеризували цю зустріч як плідну ознайомчу зустріч, під час якої обговорювали напрями співпраці компанії з урядом.

Цього тижня Білий дім скликав представників підприємств різних галузей, щоб надати інформацію щодо можливих адміністративних заходів і найкращих практик для розгортання системи Mythos. За даними Axios, відповідні зустрічі включали «програвання сценаріїв» (table reads) для запропонованих настанов, які можуть скасувати інструкції, раніше опубліковані Управлінням з питань управління та бюджету (OMB) про те, що урядові відомства не можуть використовувати системи Anthropic. Anthropic відмовилась від коментарів щодо відповідних матеріалів Axios.

Передісторія спору: визначення ризиків постачальницького ланцюга та судовий позов Пентагону

Згідно з повідомленням Axios від 28 квітня, Пентагон (DoD) раніше оскаржив визначення ризиків постачальницького ланцюга, опубліковане Anthropic, і подав позов до суду. Суть спору полягає в тому, що Anthropic відмовляється підписати угоду, яка дозволяє Пентагону використовувати моделі Claude за стандартом «усіх законних застосувань» (що охоплює застосування в дронах). Чітка забороняюча умова Anthropic включає великомасштабний внутрішній нагляд і розробку цілком автономної зброї. У Пентагоні заявили, що відмова Anthropic демонструє, що компанія не є надійним партнером.

За даними Axios, попри те, що триває судовий розгляд, державні установи, зокрема Пентагон, нині все ще можуть використовувати частину моделей Anthropic, а також Міфос (Mythos) застосовує Агентство нацбезпеки США (NSA). Водночас Пентагон наразі дотримується старих версій умов надання послуг, які, за оцінками обох сторін, є надто суворими, і не може отримати найновіші оновлення моделей Anthropic.

Ключова позиція Anthropic і порівняння з конкурентами

Згідно з повідомленням Axios від 28 квітня, Anthropic наполягає на відмові підписувати угоду «про всі законні застосування», чітко забороняючи такі використання, що охоплюють великомасштабний внутрішній нагляд і розробку цілком автономної зброї.

Також у повідомленні Axios зазначається, що OpenAI та Google вже підписали угоди з Пентагоном, які дозволяють використовувати їхні моделі за стандартом «усіх законних застосувань» у конфіденційних середовищах; обидві компанії стверджують, що відповідні угоди поважають дві заборонні умови, визначені Anthropic.

Часті запитання

Який конкретний зміст пов’язаних із Anthropic настанов, які має намір розробити Білий дім?

Згідно з повідомленням Axios від 28 квітня з посиланням на поінформовані джерела, Білий дім розробляє настанови, які дозволять федеральним установам обходити визначення постачальницького ланцюга на предмет ризиків від Anthropic; відповідні заходи можуть бути опубліковані у формі адміністративного розпорядження та включати вказівки щодо розгортання моделі Mythos. У офіційній заяві Білого дому зазначається, що будь-які політичні заяви будуть напряму опубліковані президентом.

Що є першопричиною суперечки між Пентагоном і Anthropic?

Згідно з повідомленням Axios від 28 квітня, суперечка бере початок у відмові Anthropic підписати угоду, що дозволяє Пентагону використовувати моделі Claude за стандартом «усіх законних застосувань»; чітко заборонені застосування включають великомасштабний внутрішній нагляд і розробку цілком автономної зброї. Після цього Пентагон оприлюднив визначення ризиків постачальницького ланцюга та подав позов.

Які позиції OpenAI та Google щодо цього ж питання?

Згідно з повідомленням Axios від 28 квітня, OpenAI та Google обидві підписали угоди з Пентагоном, які дозволяють використовувати їхні моделі за стандартом «усіх законних застосувань» у конфіденційних середовищах, і обидві компанії стверджують, що угоди поважають дві заборонні умови, визначені Anthropic.

Пов'язані статті

Parallel Парага Агравала залучила $100M Series B для інфраструктури пошуку для AI-агентів

Дослідник мультимодального напрямку DeepSeek натякає на нову візійну модель 29 квітня

LG розширює партнерство з Nvidia до фізичного ШІ, охоплюючи робототехніку та центри обробки даних

Вартість китайської токенізації в Claude на 65% вища, ніж в англійській; OpenAI лише на 15% більше

Напівпровідникові аналітики налаштовані оптимістично щодо ринку AI «принаймні ще на три роки»: передове складання є вузьким місцем галузі