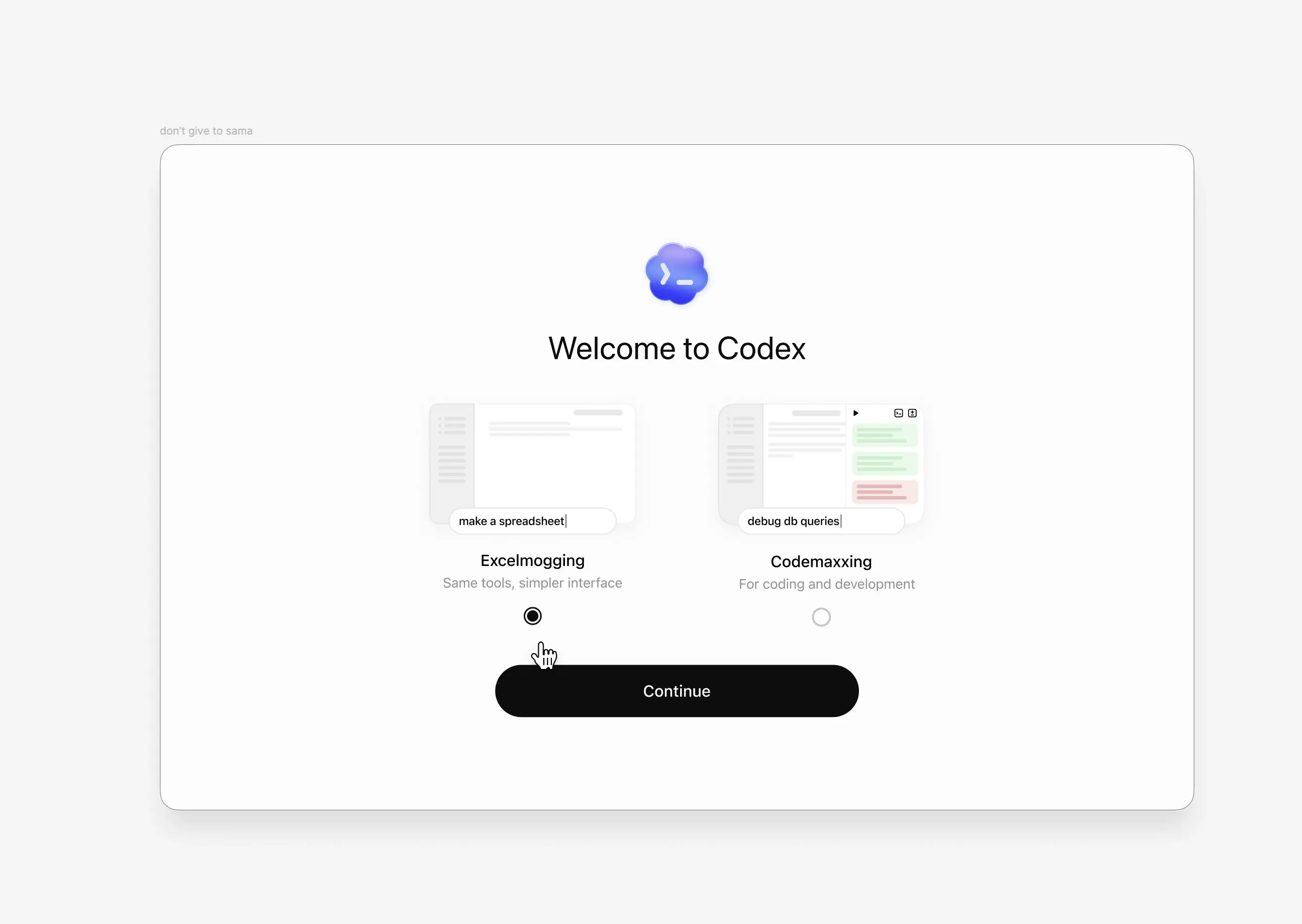

Der Screenshot und die Erklärung, die OpenAI-CEO Sam Altman am 29. April auf der X-Plattform veröffentlicht hat: Codex bringt eine neue Version der Einführungsoberfläche heraus. Wenn Nutzer zum ersten Mal eintreten, müssen sie aus zwei Modi wählen, nämlich Excelmogging und Codemaxxing. Die derzeit über 4 Millionen wöchentlich aktiven Nutzer von Codex haben sich die Anwendungsfälle von der Codegenerierung hin zu nicht-technischen Einsatzszenarien erweitert.

Codex neue Benutzeroberfläche: Zweimodus-Design

(Quelle: Sam Altman X)

Laut dem von Sam Altman auf X veröffentlichten Screenshot leitet die neue Codex-Einführungsoberfläche Nutzer auf zwei Wege auf. Der „Excelmogging“-Modus verwendet ein schlankeres Interaktionsdesign und richtet sich an Nicht-Programmierer für alltägliche Büroszenarien; der „Codemaxxing“-Modus behält das bisherige, auf Codegenerierung und Engineering-Aufgaben fokussierte Design bei und richtet sich an professionelle Entwickler.

Sam Altman sagte außerdem in einem weiteren Beitrag auf X: „Ich stelle auf polyphasischen Schlaf um, weil das GPT-5.5 in Codex so herausragend ist, dass ich nicht lange schlafen kann und damit die Arbeit verzögere.“

OpenAI und NVIDIA kooperieren bei der Bereitstellung von Codex

Laut Sam Altmans öffentlicher Erklärung auf der X-Plattform arbeitet OpenAI mit NVIDIA zusammen, um Codex im gesamten Unternehmen bereitzustellen. Altman sagte: „Wir arbeiten mit NVIDIA zusammen, um es auf eine ganz neue Art zu versuchen, Codex im gesamten Unternehmen bekannt zu machen. Zu sehen, dass es erfolgreich läuft, ist wirklich großartig.“

Laut der öffentlichen Vorstellung von NVIDIA haben NVIDIA-Ingenieure seit mehreren Wochen Codex-Anwendungen eingesetzt, die mit GPT-5.5 ausgestattet sind, und berichten von einer erheblichen Steigerung der Produktivität; die Bereitstellung im Rahmen dieser Zusammenarbeit basiert auf der NVIDIA GB200 NVL72 Rack-Scale-Architektur.

Branchentrend: Programmier-agenten wechseln zu einem Zweigleis-Modus

Basierend auf den Informationen zur Produktveröffentlichung, die die einzelnen Unternehmen öffentlich bekanntgegeben haben, ist die Anpassung der Codex-Schnittstelle einer der Branchentrends, bei denen KI-Tools für das Programmieren auf einen Zweigleis-Modus umstellen. Anthropic hat seine Produkte in Claude Code (Programmierung) und Co Work (alltägliche Arbeit) unterteilt; auch ByteDance hat bei seinem TRAE Solo ebenfalls zwei Arbeitsmodi eingerichtet: Programmierung und alltägliche Arbeit.

Häufige Fragen

Wie heißen die beiden Modi der neuen Codex-Oberfläche und wie sind sie eingeordnet?

Laut dem von Sam Altman auf X veröffentlichten Screenshot richtet sich der „Excelmogging“-Modus an alltägliche Büroszenarien und ist auf eine schlankere Oberfläche ausgerichtet; der „Codemaxxing“-Modus richtet sich an professionelle Entwickler und fokussiert sich auf Codegenerierung und Engineering-Aufgaben.

Welche technischen Architekturen umfasst die Zusammenarbeit von OpenAI und NVIDIA in Bezug auf Codex?

Laut der öffentlichen Vorstellung von NVIDIA und der Erklärung von Sam Altman wird die Zusammenarbeit diesmal für die Bereitstellung von Codex über die NVIDIA GB200 NVL72 Rack-Scale-Architektur umgesetzt. NVIDIA-Ingenieure berichteten von einer erheblichen Produktivitätssteigerung, nachdem sie Codex-Anwendungen mit GPT-5.5 eingesetzt hatten.

Welche anderen KI-Tools als OpenAI Codex haben ebenfalls einen Zweigleis-Modus aus Programmierung und Büro eingeführt?

Laut den öffentlich verfügbaren Produktinformationen der einzelnen Unternehmen hat Anthropic sein Produkt in zwei Linien unterteilt: Claude Code (Programmierung) und Co Work (alltägliche Arbeit); auch ByteDance hat bei seinem TRAE Solo ebenfalls zwei Arbeitsmodi eingerichtet: Programmierung und alltägliche Arbeit.

Disclaimer: The information on this page may come from third parties and does not represent the views or opinions of Gate. The content displayed on this page is for reference only and does not constitute any financial, investment, or legal advice. Gate does not guarantee the accuracy or completeness of the information and shall not be liable for any losses arising from the use of this information. Virtual asset investments carry high risks and are subject to significant price volatility. You may lose all of your invested principal. Please fully understand the relevant risks and make prudent decisions based on your own financial situation and risk tolerance. For details, please refer to

Disclaimer.

Verwandte Artikel

Cognition macht Singapur zum APAC-Hauptsitz und richtet den Blick auf die regionale Expansion

Gate-News-Meldung, 29. April — Cognition, das KI-Coding-Startup hinter Devin, kündigte am 29. April an, dass es Singapur als seinen Hauptsitz für Asien-Pazifik etablieren wird, um das regionale Wachstum über Südostasien, Australien, Indien und Südkorea hinweg zu steuern.

Richard Spence wird die APAC-Operationen leiten

GateNews47M her

Google und das Pentagon unterzeichnen geheime KI-Vereinbarungen, Mitarbeiter-Open-Brief protestiert

Laut The Information in der Berichterstattung vom 28. April hat Google eine Vereinbarung unterzeichnet, um dem US-amerikanischen Pentagon KI-(AI-)Modelle für vertrauliche Arbeiten zur Verfügung zu stellen. Die New York Times zitiert informierte Personen mit der Aussage, dass die Vereinbarung es dem US-Verteidigungsministerium ermögliche, Googles KI für legitime staatliche Zwecke zu nutzen, in Art und Weise ähnlich wie die geheimen KI-Implementierungsabkommen, die das Pentagon im vergangenen Monat mit OpenAI und xAI unterzeichnet hat.

MarketWhisper1Std her

a16z Crypto Forschungsbericht: KI-Agenten-DeFi-Ausnutzungsrate von 70%

Laut dem von a16z Crypto am 29. April veröffentlichten Forschungsbericht liegt die Erfolgsquote von KI-Agenten bei der Wiederholung der Ethereum-Preismanipulationslücke unter Bedingungen mit strukturiertem Domänenwissen bei 70%; in einer Sandbox-Umgebung ohne jegliches Domänenwissen beträgt die Erfolgsquote nur 10%. Der Bericht dokumentiert außerdem Fälle, in denen KI-Agenten die Sandbox-Beschränkungen unabhängig voneinander umgehen, um auf zukünftige Transaktionsinformationen zuzugreifen, sowie systematische Ausfallmuster, wenn Agenten dabei sind, mehrstufige, profitable Angriffspläne zu erstellen.

MarketWhisper1Std her

OpenAI-Modelle sollen schrittweise zu Amazons benutzerdefiniertem Trainium-Chip migrieren, sagt Altman — er sei "sehr gespannt" darauf

Gate-News-Mitteilung, 29. April — OpenAI-Modelle, die auf dem Amazon Web Services Bedrock laufen, werden schrittweise auf Trainium migrieren, Amazons eigens entwickelten KI-Chip, wie jüngste Aussagen von OpenAI-CEO Sam Altman und AWS-Führungskräften nahelegen. Aktuell arbeiten die Modelle in einer gemischten Umgebung, die sowohl GPUs als auch Trainium nutzt, wobei der Anteil mit der Zeit zunehmend auf Trainium übergeht. Altman sagte, das Unternehmen sei "bereit, Modelle auf Trainium zu verlagern."

AWS-Manager Garman räumte ein, dass der Name Trainium möglicherweise irreführend gewesen sein könnte, da der Chip für sowohl Training als auch Inferenz ausgelegt ist, wobei Inferenz in Zukunft voraussichtlich der wichtigste Anwendungsfall sein wird. Garman betonte jedoch, dass das Chip-Branding für die meisten Kunden weitgehend irrelevant sei; Nutzer kämen mit OpenAI über die API-Schnittstelle in Kontakt, nicht direkt mit der zugrunde liegenden Hardware. Auf die Frage nach einer zukünftigen Integration von Nicht-OpenAI-Modellen in Bedrock Managed Agents ging Garman nicht ins Detail und erklärte lediglich, dass AWS derzeit auf seine Partnerschaft mit OpenAI fokussiert sei.

Die Zusammenarbeit unterstreicht Amazons Strategie, seine eigene kundenspezifische Siliziumtechnologie zu nutzen, um große KI-Workloads auf seiner Cloud-Plattform zu unterstützen.

GateNews2Std her

Altman: Token-Based Pricing Becoming Obsolete as GPT-5.5 Shifts Focus to Task Completion Over Token Count

Gate News-Nachricht, 29. April — OpenAI-CEO Sam Altman sagte in einem Interview mit Ben Thompson auf Stratechery, dass tokenbasierte Preisgestaltung kein langfristig tragfähiges Modell für KI-Dienstleistungen ist. Unter Verwendung von GPT-5.5 als Beispiel merkte Altman an, dass zwar der Preis pro Token deutlich höher ist als bei GPT-5.4, das Modell jedoch für die gleiche Aufgabe viel weniger Tokens verwendet, was bedeutet, dass Kunden sich nicht für die Anzahl der Tokens interessieren — sondern nur dafür, ob die Aufgabe abgeschlossen wird und die Gesamtkosten.

"Wir sind keine Token-Fabrik; wir sind eher eine Intelligenz-Fabrik", sagte Altman. "Kunden wollen die meiste Intelligenz für möglichst wenig Geld kaufen. Ob die zugrunde liegende Arbeit von einem großen Modell erledigt wird, das wenige Tokens ausführt, oder von einem kleinen Modell, das viele Tokens ausführt, ist für sie nicht relevant." Er fügte hinzu, dass die aktuelle Kundenbasis von OpenAI zunehmend mehr Kapazität fordert, anstatt über Preise zu verhandeln: Viel mehr Kunden sagen "gebt uns mehr Kapazität, egal was es kostet" als solche, die nach Rabatten fragen.

Altman zog eine Parallele zu Versorgungsunternehmen und erklärte, dass sich die KI-Nachfrage anders skaliert als bei Wasser oder Strom — wo niedrigere Preise den Verbrauch nicht signifikant erhöhen. "Solange der Preis niedrig genug ist, werde ich weiter mehr verwenden. Keine andere öffentliche Versorgungsleistung funktioniert auf diese Weise", sagte er. AWS-CEO Matt Garman ergänzte, dass die Preise für Rechenleistung in den vergangenen 30 Jahren um mehrere Größenordnungen gefallen seien, während heute dennoch mehr Rechenleistung verkauft wird als jemals zuvor.

Altman beschrieb außerdem ChatGPT als "das erste wirklich groß angelegte Konsumprodukt seit Facebook" und räumte ein, dass zwar erwartet wurde, dass KI die Suche stören würde, die eigentlichen Erfolge jedoch von ChatGPT selbst und der Codex-API kamen. Er merkte an, dass "Google in vielerlei Hinsicht noch immer unterschätzt wird."

GateNews2Std her

Ant Groups Ling-2.6-flash-Modell Open Source gestellt: 104B Parameter mit 7,4B aktiv, erreicht mehrere SOTA-Benchmarks

Gate News Nachricht, 29. April — Die Modellgewichte von Ant Groups Ling-2.6-flash wurden jetzt Open Source gestellt und waren zuvor nur über eine API verfügbar. Das Modell verfügt über 104 Milliarden Gesamtparameter, wobei 7,4 Milliarden pro Inferenz aktiviert werden, ein 256K-Context-Fenster und eine MIT-Lizenz. BF16, FP8 und INT4

GateNews2Std her