Sam Altman publie des captures d’écran du double mode de Codex, séparant officiellement les fonctions bureau et programmation

Le CEO d’OpenAI, Sam Altman, a publié le 29 avril sur la plateforme X des captures d’écran et une déclaration indiquant que Codex lance une nouvelle interface de démarrage. Lors de la première connexion, les utilisateurs doivent choisir entre deux modes : Excelmogging et Codemaxxing. Les utilisateurs actifs hebdomadaires de Codex dépassent actuellement 4 millions. Les cas d’usage se sont étendus de la génération de code à des usages non techniques.

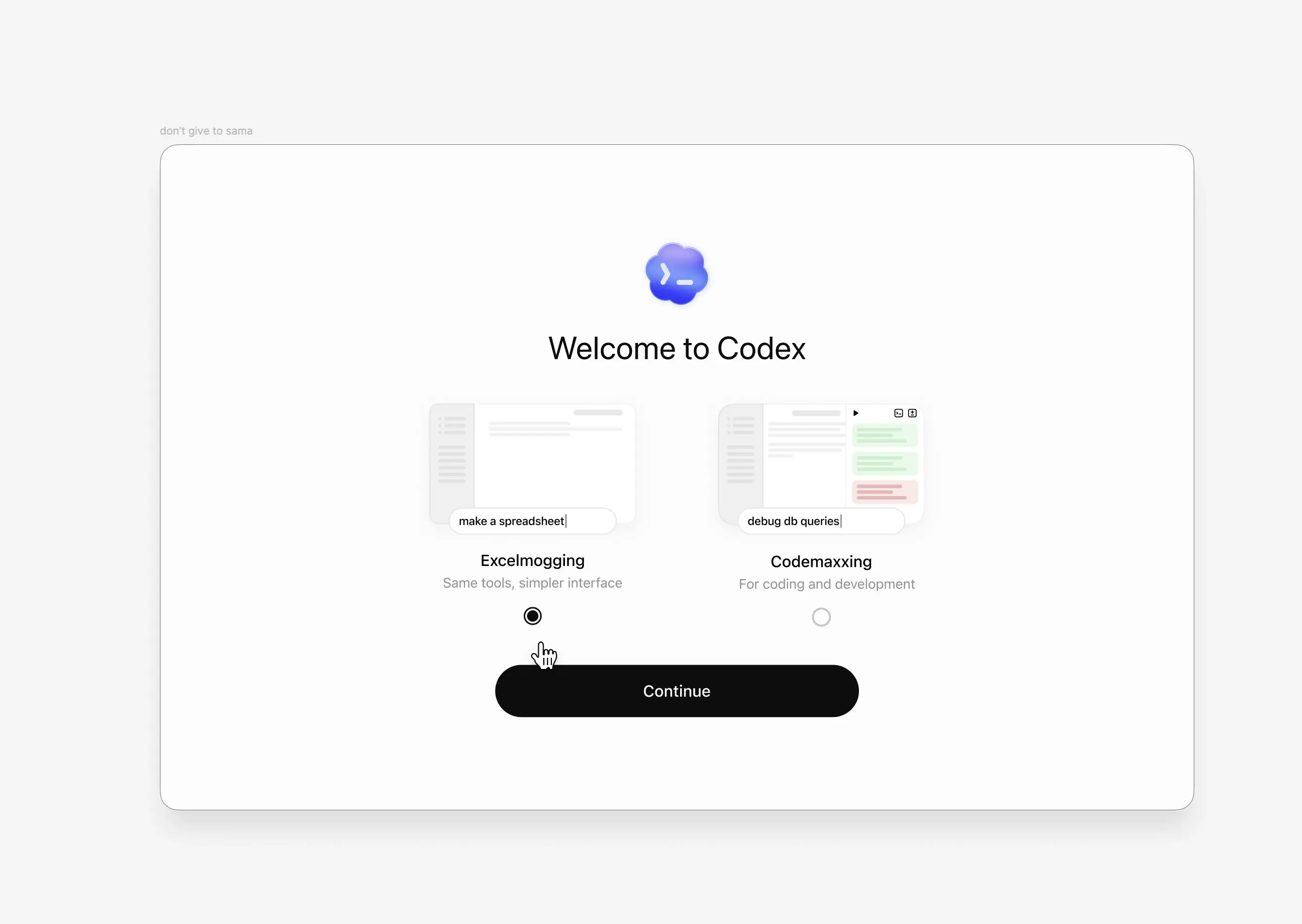

Conception à double mode de la nouvelle interface de Codex

(Source : X de Sam Altman)

D’après la capture d’écran publiée par Sam Altman sur X, la nouvelle interface de démarrage de Codex répartira les utilisateurs en deux parcours. Le mode « Excelmogging » adopte une interaction plus simple, destinée aux utilisateurs non programmeurs pour des scénarios de bureau du quotidien ; le mode « Codemaxxing » conserve la conception initiale centrée sur la génération de code et les tâches d’ingénierie, destinée aux développeurs professionnels.

Sam Altman a également indiqué dans un autre billet sur la plateforme X : « Je suis en train de passer au sommeil polyphasique (polyphasic sleep), car le GPT-5.5 dans Codex est trop exceptionnel, je ne peux pas dormir longtemps sans que cela retarde le travail. »

OpenAI et NVIDIA collaborent pour déployer Codex

D’après la déclaration publique de Sam Altman sur X, OpenAI collabore avec NVIDIA pour déployer Codex dans l’ensemble de l’entreprise. Altman a déclaré : « Nous collaborons avec NVIDIA, nous avons essayé une toute nouvelle façon de promouvoir Codex dans toute l’entreprise. En voyant que cela fonctionne avec succès, c’est vraiment formidable. »

D’après la présentation publique de NVIDIA, des ingénieurs de NVIDIA ont utilisé des applications Codex équipées de GPT-5.5 pendant plusieurs semaines et ont rapporté une amélioration significative de la productivité ; ce déploiement est basé sur l’architecture en rack NVIDIA GB200 NVL72.

Tendance du secteur : les agents de programmation passent à un mode double

Selon les informations de lancement produit publiées par plusieurs entreprises, l’ajustement de l’interface de Codex est l’une des tendances du secteur selon lesquelles les outils d’IA de programmation basculent vers un mode double. Anthropic a réparti ses produits en deux gammes : Claude Code (programmation) et Co Work (travail quotidien) ; ByteDance a également mis en place, au sein de son TRAE Solo, deux modes de travail : programmation et travail quotidien.

Questions fréquentes

Quelles sont les deux appellations de modes de la nouvelle interface de Codex et comment sont-elles positionnées ?

D’après la capture d’écran publiée par Sam Altman sur X, le mode « Excelmogging » est destiné aux scénarios de bureau du quotidien et se positionne comme une interface plus simple ; le mode « Codemaxxing » est destiné aux développeurs professionnels, avec un focus sur la génération de code et les tâches d’ingénierie.

La collaboration entre OpenAI et NVIDIA sur Codex implique quelles architectures techniques ?

D’après la présentation publique de NVIDIA et la déclaration de Sam Altman, cette collaboration utilise l’architecture en rack NVIDIA GB200 NVL72 pour déployer Codex ; après avoir utilisé des applications Codex équipées de GPT-5.5, les ingénieurs de NVIDIA ont rapporté une amélioration significative de la productivité.

En plus de Codex d’OpenAI, quels autres outils d’IA ont également lancé des modes doubles programmation et bureau ?

D’après les informations publiques sur les produits de chaque entreprise, Anthropic a réparti ses produits en deux lignes : Claude Code (programmation) et Co Work (travail quotidien) ; au sein de ByteDance, le TRAE Solo a également mis en place deux modes de travail : programmation et travail quotidien.

Articles similaires

Cognition établit Singapour comme siège APAC, vise une expansion régionale

Google et le Pentagone signent un accord confidentiel d’IA, un appel des employés s’y oppose

Rapport de recherche Crypto de a16z : le taux d’exploitation des vulnérabilités DeFi par des agents IA atteint 70%

Les modèles d’OpenAI migreront progressivement vers la puce Trainium sur mesure d’Amazon, déclare Altman — « Je m’y réjouis »

Altman : Une tarification par jetons appelée à devenir obsolète tandis que GPT-5.5 se tourne vers l’exécution des tâches plutôt que le nombre de jetons

Le modèle open source Ling-2.6-flash d’Ant Group : 104B de paramètres avec 7,4B actifs, atteint plusieurs repères SOTA