Đào tạo lại một mô hình lớn với mã thông báo tạm dừng và AI học cách suy nghĩ hai lần

Nguồn: Qubits

Suy nghĩ thêm về các bước trước khi ChatGPT đưa ra câu trả lời có thể cải thiện độ chính xác.

Vì vậy, bạn có thể bỏ qua lời nhắc và trực tiếp nội tâm hóa khả năng này trong mô hình lớn?

Nghiên cứu mới của CMU và nhóm Google thêm mã thông báo tạm dừng khi đào tạo các mô hình lớn để đạt được điều này.

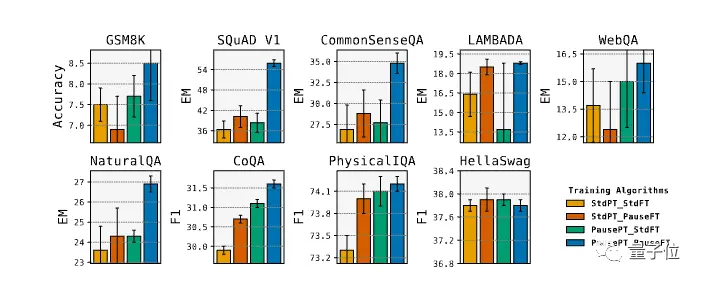

Trong thí nghiệm, điểm số của 8 đánh giá được cải thiện, trong đó điểm EM của SQuAD tăng 18%, CommonSenseQA tăng 8% và nhiệm vụ suy luận trong GSM8k cũng tăng 1%.

Trong thí nghiệm, điểm số của 8 đánh giá được cải thiện, trong đó điểm EM của SQuAD tăng 18%, CommonSenseQA tăng 8% và nhiệm vụ suy luận trong GSM8k cũng tăng 1%.

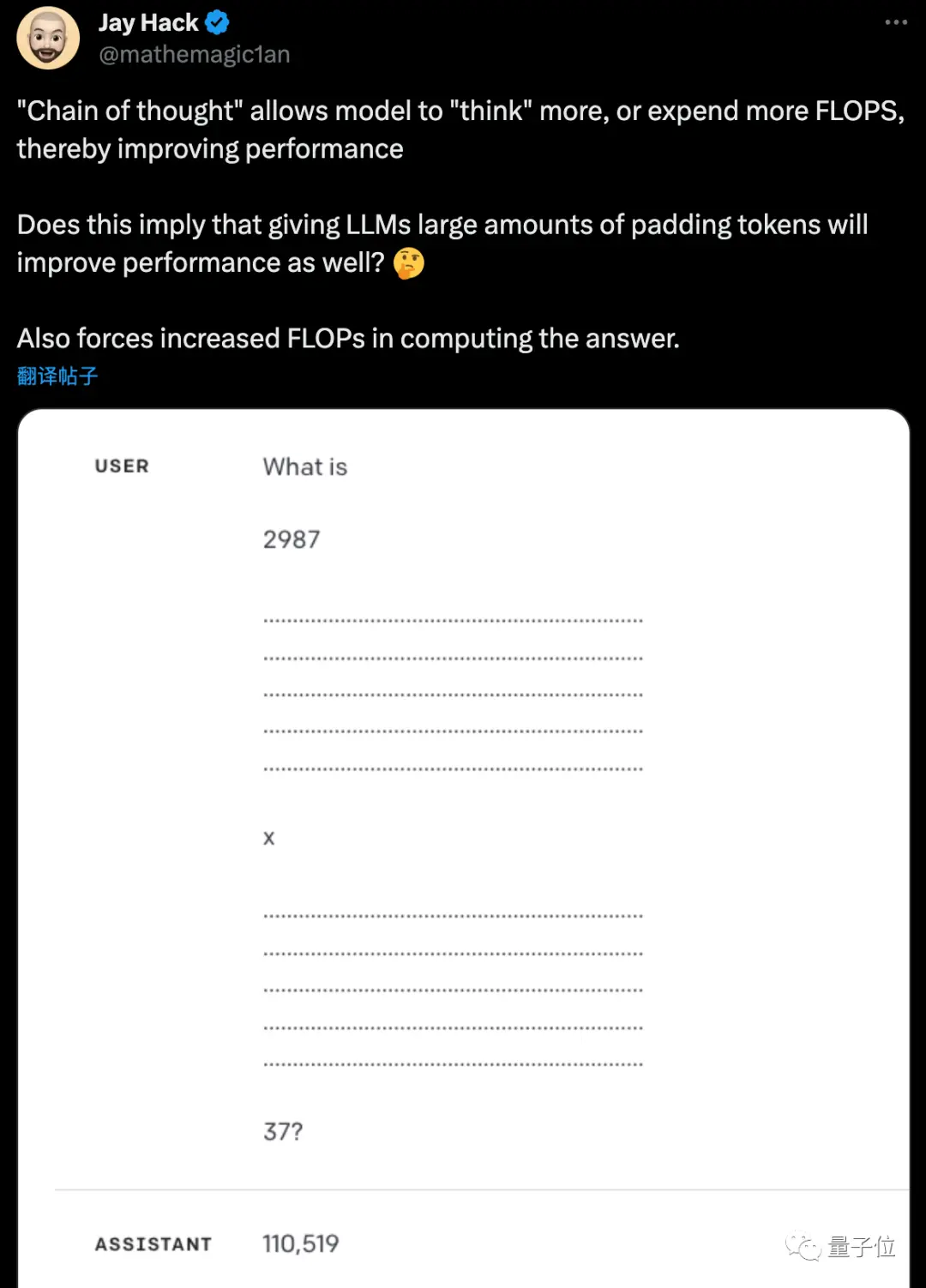

Nhà nghiên cứu Jack Hack cho biết ông đã đưa ra một giả thuyết tương tự cách đây không lâu và rất vui khi thấy nó được thử nghiệm.

Nhà nghiên cứu Jack Hack cho biết ông đã đưa ra một giả thuyết tương tự cách đây không lâu và rất vui khi thấy nó được thử nghiệm.

Kỹ sư Aaron Erickson của Nvidia nói rằng đó có phải là sự thật khi thêm “uh-huh-ah” khi nói chuyện với con người?

Kỹ sư Aaron Erickson của Nvidia nói rằng đó có phải là sự thật khi thêm “uh-huh-ah” khi nói chuyện với con người?

** Tinh chỉnh trước khi đào tạo được thêm vào mã thông báo tạm dừng**

Toàn bộ nghiên cứu dựa trên một ý tưởng đơn giản:

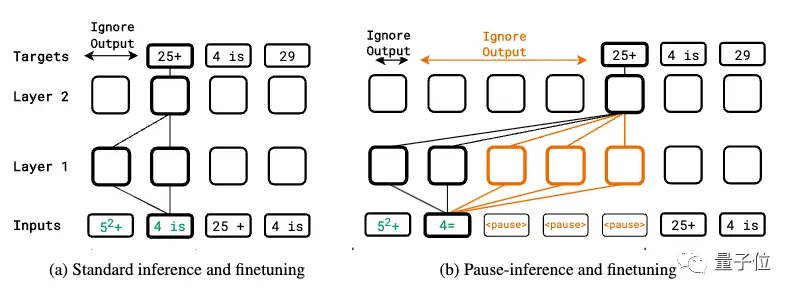

Nối một chuỗi (tạm dừng mã thông báo) vào chuỗi đầu vào, trì hoãn mô hình xuất mã thông báo tiếp theo.

Điều này có thể cung cấp cho mô hình thêm thời gian tính toán để xử lý các đầu vào phức tạp hơn.

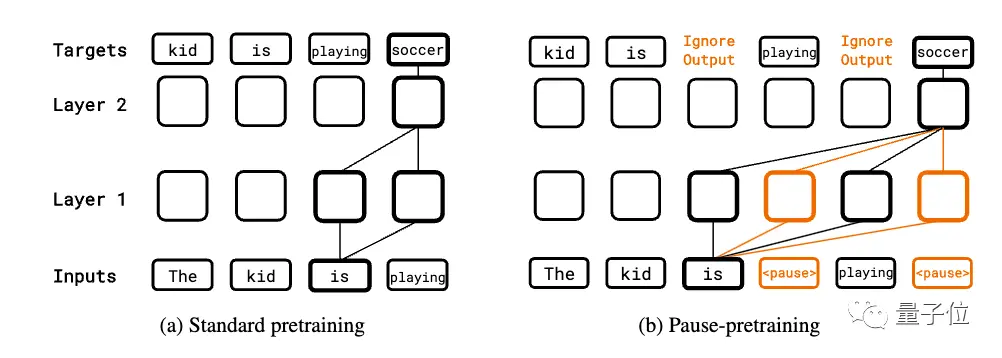

Các tác giả không chỉ giới thiệu nó khi nhiệm vụ xuôi dòng được tinh chỉnh mà còn chèn ngẫu nhiên nó vào trình tự trong quá trình đào tạo trước, cho phép mô hình học cách tận dụng độ trễ tính toán này trong cả hai giai đoạn.

Các tác giả không chỉ giới thiệu nó khi nhiệm vụ xuôi dòng được tinh chỉnh mà còn chèn ngẫu nhiên nó vào trình tự trong quá trình đào tạo trước, cho phép mô hình học cách tận dụng độ trễ tính toán này trong cả hai giai đoạn.

Trong giai đoạn tiền đào tạo, một tỷ lệ phần trăm nhất định của mã thông báo tạm dừng được chèn ngẫu nhiên vào kho dữ liệu vào chuỗi đầu vào để đào tạo trước tự hồi quy tiêu chuẩn. Tuy nhiên, dự đoán về mã thông báo bị tạm ngưng bị bỏ qua khi tính toán khoản lỗ.

Trong giai đoạn tiền đào tạo, một tỷ lệ phần trăm nhất định của mã thông báo tạm dừng được chèn ngẫu nhiên vào kho dữ liệu vào chuỗi đầu vào để đào tạo trước tự hồi quy tiêu chuẩn. Tuy nhiên, dự đoán về mã thông báo bị tạm ngưng bị bỏ qua khi tính toán khoản lỗ.

Khi tác vụ xuôi dòng được tinh chỉnh, một số mã thông báo tạm dừng nhất định được gắn vào đầu vào và sau đó dự đoán tự động hồi quy được thực hiện trên chuỗi đích, đồng thời tinh chỉnh các tham số mô hình.

Giai đoạn suy luận cũng thêm cùng một số mã thông báo tạm dừng, nhưng bỏ qua đầu ra mô hình cho đến mã thông báo tạm dừng cuối cùng, sau đó bắt đầu trích xuất câu trả lời.

Thí nghiệm sử dụng mô hình Bộ giải mã tinh khiết Transformer tiêu chuẩn, được chia thành hai phiên bản: tham số **130M và tham số 1B **.

Mã thông báo tạm dừng chỉ thêm 1024 tham số, đây là kích thước nhúng riêng của nó.

Các thí nghiệm trên 9 nhiệm vụ khác nhau cho thấy hiệu quả của việc giới thiệu mã thông báo tạm dừng chỉ trong giai đoạn tinh chỉnh là không rõ ràng và một số nhiệm vụ không được cải thiện.

Nhưng nếu bạn sử dụng mã thông báo tạm dừng trong cả giai đoạn trước khi đào tạo và tinh chỉnh, bạn sẽ nhận được sự cải thiện đáng kể trên hầu hết các nhiệm vụ.

Bài báo cũng khám phá các siêu thông số chính như số lượng và vị trí của các mã thông báo bị treo. Nó đã được tìm thấy rằng thường có một số lượng tối ưu cho các mô hình khác nhau.

Cuối cùng, các tác giả cũng chỉ ra rằng tác phẩm này cũng có một số hạn chế.

- Vì mã thông báo đình chỉ làm tăng số lượng tính toán mô hình, liệu có công bằng khi so sánh với các phương pháp khác hay không vẫn còn được thảo luận

- Phương pháp mới cần được đào tạo lại và vẫn khó áp dụng vào thực tế

- Vẫn còn thiếu hiểu biết sâu sắc về cơ chế làm việc cụ thể

- Nếu số lượng mã thông báo tạm dừng là 0 trong quá trình suy luận, mô hình vẫn hoạt động kém

Giám đốc điều hành của công cụ tìm kiếm You.com nói rằng bước tiếp theo là thử tất cả các kỹ thuật để cải thiện hiệu suất nhận thức của con người trên các mô hình lớn?

Bây giờ có “suy nghĩ từng bước” và “hít một hơi thật sâu”.

Bây giờ có “suy nghĩ từng bước” và “hít một hơi thật sâu”.

Có lẽ bài báo bom tấn tiếp theo là dạy những người mẫu lớn ngủ với những vấn đề, hoặc ăn uống và tập thể dục lành mạnh thái quá.

Địa chỉ giấy:

Liên kết tham khảo:

[1]