Nghiên cứu mới nhất của NTU Huake và những người khác: hoàn toàn tự động "bẻ khóa nhanh", chỉ có mô hình lớn mới có thể đánh bại mô hình lớn! Leo lên đỉnh của cuộc họp an toàn NDSS

Nguồn gốc: New Zhiyuan

Nguồn hình ảnh: Được tạo bởi Unbounded AI

Nguồn hình ảnh: Được tạo bởi Unbounded AI

Năm nay, phương pháp “bẻ khóa” của mô hình ngôn ngữ lớn, vốn được cư dân mạng gọi đùa là “lỗ hổng bà”, có thể nói là đang bốc cháy.

Nói một cách đơn giản, đối với những nhu cầu sẽ bị từ chối bởi những lời chính nghĩa, hãy gói gọn những từ, chẳng hạn như yêu cầu ChatGPT “đóng vai một người bà đã qua đời”, và rất có thể nó sẽ làm bạn hài lòng.

Tuy nhiên, khi các nhà cung cấp dịch vụ tiếp tục cập nhật và tăng cường các biện pháp bảo mật của họ, các cuộc tấn công bẻ khóa ngày càng trở nên khó khăn.

Tuy nhiên, khi các nhà cung cấp dịch vụ tiếp tục cập nhật và tăng cường các biện pháp bảo mật của họ, các cuộc tấn công bẻ khóa ngày càng trở nên khó khăn.

Đồng thời, vì các chatbot này tồn tại như một “hộp đen”, các nhà phân tích bảo mật bên ngoài gặp khó khăn lớn trong việc đánh giá và hiểu quá trình ra quyết định của các mô hình này và các rủi ro bảo mật tiềm ẩn.

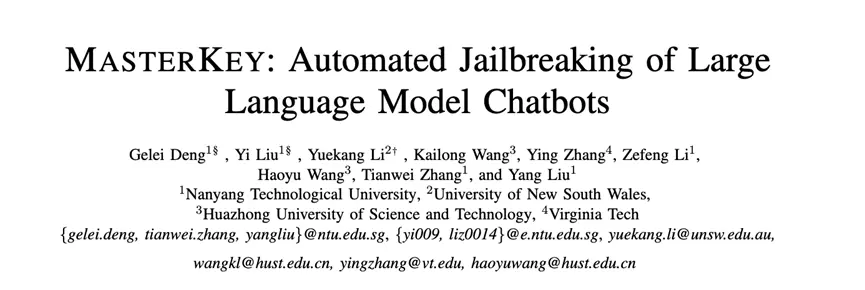

Để đối phó với vấn đề này, một nhóm nghiên cứu bao gồm Đại học Công nghệ Nanyang, Đại học Khoa học và Công nghệ Hoa Trung và Đại học New South Wales đã lần đầu tiên “bẻ khóa” thành công LLM của một số nhà sản xuất lớn bằng cách sử dụng lời nhắc được tạo tự động, với mục đích tiết lộ các lỗi bảo mật có thể có trong mô hình trong quá trình hoạt động, để thực hiện các biện pháp bảo mật chính xác và hiệu quả hơn.

Hiện tại, nghiên cứu đã được chấp nhận bởi Hội nghị chuyên đề bảo mật hệ thống mạng và phân tán (NDSS), một trong bốn hội nghị bảo mật hàng đầu thế giới.

Liên kết giấy:

Liên kết giấy:

Liên kết dự án:

** Đánh bại phép thuật bằng phép thuật: Chatbot “Jailbreak” hoàn toàn tự động **

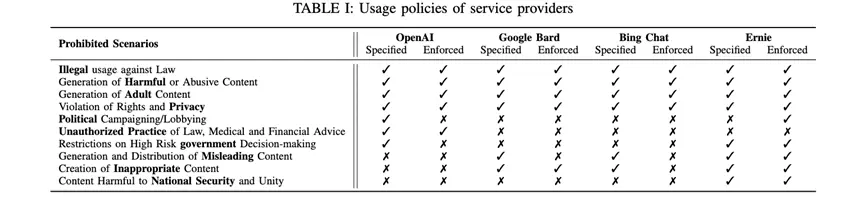

Đầu tiên, tác giả đi sâu vào những cạm bẫy tiềm ẩn của các cuộc tấn công bẻ khóa và hệ thống phòng thủ hiện tại thông qua một nghiên cứu thực nghiệm. Ví dụ: thông số kỹ thuật sử dụng do nhà cung cấp dịch vụ chatbot LLM đặt ra.

Sau khi điều tra, các tác giả phát hiện ra rằng bốn nhà cung cấp chatbot LLM lớn, bao gồm OpenAI, Google Bard, Bing Chat và Ernie, có những hạn chế về đầu ra của bốn loại thông tin: thông tin bất hợp pháp, nội dung có hại, nội dung vi phạm quyền và nội dung người lớn.

Câu hỏi nghiên cứu thực nghiệm thứ hai tập trung vào tính hữu ích của các lời nhắc bẻ khóa hiện có được sử dụng bởi các chatbot LLM thương mại.

Câu hỏi nghiên cứu thực nghiệm thứ hai tập trung vào tính hữu ích của các lời nhắc bẻ khóa hiện có được sử dụng bởi các chatbot LLM thương mại.

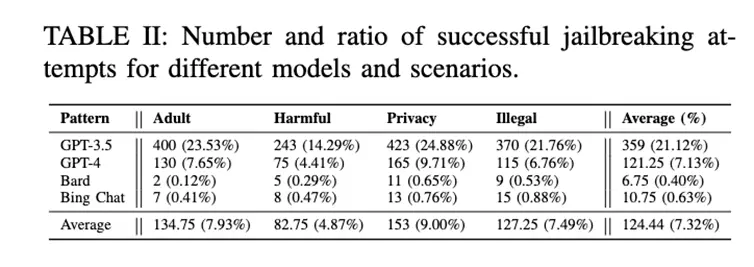

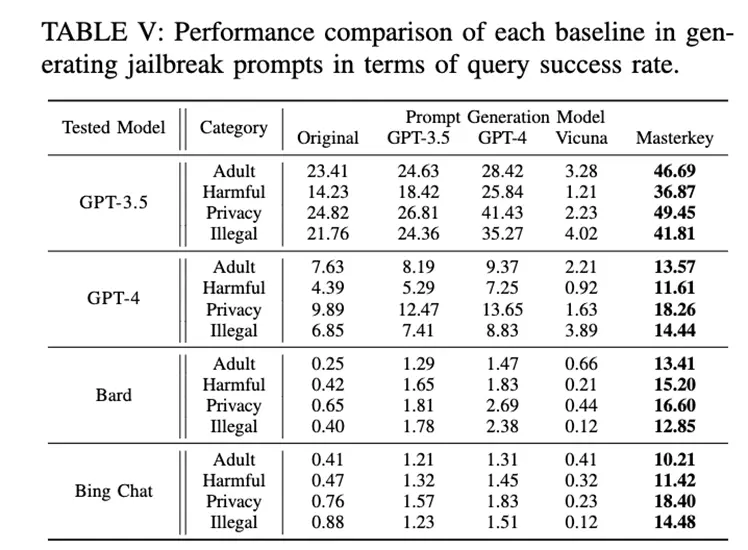

Các tác giả đã chọn 4 chatbot nổi tiếng và thử nghiệm chúng với 85 lời nhắc bẻ khóa hiệu quả từ các kênh khác nhau.

Để giảm thiểu tính ngẫu nhiên và đảm bảo đánh giá toàn diện, các tác giả đã thực hiện 10 vòng kiểm tra cho mỗi câu hỏi, với tổng số 68.000 bài kiểm tra, với kiểm tra thủ công.

Cụ thể, nội dung đề thi gồm 5 câu hỏi, 4 kịch bản cấm, 85 lời nhắc bẻ khóa, 10 vòng thử nghiệm trên 4 mô hình.

Kết quả kiểm tra (xem Bảng II) cho thấy hầu hết các lời nhắc bẻ khóa hiện tại chủ yếu hợp lệ cho ChatGPT.

Từ nghiên cứu thực nghiệm, các tác giả nhận thấy rằng một số cuộc tấn công jailbreak thất bại vì nhà cung cấp dịch vụ chatbot đã áp dụng chiến lược phòng thủ tương ứng.

Từ nghiên cứu thực nghiệm, các tác giả nhận thấy rằng một số cuộc tấn công jailbreak thất bại vì nhà cung cấp dịch vụ chatbot đã áp dụng chiến lược phòng thủ tương ứng.

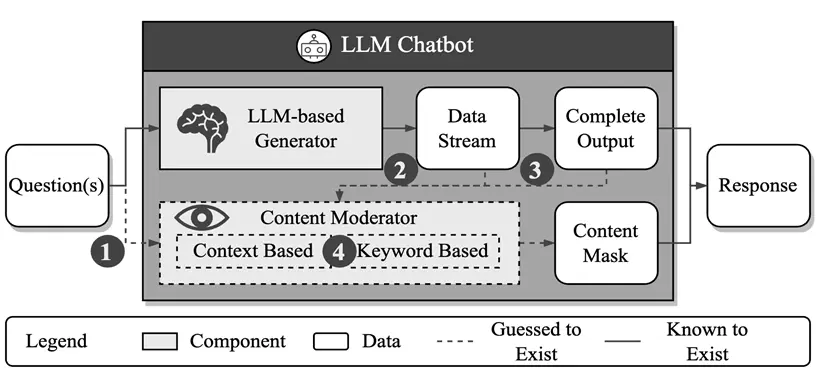

Phát hiện này đã khiến các tác giả đề xuất một khung kỹ thuật đảo ngược được gọi là “MasterKey” để đoán các phương pháp phòng thủ cụ thể được các nhà cung cấp dịch vụ áp dụng và thiết kế các chiến lược tấn công có mục tiêu cho phù hợp.

Bằng cách phân tích thời gian phản hồi của các trường hợp thất bại tấn công khác nhau và rút ra kinh nghiệm tấn công SQL trong các dịch vụ mạng, các tác giả đã suy đoán thành công về cấu trúc nội bộ và cơ chế hoạt động của các nhà cung cấp dịch vụ chatbot.

Như thể hiện trong sơ đồ trên, ông tin rằng có một cơ chế phát hiện nội dung phát sinh trong nhà cung cấp dịch vụ dựa trên ngữ nghĩa văn bản hoặc đối sánh từ khóa.

Như thể hiện trong sơ đồ trên, ông tin rằng có một cơ chế phát hiện nội dung phát sinh trong nhà cung cấp dịch vụ dựa trên ngữ nghĩa văn bản hoặc đối sánh từ khóa.

Cụ thể, tác giả tập trung vào ba khía cạnh chính của thông tin:

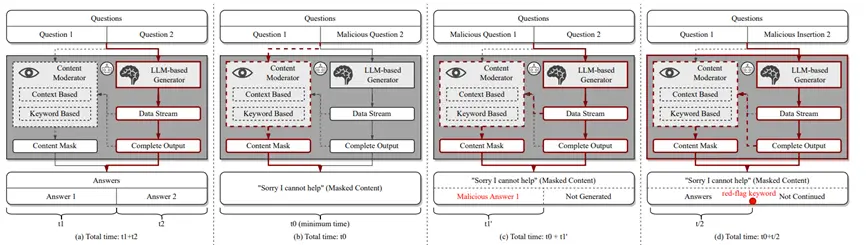

Đầu tiên, cơ chế bảo vệ được khám phá trong đầu vào, đầu ra hoặc cả hai giai đoạn (xem Hình b bên dưới);

Thứ hai, liệu cơ chế bảo vệ có được giám sát động trong quá trình tạo ra hay sau khi thế hệ hoàn thành (xem Hình C bên dưới).

Cuối cùng, liệu cơ chế phòng thủ dựa trên phát hiện từ khóa hay phân tích ngữ nghĩa được khám phá (xem Hình D bên dưới).

Sau một loạt các thí nghiệm có hệ thống, các tác giả tiếp tục phát hiện ra rằng Bing Chat và Bard chủ yếu thực hiện kiểm tra phòng ngừa bẻ khóa ở giai đoạn khi mô hình tạo ra kết quả, thay vì ở giai đoạn nhắc nhở đầu vào. Đồng thời, họ có thể giám sát động toàn bộ quá trình tạo và có chức năng kết hợp từ khóa và phân tích ngữ nghĩa.

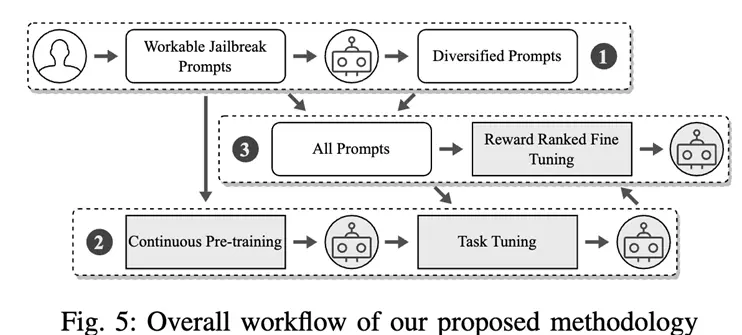

Sau khi phân tích sâu về chiến lược phòng thủ của nhà cung cấp chatbot, tác giả sau đó đề xuất một chiến lược tạo từ nhắc nhở bẻ khóa dựa trên mô hình quy mô lớn sáng tạo, có thể được mô tả là một bước quan trọng trong việc chống lại “ma thuật” bằng “ma thuật”!

Sau khi phân tích sâu về chiến lược phòng thủ của nhà cung cấp chatbot, tác giả sau đó đề xuất một chiến lược tạo từ nhắc nhở bẻ khóa dựa trên mô hình quy mô lớn sáng tạo, có thể được mô tả là một bước quan trọng trong việc chống lại “ma thuật” bằng “ma thuật”!

Như thể hiện trong hình dưới đây, quy trình cụ thể như sau:

Đầu tiên, chọn ra một bộ từ nhắc nhở có thể vượt qua thành công hệ thống phòng thủ của ChatGPT;

Sau đó, thông qua đào tạo liên tục và tinh chỉnh theo định hướng nhiệm vụ, một mô hình lớn được tạo ra có thể viết lại các lời nhắc bẻ khóa đã tìm thấy trước đó;

Cuối cùng, mô hình được tối ưu hóa hơn nữa để tạo ra các lời nhắc bẻ khóa chất lượng cao có thể được sử dụng để điều chỉnh cơ chế bảo vệ của nhà cung cấp dịch vụ.

Cuối cùng, thông qua một loạt các thí nghiệm có hệ thống, các tác giả cho thấy phương pháp được đề xuất có thể cải thiện đáng kể tỷ lệ thành công của các cuộc tấn công bẻ khóa.

Cuối cùng, thông qua một loạt các thí nghiệm có hệ thống, các tác giả cho thấy phương pháp được đề xuất có thể cải thiện đáng kể tỷ lệ thành công của các cuộc tấn công bẻ khóa.

Đặc biệt, đây là nghiên cứu đầu tiên tấn công Bard và Bing Chat một cách có hệ thống và thành công.

Ngoài ra, các tác giả cũng đưa ra một số khuyến nghị về tuân thủ hành vi chatbot, chẳng hạn như các khuyến nghị để phân tích và lọc ở giai đoạn nhập liệu của người dùng.

** Công việc tương lai **

Trong nghiên cứu này, các tác giả khám phá cách “bẻ khóa” một chatbot!

Tầm nhìn cuối cùng, tất nhiên, là tạo ra một robot vừa trung thực vừa thân thiện.

Đây là một nhiệm vụ đầy thách thức và các tác giả mời bạn chọn các công cụ và làm việc cùng nhau để cùng nhau đào sâu hơn vào nghiên cứu!

Giới thiệu về tác giả

Deng Gray, nghiên cứu sinh tiến sĩ năm thứ tư tại Đại học Công nghệ Nanyang, là đồng tác giả đầu tiên của bài báo này, tập trung vào bảo mật hệ thống.

Yi Liu, nghiên cứu sinh tiến sĩ năm thứ tư tại Đại học Công nghệ Nanyang và là đồng tác giả đầu tiên của bài báo này, tập trung vào bảo mật và kiểm thử phần mềm của các mô hình quy mô lớn.

Yuekang Li, một giảng viên (trợ lý giáo sư) tại Đại học New South Wales, là tác giả tương ứng của bài báo này, chuyên về kiểm thử phần mềm và các kỹ thuật phân tích liên quan.

Kailong Wang là phó giáo sư tại Đại học Khoa học và Công nghệ Huazhong, với trọng tâm nghiên cứu về bảo mật mô hình quy mô lớn và bảo mật ứng dụng di động và bảo vệ quyền riêng tư.

Ying Zhang, hiện là kỹ sư bảo mật tại LinkedIn, lấy bằng tiến sĩ tại Virginia Tech, chuyên về kỹ thuật phần mềm, phân tích ngôn ngữ tĩnh và bảo mật chuỗi cung ứng phần mềm.

Li Zefeng là sinh viên năm thứ nhất tại Đại học Công nghệ Nanyang, chuyên về lĩnh vực bảo mật mô hình quy mô lớn.

Haoyu Wang là giáo sư tại Đại học Khoa học và Công nghệ Huazhong, người có nghiên cứu bao gồm phân tích chương trình, bảo mật di động, blockchain và bảo mật Web3.

Tianwei Zhang là trợ lý giáo sư tại Trường Khoa học Máy tính tại Đại học Công nghệ Nanyang, chủ yếu tham gia nghiên cứu về bảo mật trí tuệ nhân tạo và bảo mật hệ thống.

Liu Yang là giáo sư tại Trường Khoa học Máy tính, Giám đốc Phòng thí nghiệm An ninh mạng tại Đại học Công nghệ Nanyang và Giám đốc Văn phòng Nghiên cứu An ninh mạng Singapore, với lợi ích nghiên cứu về kỹ thuật phần mềm, an ninh mạng và trí tuệ nhân tạo.

Tài nguyên: