DeepSeek V4-Pro 以比 GPT-5.5 Pro 低 98% 的成本推出

DeepSeek 於 2026 年 4 月 24 日發布 DeepSeek-V4-Pro 和 DeepSeek-V4-Flash 的預覽版本,兩者都是具有一百萬 token 上下文視窗的開放權重模型,且定價顯著低於可比的西方替代方案。根據該公司的官方規格,V4-Pro 模型的費用為每百萬輸入 tokens $1.74、每百萬輸出 tokens $3.48——大約是 Claude Opus 4.7 價格的 1/20,且比 GPT-5.5 Pro 低 98%。

模型架構與規模

DeepSeek-V4-Pro 具有 1.6 兆(trillion)個總參數,使其成為截至目前 LLM 市場中最大的開源模型。然而,每次推理通過只會啟用 49 0 億(billion)個參數,使用 DeepSeek 稱為「Mixture-of-Experts(混合專家)」的方法,並自 V3 起進行了精煉。此設計使整個模型可以保持休眠狀態,只有針對任意請求的相關切片才會被啟用,從而在降低運算成本的同時維持知識能力。

DeepSeek-V4-Flash 的規模較小,具有 2840 億(billion)個總參數與 130 億(billion)個啟用參數。根據 DeepSeek 的基準測試,它「在給予更大的思考預算(thinking budget)時,達到與 Pro 版本相當的推理表現」。

兩款模型都將「一百萬 tokens 的上下文」作為標準功能支援——約 750,000 個單詞,或大約是整部「The Lord of the Rings(魔戒)」三部曲,再加上額外的文本。

技術創新:大規模下的注意力機制

DeepSeek 透過在公司技術論文中(該論文可在 GitHub 上取得)發明兩種新的注意力類型,來解決長上下文處理所固有的計算擴展問題。

標準 AI 注意力機制面臨一個殘酷的擴展問題:每當上下文長度加倍時,計算成本大約會變為 4 倍。DeepSeek 的解決方案包含兩種互補的方法:

壓縮稀疏注意力(Compressed Sparse Attention) 分兩步進行。首先,它會壓縮 token 群——例如把每 4 個 token 壓縮成一個條目。然後,不是對所有壓縮後的條目都進行注意力,而是使用「Lightning Indexer」來為任意查詢只選擇最相關的結果。這會將模型的注意力範圍從一百萬 tokens 降到一個小得多的、重要片段的集合。

高度壓縮注意力(Heavily Compressed Attention) 採取更激進的策略,將每 128 個 tokens 折疊成一個條目,而且不做稀疏選擇。雖然這會損失細粒度細節,但它能提供極其便宜的全局視角。這兩種注意力類型會在交替的層(layers)中運行,使模型同時維持細節與總覽。

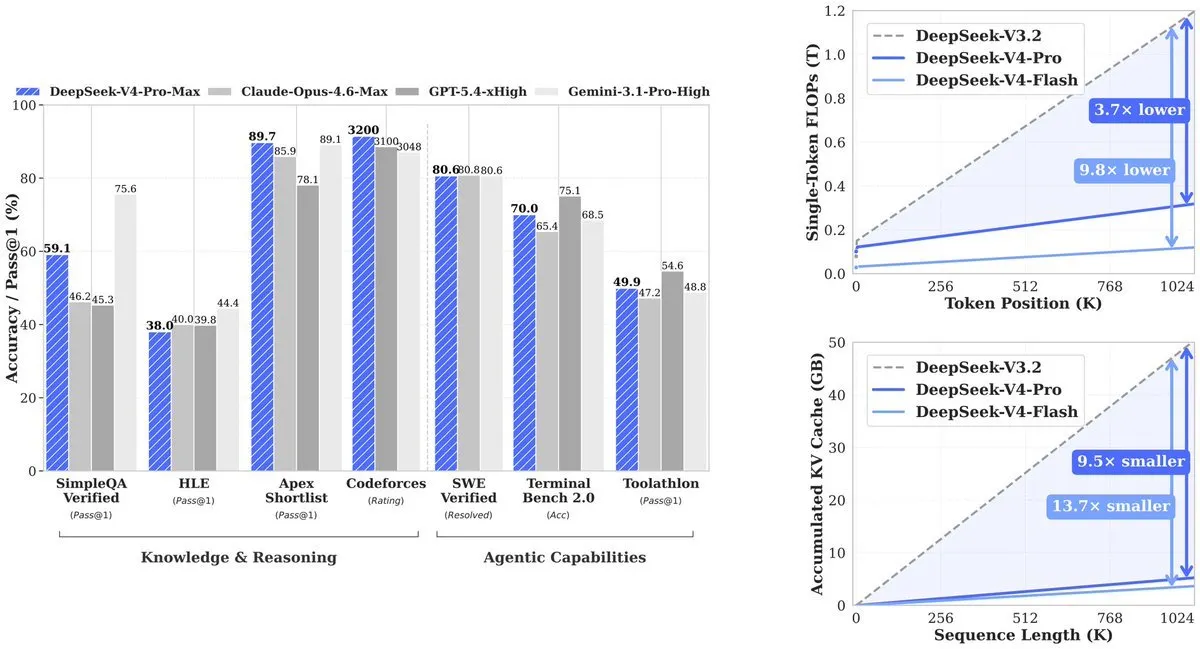

結果:V4-Pro 使用的計算量是其前身 (V3.2) 所需的 27%。KV cache——用於追蹤上下文所需的記憶體——降至 V3.2 的 10%。V4-Flash 進一步提升效率:相較於 V3.2,計算量為 10%、記憶體為 7%。

基準表現與競爭態勢

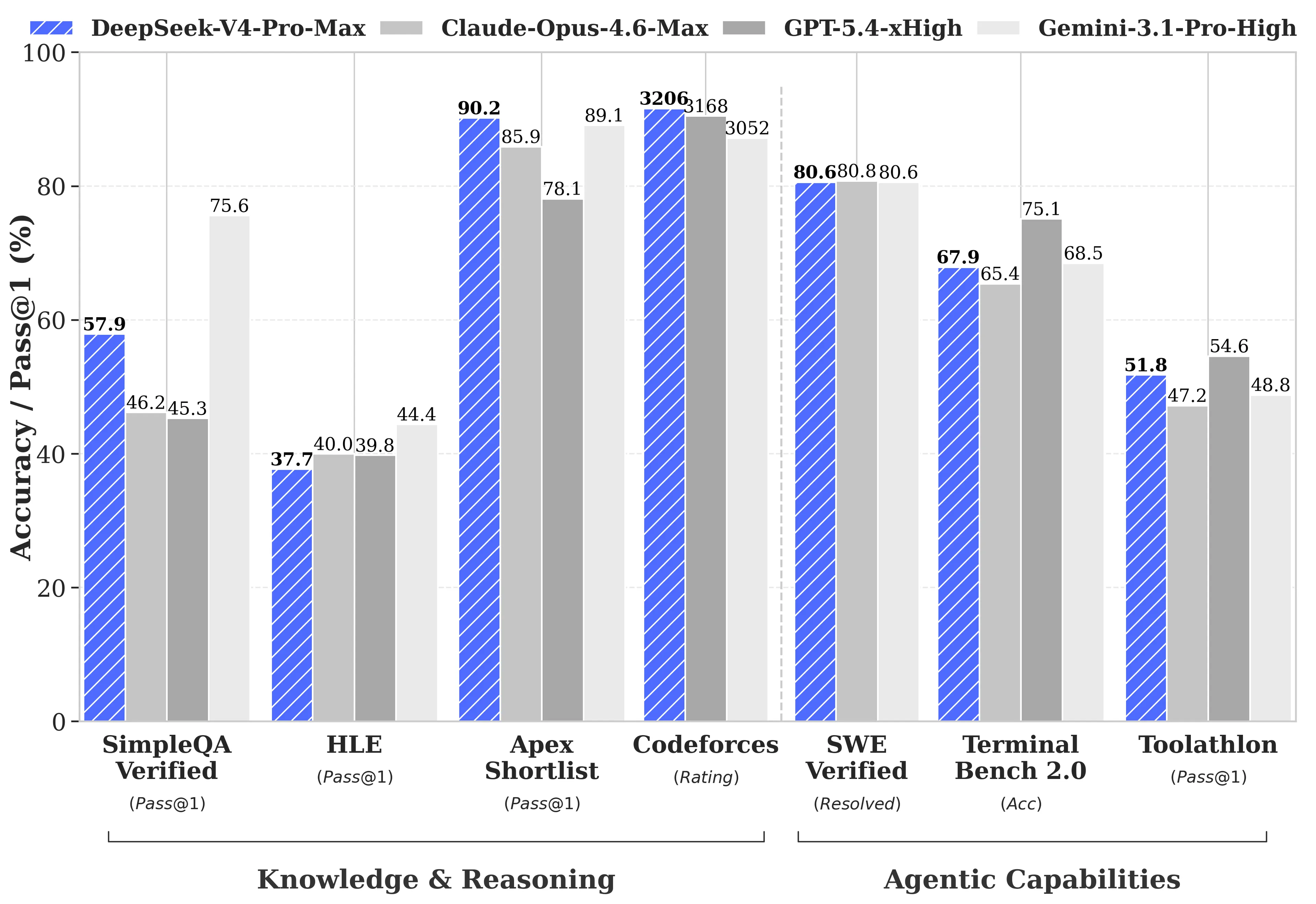

DeepSeek 發布了針對 GPT-5.4 與 Gemini-3.1-Pro 的全面基準比較,包括 V4-Pro 落後於競爭對手的領域。在推理任務上,根據 DeepSeek 的技術報告,V4-Pro 的推理落後於 GPT-5.4 與 Gemini-3.1-Pro 約三到六個月。

V4-Pro 的領先之處:

- Codeforces (競技程式設計):V4-Pro 得分 3,206,約位居真實人類競賽參與者中的第 23 名

- Apex Shortlist (精選的數學與 STEM 問題):通過率 90.2%,對比 Opus 4.6 的 85.9% 與 GPT-5.4 的 78.1%

- SWE-Verified (GitHub 問題解決):80.6%,與 Claude Opus 4.6 的表現一致

V4-Pro 的落後之處:

- MMLU-Pro (多任務處理):Gemini-3.1-Pro 為 91.0%,而 V4-Pro 為 87.5%

- GPQA Diamond (專家知識):Gemini 為 94.3,而 V4-Pro 為 90.1

- Humanity’s Last Exam (研究生級別):Gemini-3.1-Pro 為 44.4%,而 V4-Pro 為 37.7%

在長上下文任務上,V4-Pro 走在開源模型前列,並在 CorpusQA (模擬真實文件分析(在一百萬 tokens)) 上擊敗 Gemini-3.1-Pro,但在 MRCR 上落後於 Claude Opus 4.6;MRCR 衡量的是在長文本深處找回特定資訊的能力。

Agentic 與編碼能力

V4-Pro 可在 Claude Code、OpenCode 與其他 AI 編碼工具中運行。根據 DeepSeek 對 85 位使用 V4-Pro 作為主要編碼代理的開發者所做的內部調查,52% 的受訪者表示它已準備好成為他們的預設模型,39% 傾向表示是,且少於 9% 表示否。DeepSeek 的內部測試顯示,V4-Pro 在 agentic 編碼任務上表現優於 Claude Sonnet,並接近 Claude Opus 4.5。

Artificial Analysis 在 GDPval-AA 上將 V4-Pro 排在所有開放權重模型之首;GDPval-AA 是一個基準,用於測試在金融、法律與研究等任務中具有經濟價值的知識工作。V4-Pro-Max 得分為 1,554 Elo,高於 GLM-5.1 (1,535) 與 MiniMax 的 M2.7 (1,514)。Claude Opus 4.6 在同一基準上的得分為 1,619。

V4 引入「交錯式思考(interleaved thinking)」,在工具呼叫之間保留完整的思考鏈(chain of thought)。在先前的模型中,當代理做出多次工具呼叫——例如先搜尋網路、再執行程式、然後再次搜尋——模型的推理上下文會在輪次之間被清空。V4 能在步驟之間維持推理連續性,防止在複雜的自動化工作流程中出現上下文遺失。

競爭格局與定價脈絡

V4 的發布正值 AI 領域出現大量重大動作。Anthropic 於 2026 年 4 月 16 日推出 Claude Opus 4.7。OpenAI 的 GPT-5.5 於 2026 年 4 月 23 日上線,GPT-5.5 Pro 的定價為 $30 每百萬輸入 tokens$180 與 (每百萬輸出 tokens)。在 Terminal Bench 2.0 (82.7% 對比 70.0%) 上,GPT-5.5 比 V4-Pro 表現更好;該基準用於測試複雜的命令列代理工作流程。

小米於 2026 年 4 月 22 日推出 MiMo V2.5 Pro,提供完整的多模態能力 $1 image, audio, video$3 ,每百萬 tokens 的 (input 與 )output。騰訊則在 GPT-5.5 發布同日推出 Hy3。

談到定價觀點:Cline 的 CEO Saoud Rizwan 指出,若 Uber 使用 DeepSeek 而不是 Claude,其 2026 年的 AI 預算——據報足以支撐四個月的使用——本可持續七年。

![Pricing comparison and Uber budget analysis]https://img-cdn.gateio.im/social/moments-0ee5a4bf95-cbc5686e31-8b7abd-badf29

部署與供應

V4-Pro 與 V4-Flash 皆採用 MIT 授權,並可在 Hugging Face 上取得。兩款模型目前都是純文字模型;DeepSeek 表示正在著手開發多模態能力。兩款模型都可在本地硬體上免費運行,或依據公司需求進行客製化。

DeepSeek 既有的 deepseek-chat 與 deepseek-reasoner 端點已分別在非思考(non-thinking)與思考(thinking)模式下導流至 V4-Flash。舊的 deepseek-chat 與 deepseek-reasoner 端點將於 2026 年 7 月 24 日退役。

DeepSeek 訓練 V4 的部分內容使用了華為 Ascend 晶片,以繞過美國的出口限制。該公司表示,等到 2026 年下半年啟用 950 個新的超級節點(supernodes)後,Pro 模型已經偏低的價格還會進一步下降。

實務含意

對企業而言,定價結構可能會改變成本效益計算。以每百萬輸入 tokens $1.74 的價格在開源基準上領先的模型,使大規模文件處理、法律審查與程式碼生成的管線,與六個月前相比大幅更便宜。一次性一百萬 tokens 上下文允許在單次請求中處理整套程式碼基礎或監管文件,而不必在多次呼叫之間切分。

對開發者與獨立創建者而言,V4-Flash 是主要考量。以每百萬 tokens 的輸入 $0.14、輸出 $0.28 計價,它比一年前被視為預算選項(budget options)的模型更便宜,同時也能處理 Pro 版本大部分能完成的任務。